-

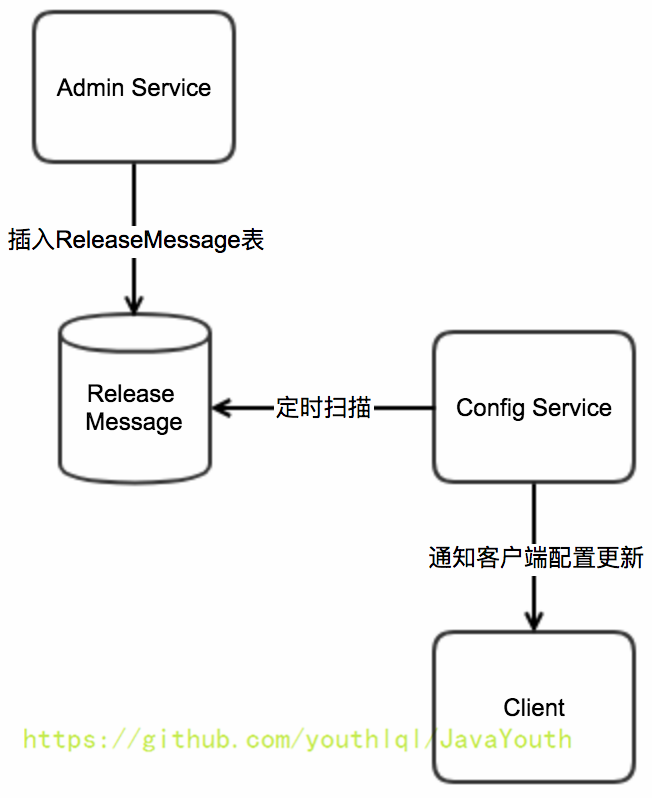

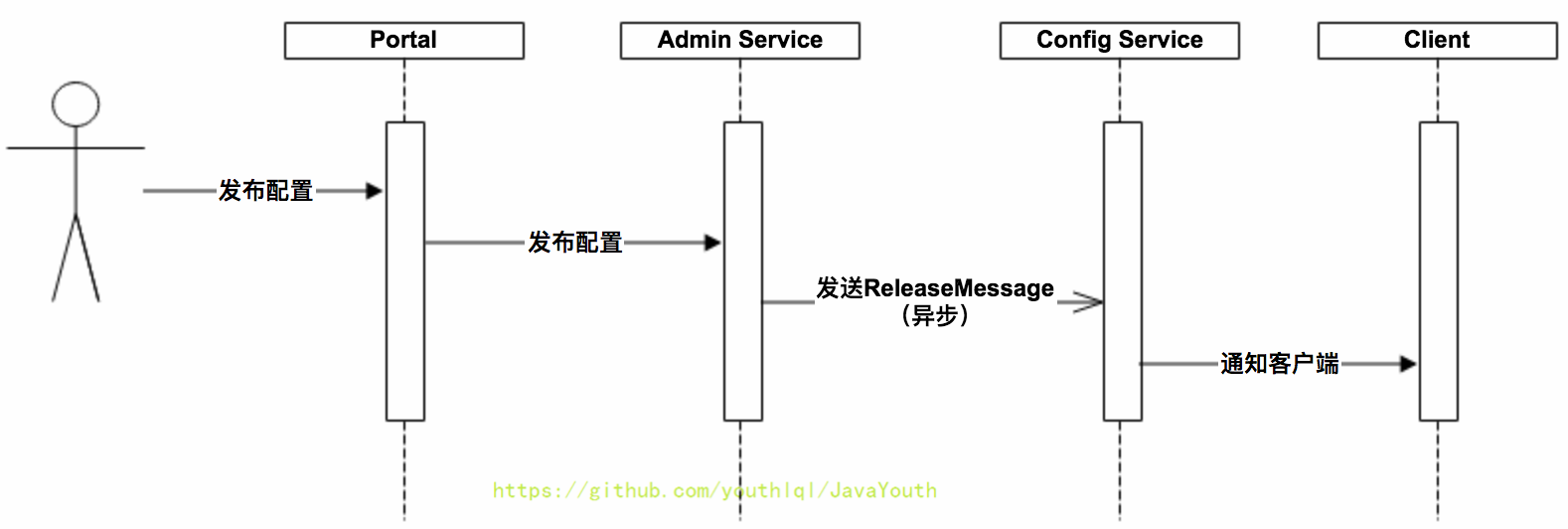

-#### Config Service通知客户端

-

-上一节中简要描述了NotificationControllerV2是如何得知有配置发布的,那NotificationControllerV2在得知有配置发布后是如何通知到客户端的呢?

-

-实现方式如下:

-

-1. 客户端会发起一个Http请求到Config Service的`notifications/v2`接口[NotificationControllerV2](https://github.com/ctripcorp/apollo/blob/master/apollo-configservice/src/main/java/com/ctrip/framework/apollo/configservice/controller/NotificationControllerV2.java)

-

-```java

-/**

- * @author Jason Song(song_s@ctrip.com)

- */

-@RestController

-@RequestMapping("/notifications/v2")

-public class NotificationControllerV2 implements ReleaseMessageListener {

- private static final Logger logger = LoggerFactory.getLogger(NotificationControllerV2.class);

- private final Multimap

-

-#### Config Service通知客户端

-

-上一节中简要描述了NotificationControllerV2是如何得知有配置发布的,那NotificationControllerV2在得知有配置发布后是如何通知到客户端的呢?

-

-实现方式如下:

-

-1. 客户端会发起一个Http请求到Config Service的`notifications/v2`接口[NotificationControllerV2](https://github.com/ctripcorp/apollo/blob/master/apollo-configservice/src/main/java/com/ctrip/framework/apollo/configservice/controller/NotificationControllerV2.java)

-

-```java

-/**

- * @author Jason Song(song_s@ctrip.com)

- */

-@RestController

-@RequestMapping("/notifications/v2")

-public class NotificationControllerV2 implements ReleaseMessageListener {

- private static final Logger logger = LoggerFactory.getLogger(NotificationControllerV2.class);

- private final Multimap -

-

-

-**完整的主配置文件为:**

-

-application.properties

-

-```properties

-# 指定读哪个应用的配置(必须写在配置文件里,无法写在apollo里,因为配置文件里如果没有写,都不知道读apollo里的哪个应用)

-app.id=account-service

-# 下面这个配置是开启Apollo的客户端,使其生效

-apollo.bootstrap.enabled = true

-

-# namespace以逗号分隔

-apollo.bootstrap.namespaces = application,micro_service.spring-boot-http,spring-rocketmq,micro_service.spring-boot-druid

-

-server.port=63000

-```

-

-

-

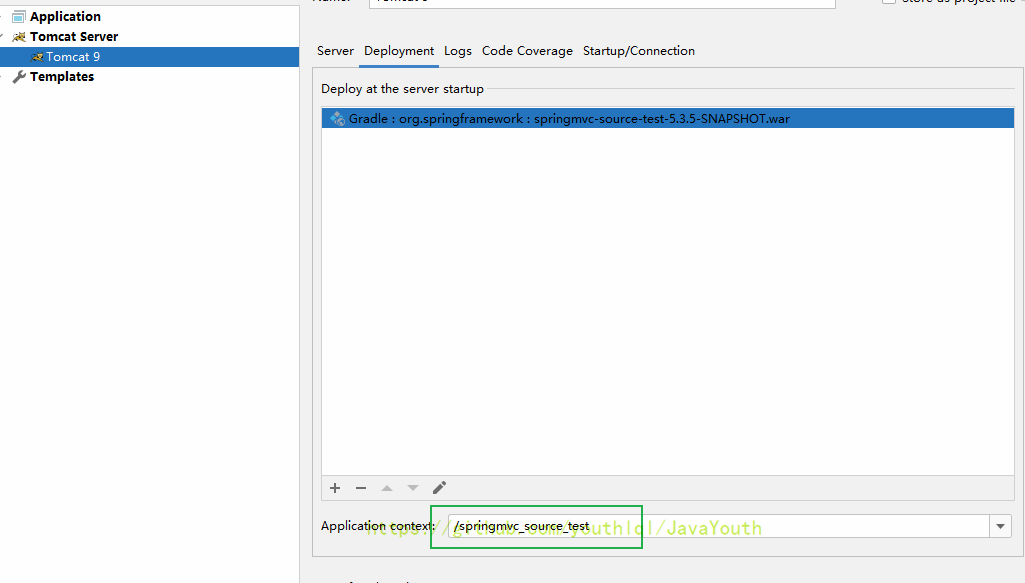

-#### 启用配置

-

-在咱们应用的启动类添加`@EnableApolloConfig`注解即可:

-

-```java

-@SpringBootApplication(scanBasePackages = "com.itcast.account")

-@EnableApolloConfig

-public class AccountApplication {

-

- public static void main(String[] args) {

- SpringApplication.run(AccountApplication.class, args);

- }

-}

-```

-

-

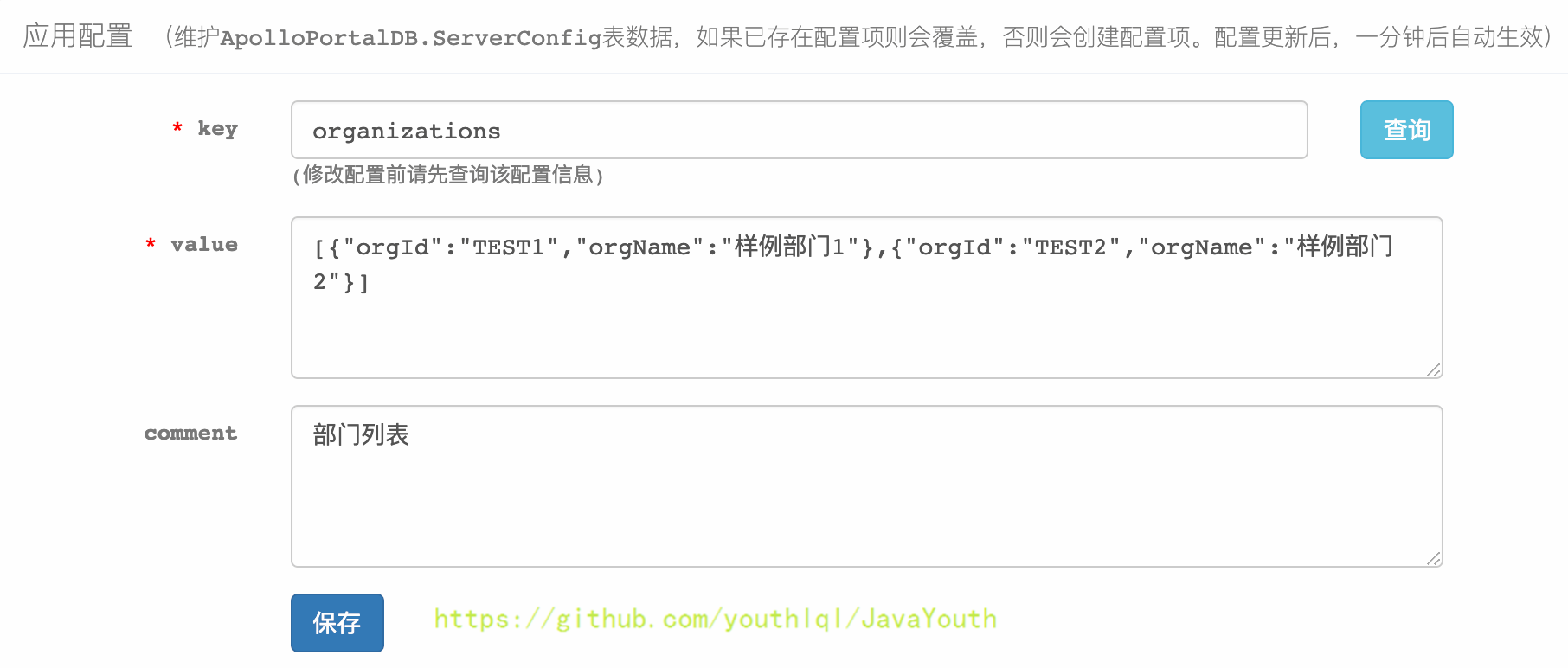

-#### 应用配置

-

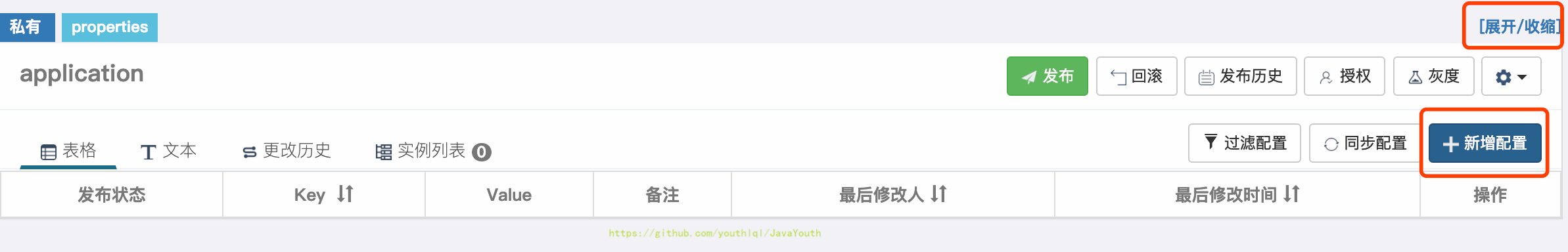

-1. 将local-config/account.properties中的配置添加到apollo中

-

- ```properties

- swagger.enable=true

- sms.enable=true

-

- spring.http.encoding.charset=UTF-8

- spring.http.encoding.force=true

- spring.http.encoding.enabled=true

- server.use-forward-headers=true

- server.tomcat.protocol_header=x-forwarded-proto

- server.servlet.context-path=/account-service

- server.tomcat.remote_ip_header=x-forwarded-for

-

- spring.datasource.driver-class-name=com.mysql.cj.jdbc.Driver

- spring.datasource.druid.stat-view-servlet.allow=127.0.0.1,192.168.163.1

- spring.datasource.druid.web-stat-filter.session-stat-enable=false

- spring.datasource.druid.max-pool-prepared-statement-per-connection-size=20

- spring.datasource.druid.max-active=20

- spring.datasource.druid.stat-view-servlet.reset-enable=false

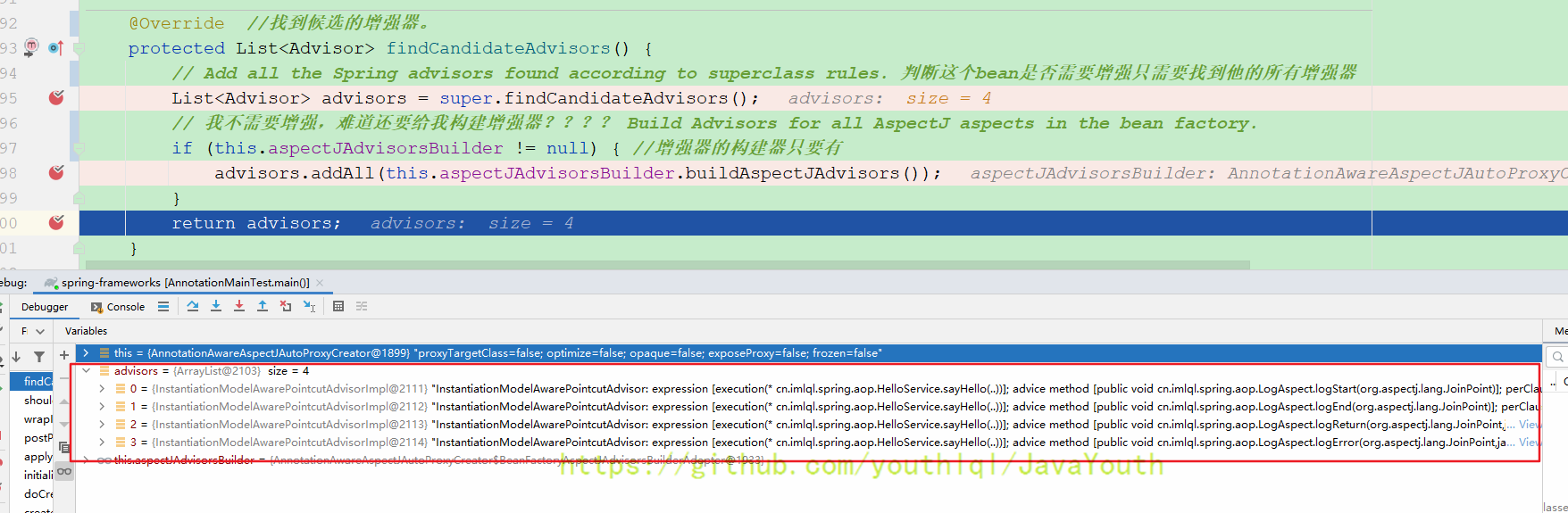

- spring.datasource.druid.validation-query=SELECT 1 FROM DUAL

- spring.datasource.druid.stat-view-servlet.enabled=true

- spring.datasource.druid.web-stat-filter.enabled=true

- spring.datasource.druid.stat-view-servlet.url-pattern=/druid/*

- spring.datasource.druid.stat-view-servlet.deny=192.168.1.73

- spring.datasource.url=jdbc\:mysql\://127.0.0.1\:3306/p2p_account?useUnicode\=true

- spring.datasource.druid.filters=config,stat,wall,log4j2

- spring.datasource.druid.test-on-return=false

- spring.datasource.druid.web-stat-filter.profile-enable=true

- spring.datasource.druid.initial-size=5

- spring.datasource.druid.min-idle=5

- spring.datasource.druid.max-wait=60000

- spring.datasource.druid.web-stat-filter.session-stat-max-count=1000

- spring.datasource.druid.pool-prepared-statements=true

- spring.datasource.druid.test-while-idle=true

- spring.datasource.password=pbteach0430

- spring.datasource.username=root

- spring.datasource.druid.stat-view-servlet.login-password=admin

- spring.datasource.druid.stat-view-servlet.login-username=admin

- spring.datasource.druid.web-stat-filter.url-pattern=/*

- spring.datasource.druid.time-between-eviction-runs-millis=60000

- spring.datasource.druid.min-evictable-idle-time-millis=300000

- spring.datasource.druid.test-on-borrow=false

- spring.datasource.druid.web-stat-filter.principal-session-name=admin

- spring.datasource.druid.filter.stat.log-slow-sql=true

- spring.datasource.druid.web-stat-filter.principal-cookie-name=admin

- spring.datasource.type=com.alibaba.druid.pool.DruidDataSource

- spring.datasource.druid.aop-patterns=com.pbteach.wanxinp2p.*.service.*

- spring.datasource.druid.filter.stat.slow-sql-millis=1

- spring.datasource.druid.web-stat-filter.exclusions=*.js,*.gif,*.jpg,*.png,*.css,*.ico,/druid/*

- ```

-

-

-

-

-

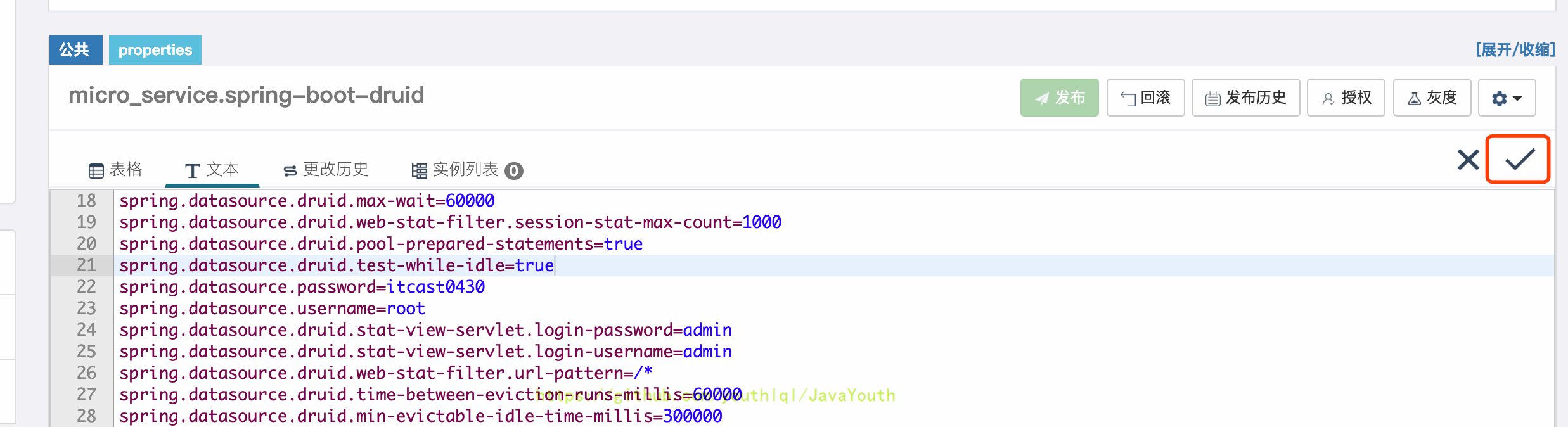

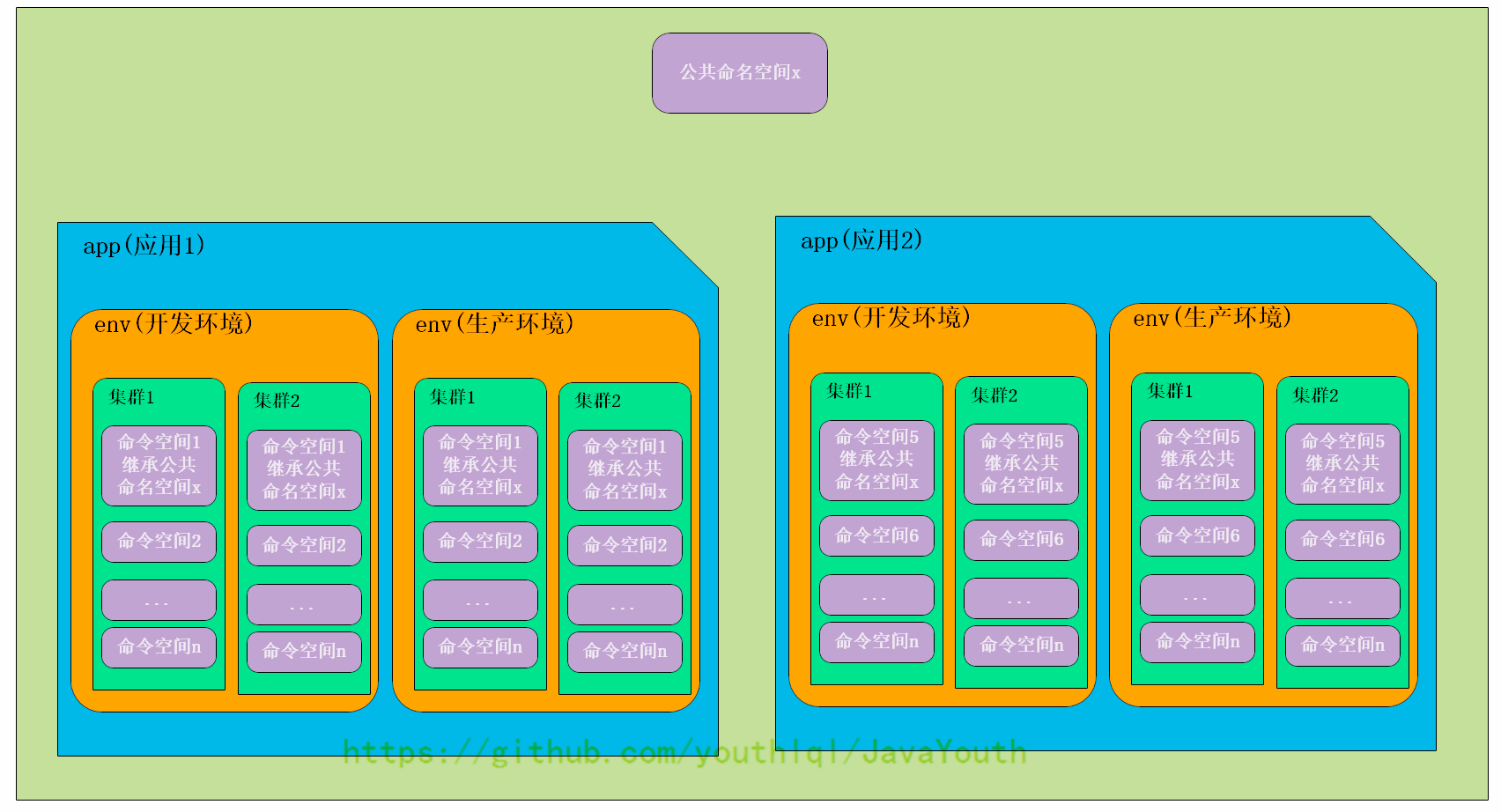

-2. spring-http命名空间在之前已通过关联公共命名空间添加好了,现在来添加spring-boot-druid命名空间

-

-

-

-

-

-**完整的主配置文件为:**

-

-application.properties

-

-```properties

-# 指定读哪个应用的配置(必须写在配置文件里,无法写在apollo里,因为配置文件里如果没有写,都不知道读apollo里的哪个应用)

-app.id=account-service

-# 下面这个配置是开启Apollo的客户端,使其生效

-apollo.bootstrap.enabled = true

-

-# namespace以逗号分隔

-apollo.bootstrap.namespaces = application,micro_service.spring-boot-http,spring-rocketmq,micro_service.spring-boot-druid

-

-server.port=63000

-```

-

-

-

-#### 启用配置

-

-在咱们应用的启动类添加`@EnableApolloConfig`注解即可:

-

-```java

-@SpringBootApplication(scanBasePackages = "com.itcast.account")

-@EnableApolloConfig

-public class AccountApplication {

-

- public static void main(String[] args) {

- SpringApplication.run(AccountApplication.class, args);

- }

-}

-```

-

-

-#### 应用配置

-

-1. 将local-config/account.properties中的配置添加到apollo中

-

- ```properties

- swagger.enable=true

- sms.enable=true

-

- spring.http.encoding.charset=UTF-8

- spring.http.encoding.force=true

- spring.http.encoding.enabled=true

- server.use-forward-headers=true

- server.tomcat.protocol_header=x-forwarded-proto

- server.servlet.context-path=/account-service

- server.tomcat.remote_ip_header=x-forwarded-for

-

- spring.datasource.driver-class-name=com.mysql.cj.jdbc.Driver

- spring.datasource.druid.stat-view-servlet.allow=127.0.0.1,192.168.163.1

- spring.datasource.druid.web-stat-filter.session-stat-enable=false

- spring.datasource.druid.max-pool-prepared-statement-per-connection-size=20

- spring.datasource.druid.max-active=20

- spring.datasource.druid.stat-view-servlet.reset-enable=false

- spring.datasource.druid.validation-query=SELECT 1 FROM DUAL

- spring.datasource.druid.stat-view-servlet.enabled=true

- spring.datasource.druid.web-stat-filter.enabled=true

- spring.datasource.druid.stat-view-servlet.url-pattern=/druid/*

- spring.datasource.druid.stat-view-servlet.deny=192.168.1.73

- spring.datasource.url=jdbc\:mysql\://127.0.0.1\:3306/p2p_account?useUnicode\=true

- spring.datasource.druid.filters=config,stat,wall,log4j2

- spring.datasource.druid.test-on-return=false

- spring.datasource.druid.web-stat-filter.profile-enable=true

- spring.datasource.druid.initial-size=5

- spring.datasource.druid.min-idle=5

- spring.datasource.druid.max-wait=60000

- spring.datasource.druid.web-stat-filter.session-stat-max-count=1000

- spring.datasource.druid.pool-prepared-statements=true

- spring.datasource.druid.test-while-idle=true

- spring.datasource.password=pbteach0430

- spring.datasource.username=root

- spring.datasource.druid.stat-view-servlet.login-password=admin

- spring.datasource.druid.stat-view-servlet.login-username=admin

- spring.datasource.druid.web-stat-filter.url-pattern=/*

- spring.datasource.druid.time-between-eviction-runs-millis=60000

- spring.datasource.druid.min-evictable-idle-time-millis=300000

- spring.datasource.druid.test-on-borrow=false

- spring.datasource.druid.web-stat-filter.principal-session-name=admin

- spring.datasource.druid.filter.stat.log-slow-sql=true

- spring.datasource.druid.web-stat-filter.principal-cookie-name=admin

- spring.datasource.type=com.alibaba.druid.pool.DruidDataSource

- spring.datasource.druid.aop-patterns=com.pbteach.wanxinp2p.*.service.*

- spring.datasource.druid.filter.stat.slow-sql-millis=1

- spring.datasource.druid.web-stat-filter.exclusions=*.js,*.gif,*.jpg,*.png,*.css,*.ico,/druid/*

- ```

-

-

-

-

-

-2. spring-http命名空间在之前已通过关联公共命名空间添加好了,现在来添加spring-boot-druid命名空间

-

- -

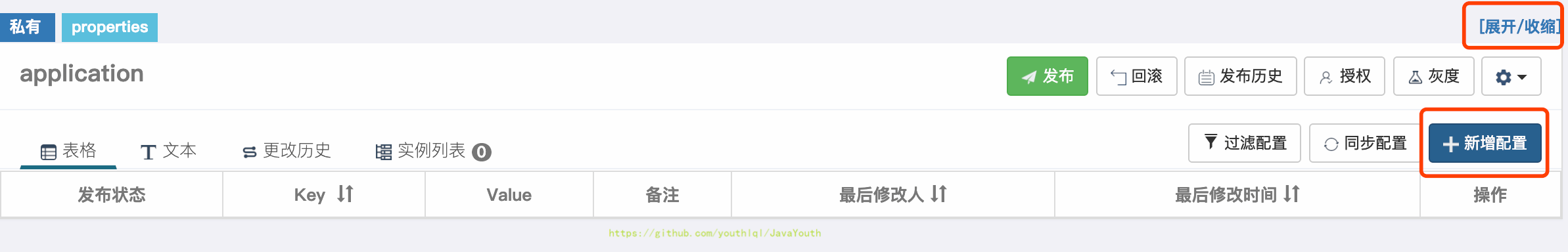

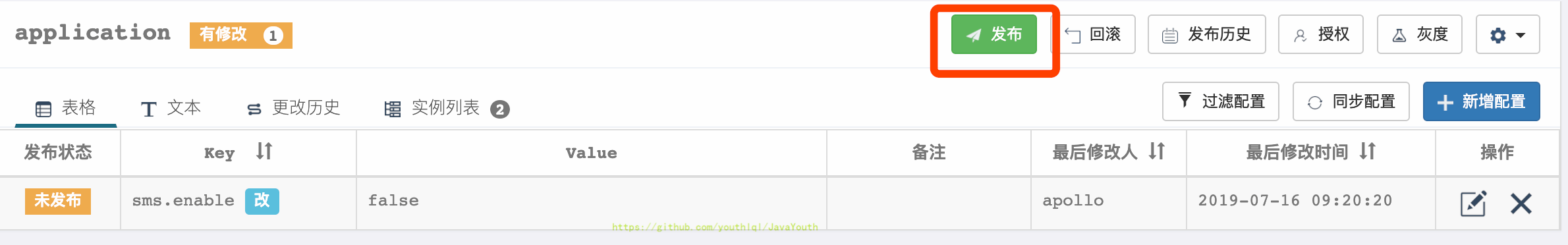

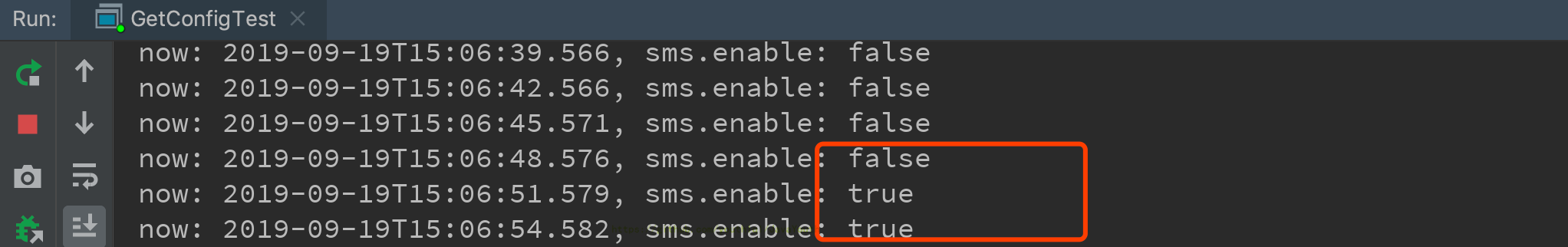

-3. 添加本地文件中的配置到对应的命名空间,然后发布配置

-

-

-

-3. 添加本地文件中的配置到对应的命名空间,然后发布配置

-

- -

-4. 在account-service/src/main/resources/application.properties中配置apollo.bootstrap.namespaces需要引入的命名空间(上面写过)

-

- ```properties

- # 指定读哪个应用的配置(必须写在配置文件里,无法写在apollo里,因为配置文件里如果没有写,都不知道读apollo里的哪个应用)

- app.id=account-service

- # 下面这个配置是开启Apollo的客户端,使其生效

- apollo.bootstrap.enabled = true

-

- # namespace以逗号分隔

- apollo.bootstrap.namespaces = application,micro_service.spring-boot-http,spring-rocketmq,micro_service.spring-boot-druid

-

- server.port=63000

- ```

-

-5.写一个测试Controller

-

- ```java

-

-package cn.itcast.account;

-

-import org.springframework.beans.factory.annotation.Value;

-import org.springframework.web.bind.annotation.GetMapping;

-import org.springframework.web.bind.annotation.RestController;

-

-@RestController

-public class AccountController {

-

- @Value("${sms.enable}")

- private Boolean smsEnable;

-

- @GetMapping("/hi")

- public String hi() {

- return "hi";

- }

-

- @GetMapping("/sms")

- public String getSmsConfig() {

- return "smsEnable: " + smsEnable;

- }

-

- @Value("${rocketmq.name-server}")

- private String mqNameServer;

-

- @Value("${rocketmq.producer.group}")

- private String mqProducerGroup;

-

- @GetMapping("/mq")

- public String getRocketMQConf() {

- return mqNameServer + ": " + mqProducerGroup;

- }

-

- @Value("${timeout}")

- private Long timeout;

-

- @GetMapping("/timeout")

- public Long getTimeout() {

- return timeout;

- }

-

- @GetMapping("/db-url")

- public String getDBConfig(@Value("${spring.datasource.url}") String url) {

- return url;

- }

-

-}

-

- ```

-

-

-

-#### 读取配置

-

-1. 启动应用

-

-2. 访问:[http://127.0.0.1:63000/account-service/hi](http://127.0.0.1:63000/account-service/hi),确认Spring Boot中配置的context-path是否生效

-

-通过/account-service能正常访问,说明apollo的配置已生效

-

-

-

-3. 确认spring-boot-druid配置

-

-* 为了快速确认可以在AccountController中通过@Value获取来验证

-

-* 访问[http://127.0.0.1:63000/account-service/db-url](http://127.0.0.1:63000/account-service/db-url),显示结果

-

-

-

-4. 在account-service/src/main/resources/application.properties中配置apollo.bootstrap.namespaces需要引入的命名空间(上面写过)

-

- ```properties

- # 指定读哪个应用的配置(必须写在配置文件里,无法写在apollo里,因为配置文件里如果没有写,都不知道读apollo里的哪个应用)

- app.id=account-service

- # 下面这个配置是开启Apollo的客户端,使其生效

- apollo.bootstrap.enabled = true

-

- # namespace以逗号分隔

- apollo.bootstrap.namespaces = application,micro_service.spring-boot-http,spring-rocketmq,micro_service.spring-boot-druid

-

- server.port=63000

- ```

-

-5.写一个测试Controller

-

- ```java

-

-package cn.itcast.account;

-

-import org.springframework.beans.factory.annotation.Value;

-import org.springframework.web.bind.annotation.GetMapping;

-import org.springframework.web.bind.annotation.RestController;

-

-@RestController

-public class AccountController {

-

- @Value("${sms.enable}")

- private Boolean smsEnable;

-

- @GetMapping("/hi")

- public String hi() {

- return "hi";

- }

-

- @GetMapping("/sms")

- public String getSmsConfig() {

- return "smsEnable: " + smsEnable;

- }

-

- @Value("${rocketmq.name-server}")

- private String mqNameServer;

-

- @Value("${rocketmq.producer.group}")

- private String mqProducerGroup;

-

- @GetMapping("/mq")

- public String getRocketMQConf() {

- return mqNameServer + ": " + mqProducerGroup;

- }

-

- @Value("${timeout}")

- private Long timeout;

-

- @GetMapping("/timeout")

- public Long getTimeout() {

- return timeout;

- }

-

- @GetMapping("/db-url")

- public String getDBConfig(@Value("${spring.datasource.url}") String url) {

- return url;

- }

-

-}

-

- ```

-

-

-

-#### 读取配置

-

-1. 启动应用

-

-2. 访问:[http://127.0.0.1:63000/account-service/hi](http://127.0.0.1:63000/account-service/hi),确认Spring Boot中配置的context-path是否生效

-

-通过/account-service能正常访问,说明apollo的配置已生效

-

-

-

-3. 确认spring-boot-druid配置

-

-* 为了快速确认可以在AccountController中通过@Value获取来验证

-

-* 访问[http://127.0.0.1:63000/account-service/db-url](http://127.0.0.1:63000/account-service/db-url),显示结果

-

- -

-#### 创建其它项目

-

-参考account-service将其它项目也创建完成。

-

-### 生产环境部署

-

-当一个项目要上线部署到生产环境时,项目的配置比如数据库连接、RocketMQ地址等都会发生变化,这时候就需要通过Apollo为生产环境添加自己的配置。

-

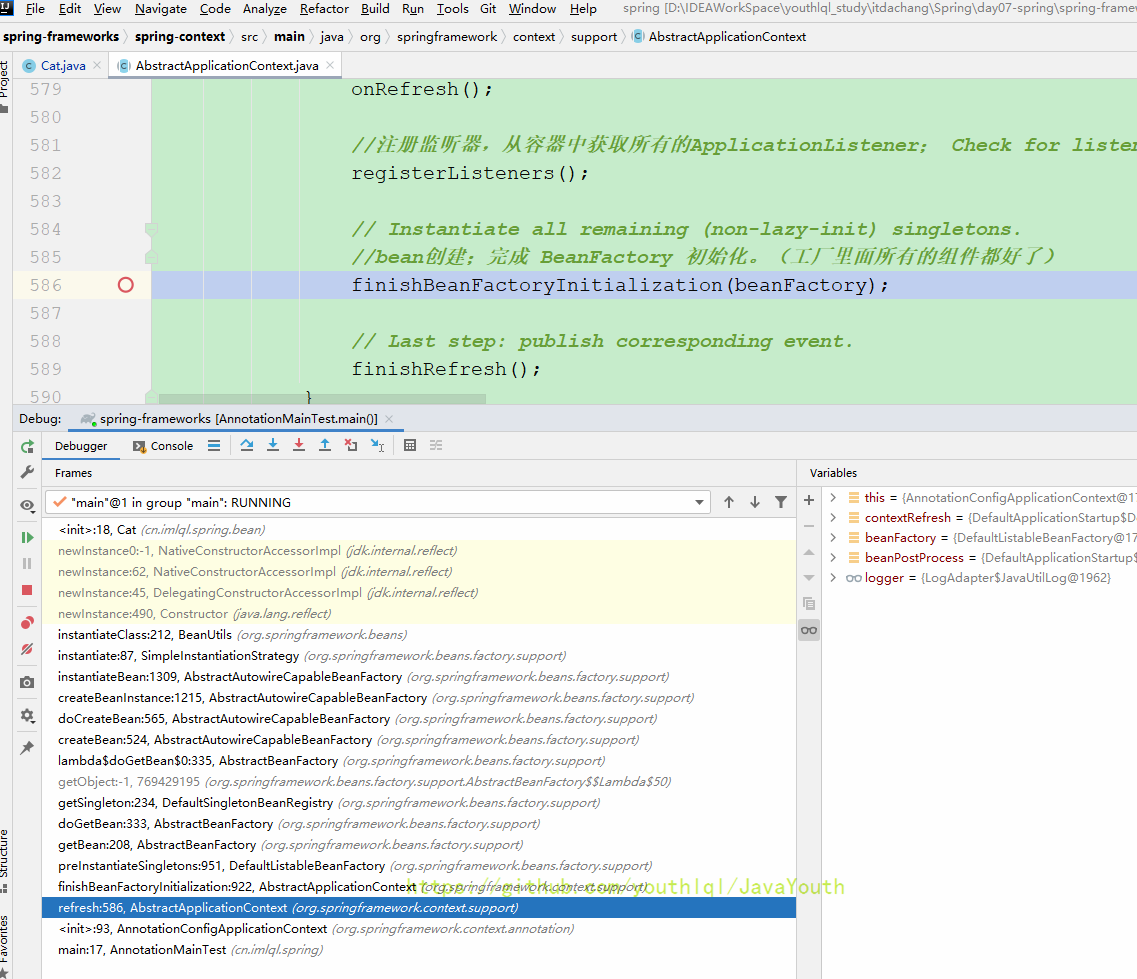

-#### 企业部署方案

-

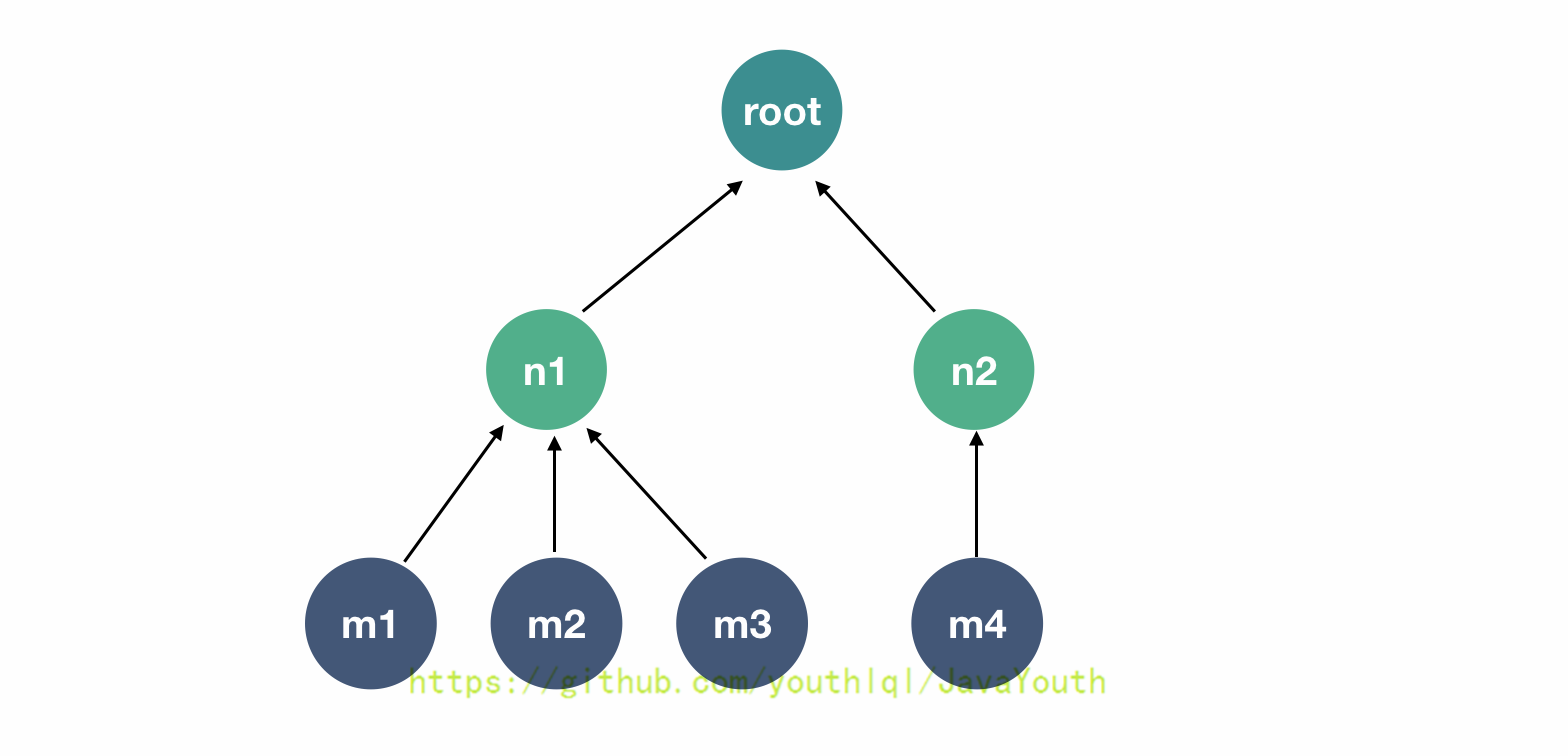

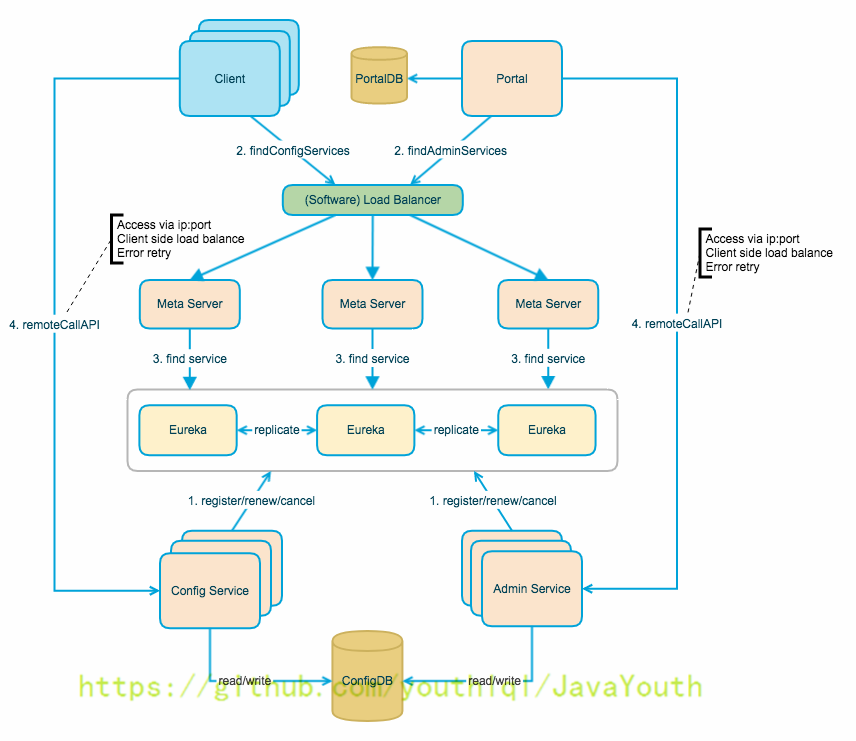

-在企业中常用的部署方案为:Apollo-adminservice和Apollo-configservice两个服务分别在线上环境(pro),仿真环境(uat)和开发环境(dev)各部署一套,Apollo-portal做为管理端只部署一套,统一管理上述三套环境。

-

-具体如下图所示:

-

-

-

-#### 创建其它项目

-

-参考account-service将其它项目也创建完成。

-

-### 生产环境部署

-

-当一个项目要上线部署到生产环境时,项目的配置比如数据库连接、RocketMQ地址等都会发生变化,这时候就需要通过Apollo为生产环境添加自己的配置。

-

-#### 企业部署方案

-

-在企业中常用的部署方案为:Apollo-adminservice和Apollo-configservice两个服务分别在线上环境(pro),仿真环境(uat)和开发环境(dev)各部署一套,Apollo-portal做为管理端只部署一套,统一管理上述三套环境。

-

-具体如下图所示:

-

- -

-下面以添加生产环境部署为例

-

-#### 创建数据库

-

-创建生产环境的ApolloConfigDB:**每添加一套环境就需要部署一套ApolloConfgService和ApolloAdminService**

-

-source apollo/ApolloConfigDB\_PRO\_\_initialization.sql

-

-#### 配置启动参数

-

-1. 设置生产环境数据库连接

-

-2. 设置ApolloConfigService端口为:8081,ApolloAdminService端口为8091

-

- ```bash

- echo

-

- set url="localhost:3306"

- set username="root"

- set password="123456"

-

- start "configService-PRO" java -Dserver.port=8081 -Xms256m -Xmx256m -Dapollo_profile=github -Dspring.datasource.url=jdbc:mysql://%url%/ApolloConfigDBPRO?characterEncoding=utf8 -Dspring.datasource.username=%username% -Dspring.datasource.password=%password% -Dlogging.file=.\logs\apollo-configservice.log -jar .\apollo-configservice-1.3.0.jar

- start "adminService-PRO" java -Dserver.port=8091 -Xms256m -Xmx256m -Dapollo_profile=github -Dspring.datasource.url=jdbc:mysql://%url%/ApolloConfigDBPRO?characterEncoding=utf8 -Dspring.datasource.username=%username% -Dspring.datasource.password=%password% -Dlogging.file=.\logs\apollo-adminservice.log -jar .\apollo-adminservice-1.3.0.jar

- ```

-

-

-

-1. 运行runApollo-PRO.bat【关于这个bat的说明在上面已经说过】

-

-#### 修改Eureka地址

-

-因为上一套**ApolloConfgService和ApolloAdminService**里的Eureka占用了8080端口,所以这里第二套需要改一下端口

-

-更新生产环境Apollo的Eureka地址:

-

-```sql

-USE ApolloConfigDBPRO;

-

-UPDATE ServerConfig SET `Value` = "http://localhost:8081/eureka/" WHERE `key` = "eureka.service.url";

-```

-

-

-

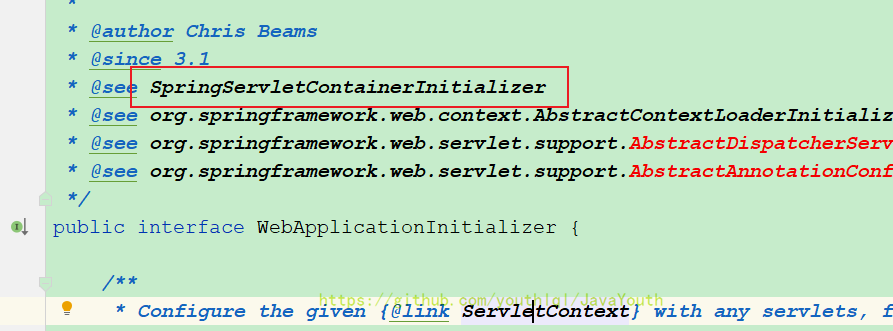

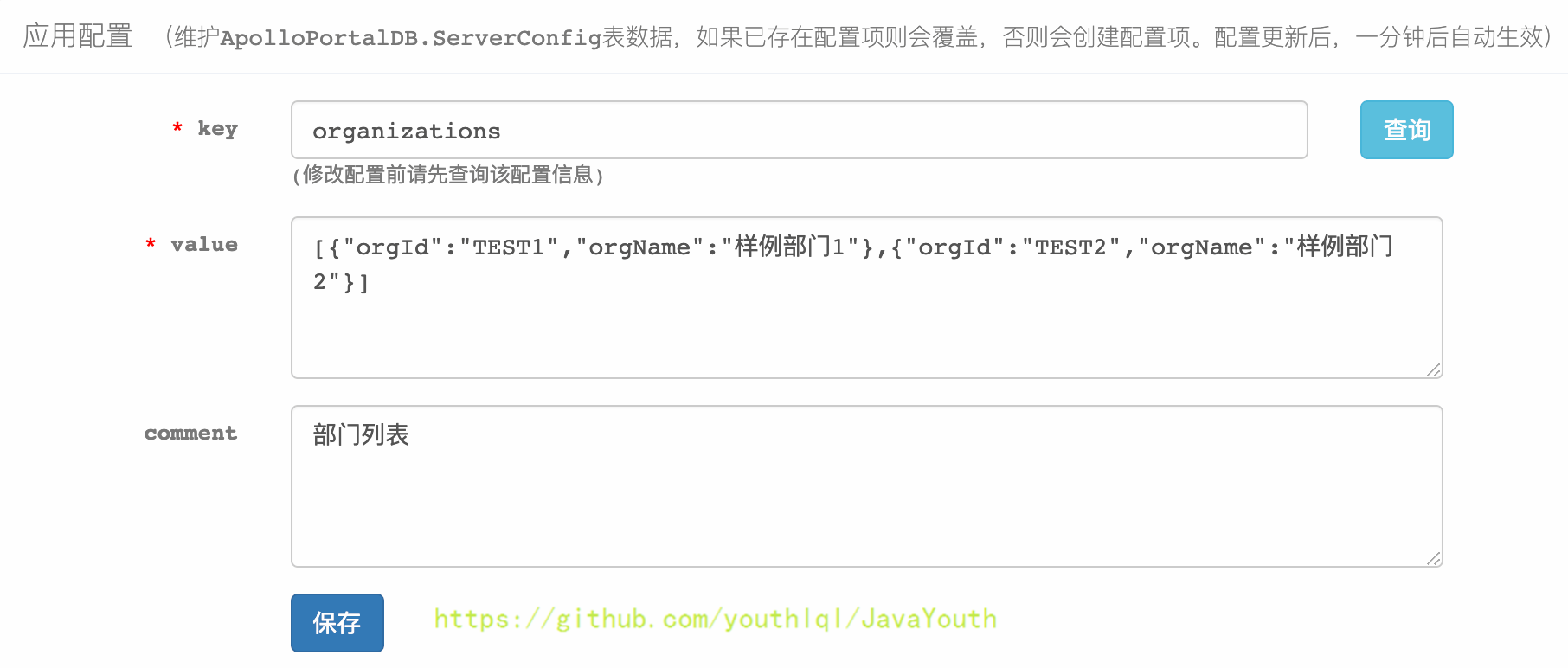

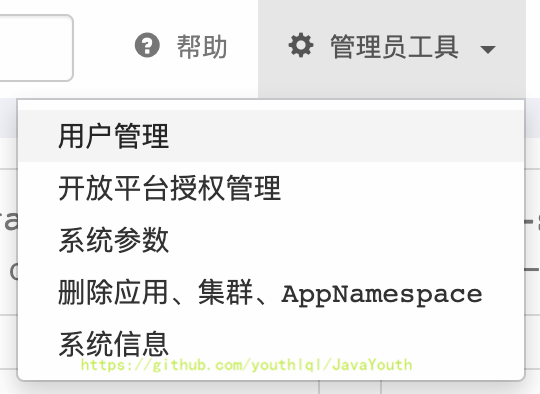

-#### 调整ApolloPortal服务配置

-

-服务配置项统一存储在ApolloPortalDB.ServerConfig表中,可以通过`管理员工具 - 系统参数`页面进行配置:apollo.portal.envs - 可支持的环境列表

-

-

-

-下面以添加生产环境部署为例

-

-#### 创建数据库

-

-创建生产环境的ApolloConfigDB:**每添加一套环境就需要部署一套ApolloConfgService和ApolloAdminService**

-

-source apollo/ApolloConfigDB\_PRO\_\_initialization.sql

-

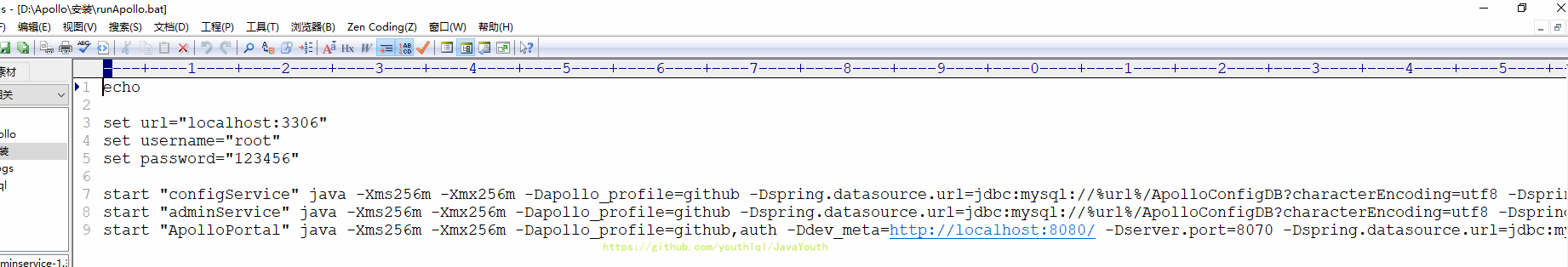

-#### 配置启动参数

-

-1. 设置生产环境数据库连接

-

-2. 设置ApolloConfigService端口为:8081,ApolloAdminService端口为8091

-

- ```bash

- echo

-

- set url="localhost:3306"

- set username="root"

- set password="123456"

-

- start "configService-PRO" java -Dserver.port=8081 -Xms256m -Xmx256m -Dapollo_profile=github -Dspring.datasource.url=jdbc:mysql://%url%/ApolloConfigDBPRO?characterEncoding=utf8 -Dspring.datasource.username=%username% -Dspring.datasource.password=%password% -Dlogging.file=.\logs\apollo-configservice.log -jar .\apollo-configservice-1.3.0.jar

- start "adminService-PRO" java -Dserver.port=8091 -Xms256m -Xmx256m -Dapollo_profile=github -Dspring.datasource.url=jdbc:mysql://%url%/ApolloConfigDBPRO?characterEncoding=utf8 -Dspring.datasource.username=%username% -Dspring.datasource.password=%password% -Dlogging.file=.\logs\apollo-adminservice.log -jar .\apollo-adminservice-1.3.0.jar

- ```

-

-

-

-1. 运行runApollo-PRO.bat【关于这个bat的说明在上面已经说过】

-

-#### 修改Eureka地址

-

-因为上一套**ApolloConfgService和ApolloAdminService**里的Eureka占用了8080端口,所以这里第二套需要改一下端口

-

-更新生产环境Apollo的Eureka地址:

-

-```sql

-USE ApolloConfigDBPRO;

-

-UPDATE ServerConfig SET `Value` = "http://localhost:8081/eureka/" WHERE `key` = "eureka.service.url";

-```

-

-

-

-#### 调整ApolloPortal服务配置

-

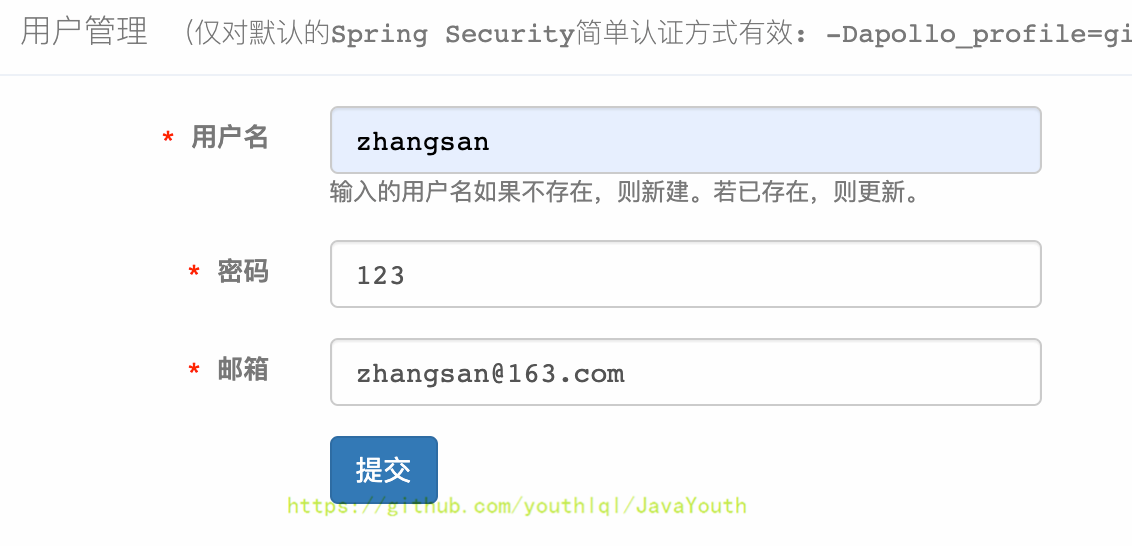

-服务配置项统一存储在ApolloPortalDB.ServerConfig表中,可以通过`管理员工具 - 系统参数`页面进行配置:apollo.portal.envs - 可支持的环境列表

-

- -

-默认值是dev,如果portal需要管理多个环境的话,以逗号分隔即可(大小写不敏感),如:

-

- dev,pro

-

-

-

-#### 启动ApolloPortal

-

-Apollo Portal需要在不同的环境访问不同的meta service(apollo-configservice)地址,所以我们需要在配置中提供这些信息。

-

-```bash

--Ddev_meta=http://localhost:8080/ -Dpro_meta=http://localhost:8081/

-```

-

-

-1. 关闭之前启动的ApolloPortal服务,使用runApolloPortal.bat启动多环境配置

-

- ```bash

- echo

-

- set url="localhost:3306"

- set username="root"

- set password="mysql"

-

- start "ApolloPortal" java -Xms256m -Xmx256m -Dapollo_profile=github,auth -Ddev_meta=http://localhost:8080/ -Dpro_meta=http://localhost:8081/ -Dserver.port=8070 -Dspring.datasource.url=jdbc:mysql://%url%/ApolloPortalDB?characterEncoding=utf8 -Dspring.datasource.username=%username% -Dspring.datasource.password=%password% -Dlogging.file=.\logs\apollo-portal.log -jar .\apollo-portal-1.3.0.jar

- ```

-

-

-

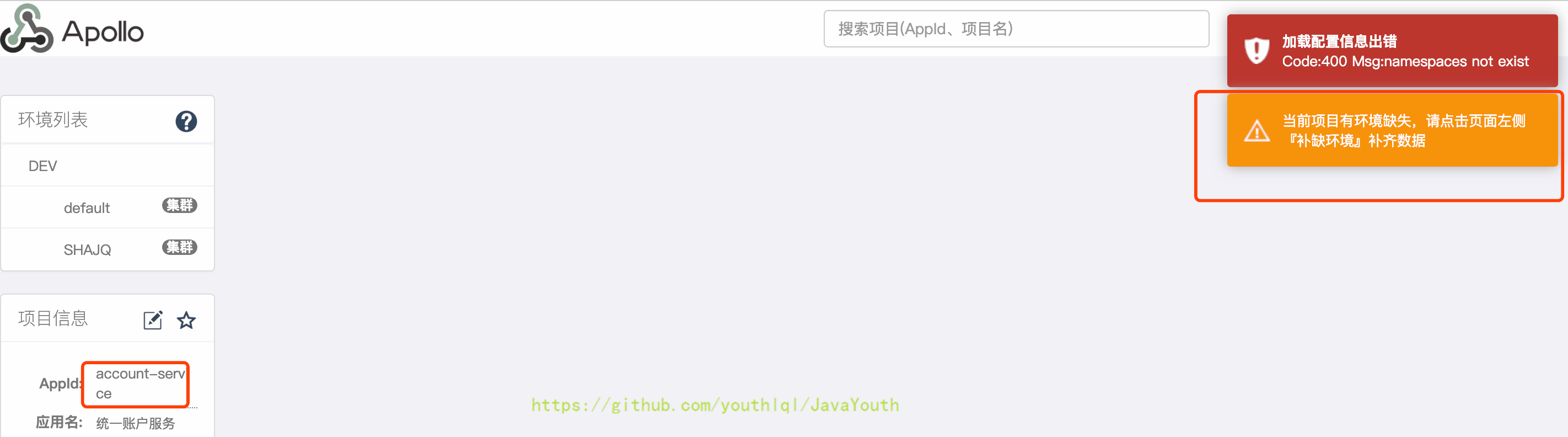

-1. 启动之后,点击account-service服务配置后会提示环境缺失,此时需要补全上边新增生产环境的配置

-

-

-

-默认值是dev,如果portal需要管理多个环境的话,以逗号分隔即可(大小写不敏感),如:

-

- dev,pro

-

-

-

-#### 启动ApolloPortal

-

-Apollo Portal需要在不同的环境访问不同的meta service(apollo-configservice)地址,所以我们需要在配置中提供这些信息。

-

-```bash

--Ddev_meta=http://localhost:8080/ -Dpro_meta=http://localhost:8081/

-```

-

-

-1. 关闭之前启动的ApolloPortal服务,使用runApolloPortal.bat启动多环境配置

-

- ```bash

- echo

-

- set url="localhost:3306"

- set username="root"

- set password="mysql"

-

- start "ApolloPortal" java -Xms256m -Xmx256m -Dapollo_profile=github,auth -Ddev_meta=http://localhost:8080/ -Dpro_meta=http://localhost:8081/ -Dserver.port=8070 -Dspring.datasource.url=jdbc:mysql://%url%/ApolloPortalDB?characterEncoding=utf8 -Dspring.datasource.username=%username% -Dspring.datasource.password=%password% -Dlogging.file=.\logs\apollo-portal.log -jar .\apollo-portal-1.3.0.jar

- ```

-

-

-

-1. 启动之后,点击account-service服务配置后会提示环境缺失,此时需要补全上边新增生产环境的配置

-

- -

-3. 点击左下方的补缺环境

-

-

-

-4. 补缺过生产环境后,切换到PRO环境后会提示有Namespace缺失,点击补缺

-

-

-

-3. 点击左下方的补缺环境

-

-

-

-4. 补缺过生产环境后,切换到PRO环境后会提示有Namespace缺失,点击补缺

-

- -

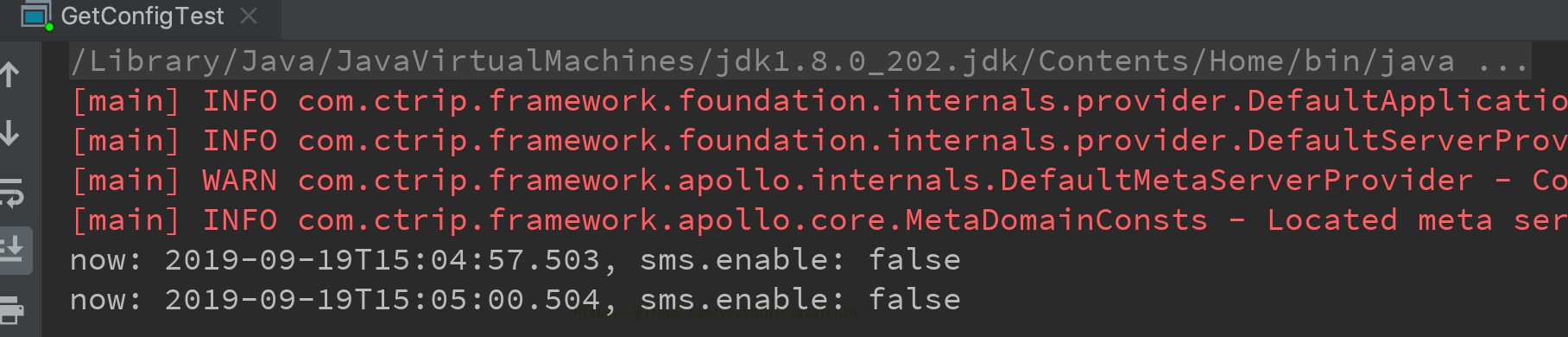

-5. 从dev环境同步配置到pro

-

-

-

-#### 验证配置

-

-1. 同步完成后,切换到pro环境,修改生产环境rocketmq地址后发布配置

-

-

-

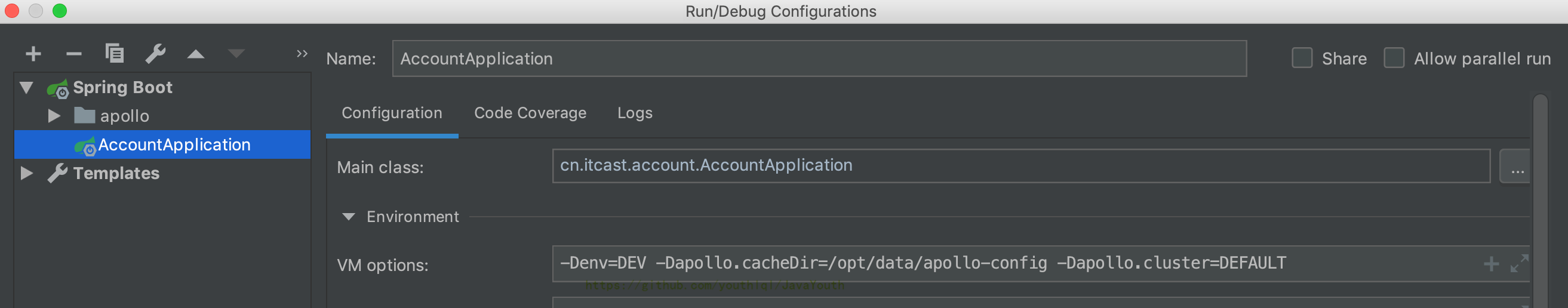

-2. 配置项目使用pro环境,测试配置是否生效

-

-* 在apollo-env.properties中增加pro.meta=[http://localhost:8081](http://localhost:8081)

-

-* 修改account-service启动参数为:-Denv=pro

-

-```bash

- -Denv=pro -Dapollo.cacheDir=/opt/data/apollo-config -Dapollo.cluster=DEFAULT

-```

-

-* 访问[http://127.0.0.1:63000/account-service/mq](http://127.0.0.1:63000/account-service/mq) 验证RocketMQ地址是否为上边设置的PRO环境的值

-

-

-

-### 灰度发布

-

-#### 定义

-

- 灰度发布是指在黑与白之间,能够平滑过渡的一种发布方式。在其上可以进行A/B testing,即让一部分用户继续用产品特性A,一部分用户开始用产品特性B,如果用户对B没有什么反对意见,那么逐步扩大范围,把所有用户都迁移到B上面来。

-

-

-

-#### Apollo实现的功能

-

-1. 对于一些对程序有比较大影响的配置,可以先在一个或者多个实例生效,观察一段时间没问题后再全量发布配置。

-2. 对于一些需要调优的配置参数,可以通过灰度发布功能来实现A/B测试。可以在不同的机器上应用不同的配置,不断调整、测评一段时间后找出较优的配置再全量发布配置。

-

-#### 场景介绍

-

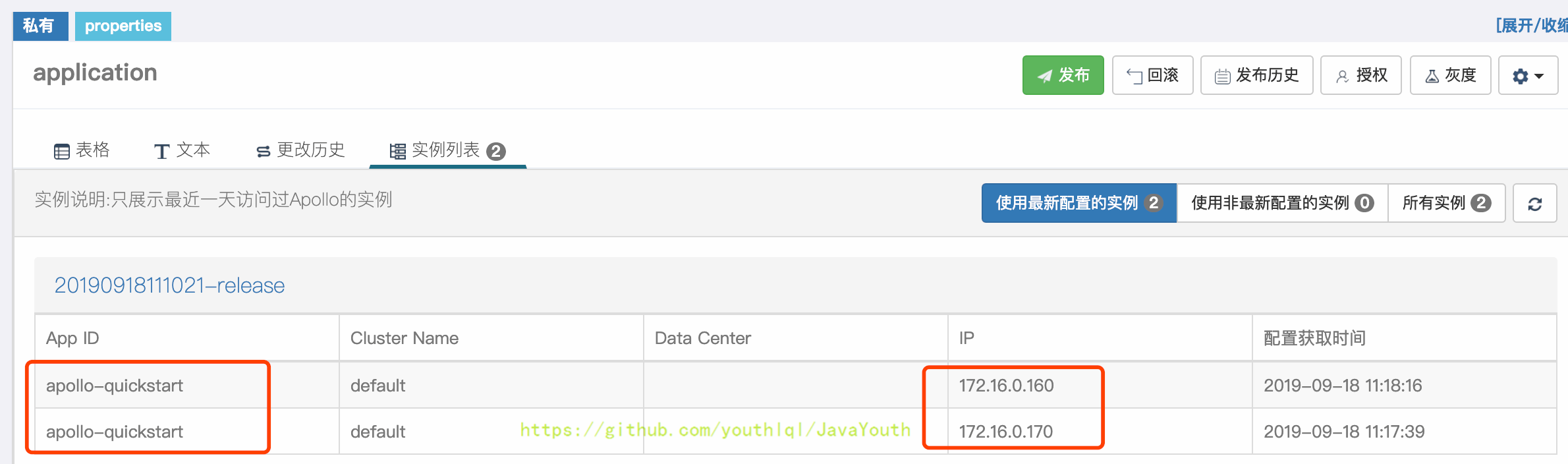

-apollo-quickstart项目有两个客户端:

-

-1. 172.16.0.160

-2. 172.16.0.170

-

-

-

-5. 从dev环境同步配置到pro

-

-

-

-#### 验证配置

-

-1. 同步完成后,切换到pro环境,修改生产环境rocketmq地址后发布配置

-

-

-

-2. 配置项目使用pro环境,测试配置是否生效

-

-* 在apollo-env.properties中增加pro.meta=[http://localhost:8081](http://localhost:8081)

-

-* 修改account-service启动参数为:-Denv=pro

-

-```bash

- -Denv=pro -Dapollo.cacheDir=/opt/data/apollo-config -Dapollo.cluster=DEFAULT

-```

-

-* 访问[http://127.0.0.1:63000/account-service/mq](http://127.0.0.1:63000/account-service/mq) 验证RocketMQ地址是否为上边设置的PRO环境的值

-

-

-

-### 灰度发布

-

-#### 定义

-

- 灰度发布是指在黑与白之间,能够平滑过渡的一种发布方式。在其上可以进行A/B testing,即让一部分用户继续用产品特性A,一部分用户开始用产品特性B,如果用户对B没有什么反对意见,那么逐步扩大范围,把所有用户都迁移到B上面来。

-

-

-

-#### Apollo实现的功能

-

-1. 对于一些对程序有比较大影响的配置,可以先在一个或者多个实例生效,观察一段时间没问题后再全量发布配置。

-2. 对于一些需要调优的配置参数,可以通过灰度发布功能来实现A/B测试。可以在不同的机器上应用不同的配置,不断调整、测评一段时间后找出较优的配置再全量发布配置。

-

-#### 场景介绍

-

-apollo-quickstart项目有两个客户端:

-

-1. 172.16.0.160

-2. 172.16.0.170

-

- -

-**灰度目标**

-

-当前有一个配置timeout=2000,我们希望对172.16.0.160灰度发布timeout=3000,对172.16.0.170仍然是timeout=2000。

-

-

-

-#### 创建灰度

-

-1. 点击application namespace右上角的`创建灰度`按钮

-

-

-

-2. 点击确定后,灰度版本就创建成功了,页面会自动切换到`灰度版本`Tab

-

-

-

-**灰度目标**

-

-当前有一个配置timeout=2000,我们希望对172.16.0.160灰度发布timeout=3000,对172.16.0.170仍然是timeout=2000。

-

-

-

-#### 创建灰度

-

-1. 点击application namespace右上角的`创建灰度`按钮

-

-

-

-2. 点击确定后,灰度版本就创建成功了,页面会自动切换到`灰度版本`Tab

-

- -

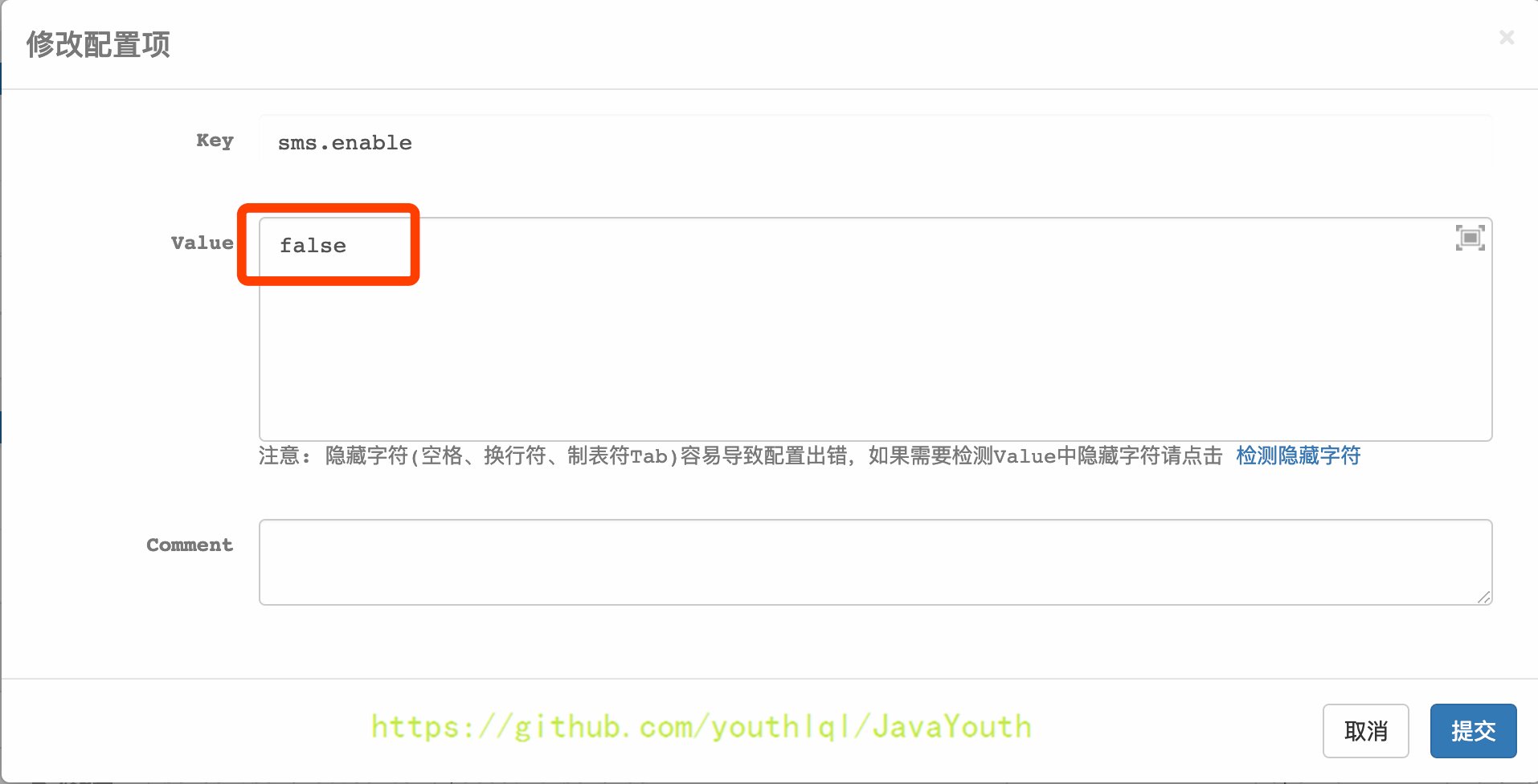

-#### 灰度配置

-

-1. 点击`主版本的配置`中,timeout配置最右侧的`对此配置灰度`按钮

-

-2. 在弹出框中填入要灰度的值:3000,点击提交

-

-

-

-#### 灰度配置

-

-1. 点击`主版本的配置`中,timeout配置最右侧的`对此配置灰度`按钮

-

-2. 在弹出框中填入要灰度的值:3000,点击提交

-

- -

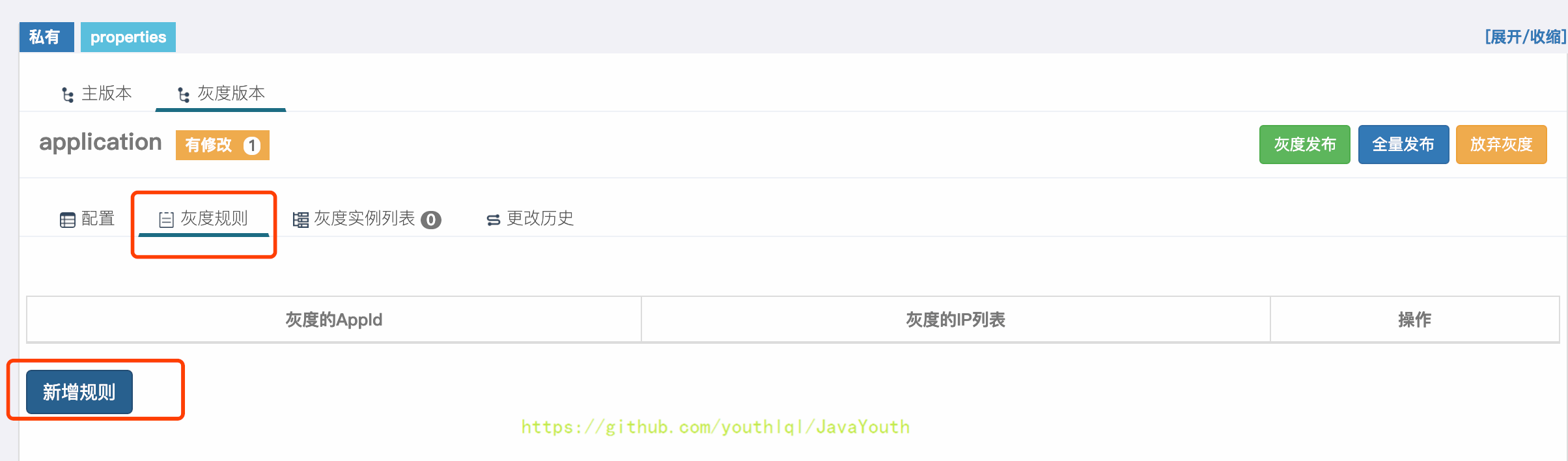

-#### 配置灰度规则

-

-1. 切换到`灰度规则`Tab,点击`新增规则`按钮

-

-

-

-#### 配置灰度规则

-

-1. 切换到`灰度规则`Tab,点击`新增规则`按钮

-

- -

-2. 在弹出框中`灰度的IP`下拉框会默认展示当前使用配置的机器列表,选择我们要灰度的IP,点击完成

-

-

-

-2. 在弹出框中`灰度的IP`下拉框会默认展示当前使用配置的机器列表,选择我们要灰度的IP,点击完成

-

- -

-如果下拉框中没找到需要的IP,说明机器还没从Apollo取过配置,可以点击手动输入IP来输入,输入完后点击添加按钮

-

-

-

-#### 灰度发布

-

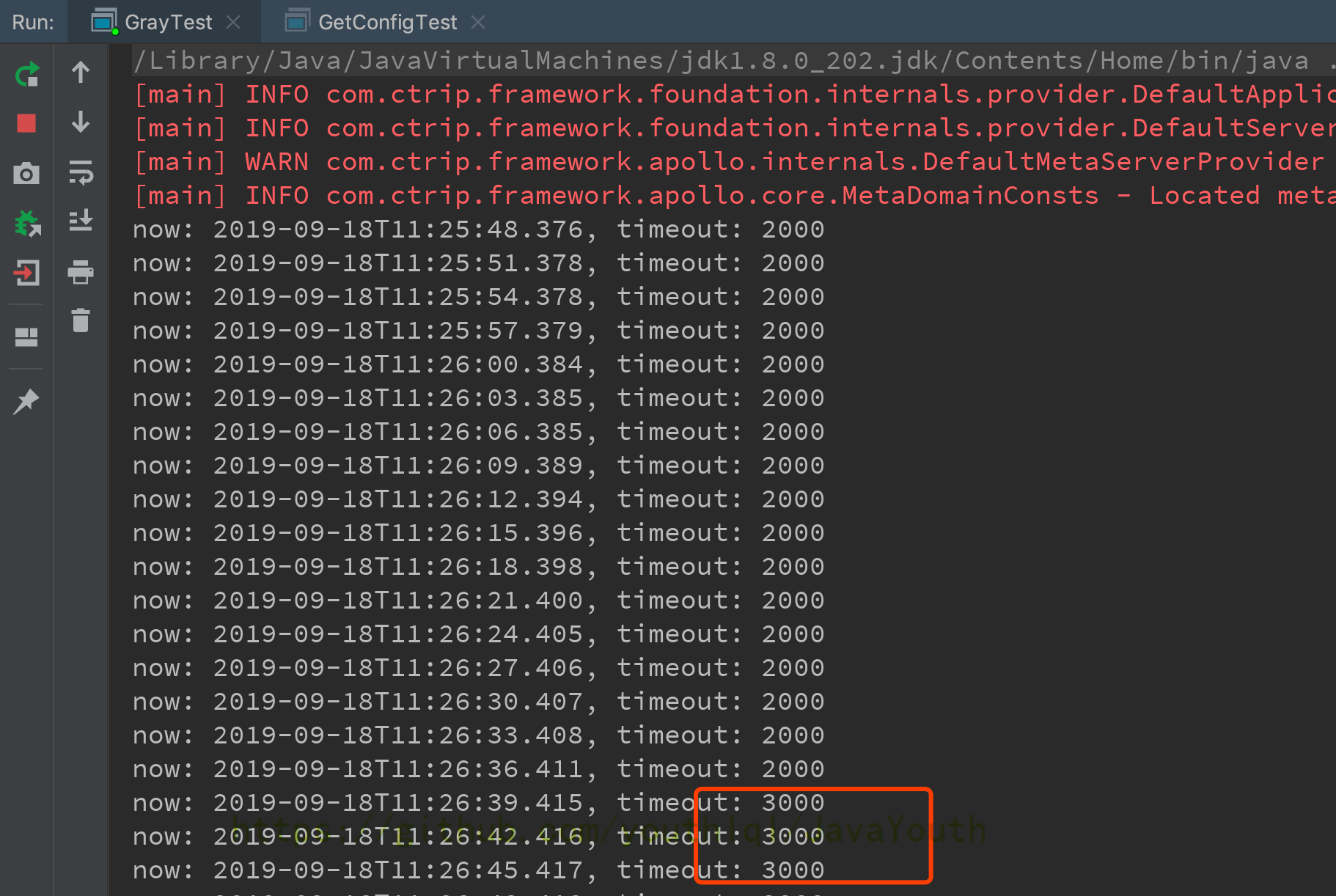

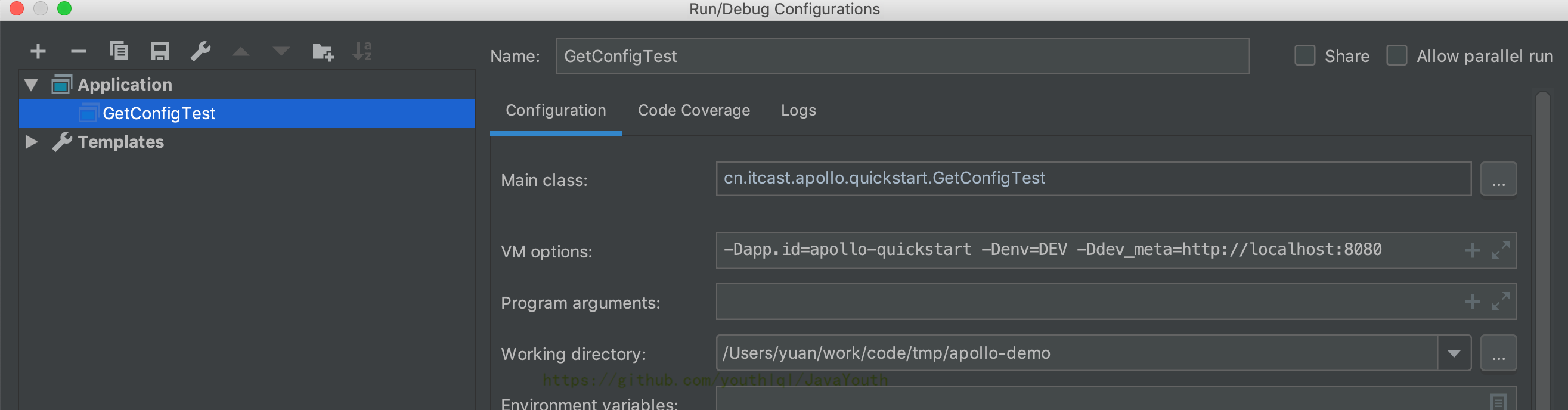

-1. 启动apollo-quickstart项目的GrayTest类输出timeout的值

-

-vm options: `-Dapp.id=apollo-quickstart -Denv=DEV -Ddev_meta=http://localhost:8080`

-

-```java

- public class GrayTest {

-

- // VM options:

- // -Dapp.id=apollo-quickstart -Denv=DEV -Ddev_meta=http://localhost:8080

- public static void main(String[] args) throws InterruptedException {

- Config config = ConfigService.getAppConfig();

- String someKey = "timeout";

-

- while (true) {

- String value = config.getProperty(someKey, null);

- System.out.printf("now: %s, timeout: %s%n", LocalDateTime.now().toString(), value);

- Thread.sleep(3000L);

- }

- }

- }

-```

-

-

-

-如果下拉框中没找到需要的IP,说明机器还没从Apollo取过配置,可以点击手动输入IP来输入,输入完后点击添加按钮

-

-

-

-#### 灰度发布

-

-1. 启动apollo-quickstart项目的GrayTest类输出timeout的值

-

-vm options: `-Dapp.id=apollo-quickstart -Denv=DEV -Ddev_meta=http://localhost:8080`

-

-```java

- public class GrayTest {

-

- // VM options:

- // -Dapp.id=apollo-quickstart -Denv=DEV -Ddev_meta=http://localhost:8080

- public static void main(String[] args) throws InterruptedException {

- Config config = ConfigService.getAppConfig();

- String someKey = "timeout";

-

- while (true) {

- String value = config.getProperty(someKey, null);

- System.out.printf("now: %s, timeout: %s%n", LocalDateTime.now().toString(), value);

- Thread.sleep(3000L);

- }

- }

- }

-```

-

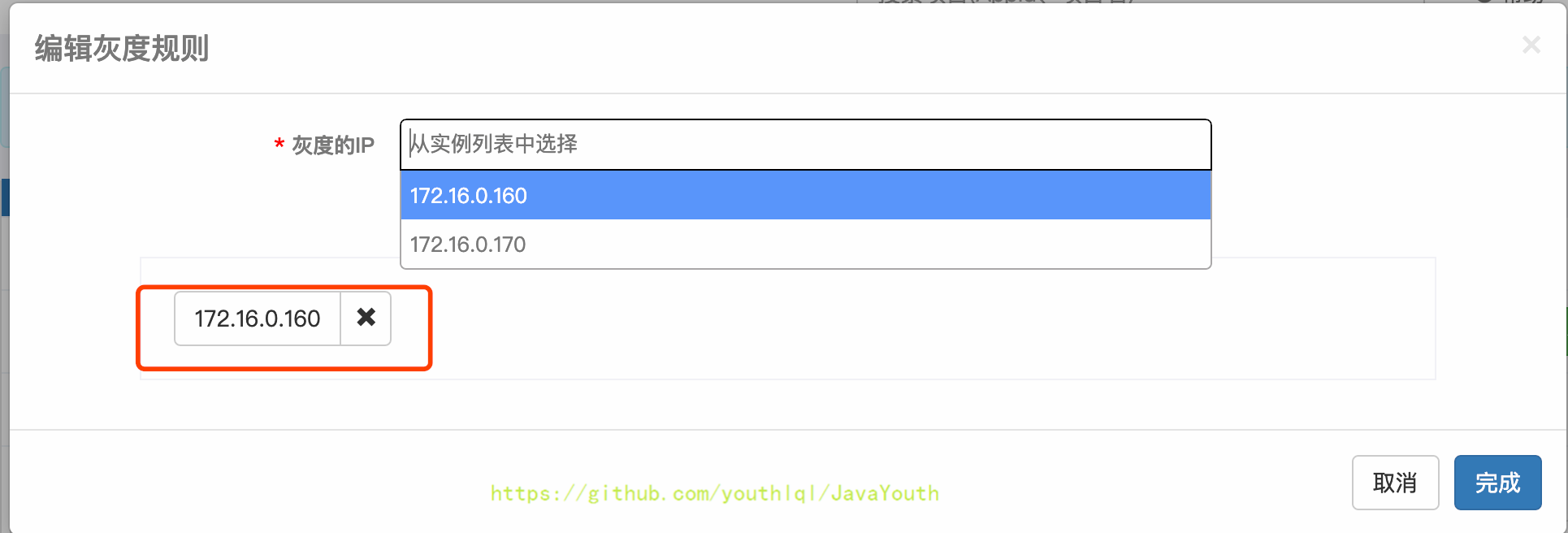

- -

-2. 切换到`配置`Tab,再次检查灰度的配置部分,如果没有问题,点击`灰度发布`

-

-

-

-2. 切换到`配置`Tab,再次检查灰度的配置部分,如果没有问题,点击`灰度发布`

-

- -

-3. 在弹出框中可以看到主版本的值是2000,灰度版本即将发布的值是3000。填入其它信息后,点击发布

-

-

-

-4. 发布后,切换到`灰度实例列表`Tab,就能看到172.16.0.160已经使用了灰度发布的值

-

-

-

-3. 在弹出框中可以看到主版本的值是2000,灰度版本即将发布的值是3000。填入其它信息后,点击发布

-

-

-

-4. 发布后,切换到`灰度实例列表`Tab,就能看到172.16.0.160已经使用了灰度发布的值

-

- -

-

-

- -

-

-

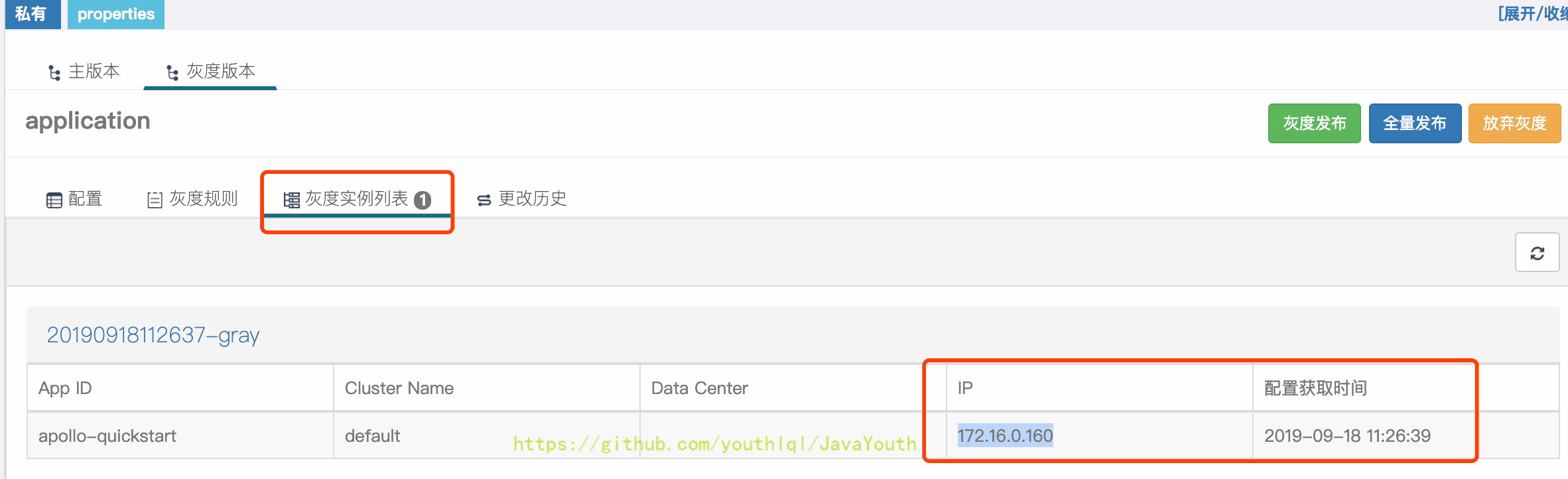

-#### 全量发布

-

-如果灰度的配置测试下来比较理想,符合预期,那么就可以操作`全量发布`。

-

-全量发布的效果是:

-

-1. 灰度版本的配置会合并回主版本,在这个例子中,就是主版本的timeout会被更新成3000

-2. 主版本的配置会自动进行一次发布

-3. 在全量发布页面,可以选择是否保留当前灰度版本,默认为不保留。

-

-

-

-#### 放弃灰度

-

-如果灰度版本不理想或者不需要了,可以点击`放弃灰度`

-

-

-

-#### 发布历史

-

-点击主版本的`发布历史`按钮,可以看到当前namespace的主版本以及灰度版本的发布历史

-

-

-

diff --git a/docs/Computer_NetWork/计算机网络-总结.md b/docs/Computer_NetWork/计算机网络-总结.md

deleted file mode 100644

index 8de79f6..0000000

--- a/docs/Computer_NetWork/计算机网络-总结.md

+++ /dev/null

@@ -1,829 +0,0 @@

----

-title: 计算机网络-总结篇

-tags:

- - 计算机网络

- - 面试

-categories:

- - 计算机网络

-keywords: 计算机网络,计网,面试

-description: 计算机网络-总结篇,可以用来期末复习,校招面试等。

-cover: 'https://npm.elemecdn.com/lql_static@latest/logo/network.jpg'

-abbrlink: 3905e6f8

-date: 2020-04-16 17:21:58

----

-

-

-

-# 备注

-

-1、打【】的是有印象,能大致说出来即可,但是没打【】的也不要背,理解性记忆。

-

-2、如果有知识点,有的博客讲的很清楚,我就直接贴链接了。

-

-3、《计算机网络7》是一本很好的书,讲的很详细,而且不难懂,读者有时间的话,建议看一下。

-

-4、如果有错误,欢迎在评论区指正

-

-> 1、本人正在准备秋招,秋招完之后会持续更新博客。这些总结的部分,也是准备面试期间看了很多很多博客写下来的。

-> 2、本人博客:https://youthlql.gitee.io/

-> 3、等忙完秋招,会陆续更新一些内容。喜欢的朋友可以收藏一下博客

->

-

-# 补充

-

-这里面的就是讲的比较详细的博客

-

-## 关于计网比较好的博客

-

-https://blog.csdn.net/ThinkWon/article/details/104903925

-

-https://www.cnblogs.com/xjtu-lyh/p/12439036.html

-

-

-

-## 三次挥手,四次握手

-

-https://blog.csdn.net/qzcsu/article/details/72861891

-

-

-

-## DNS解析

-

-https://blog.csdn.net/weixin_40470303/article/details/80642190

-

-

-

-## http1.0,http1.1,http2.0介绍

-

-https://segmentfault.com/a/1190000016656529

-

-

-

-

-

-## https建立链接过程

-

-https://blog.csdn.net/iispring/article/details/51615631

-

-

-

-

-

-

-

-

-

-

-

-# OSI七层模型与TCP/IP 五层模型

-

-## 物理层

-

- 物理层考虑的是怎样才能在连接各种计算机的传输介质上传输数据比特流。现有的计算机网络中的硬件设备和传输媒体(介质)的种类非常多,而通信手段也有许多不同方式。物理层的作用正是要尽可能地屏蔽掉这些传输媒体和硬件设备的差异,使物理层上面的数据链路层感觉不到这些差异,这样就可使数据链路层只考虑如何完成本层的协议和服务,而不必考虑网络具体的传输媒体和通信手段是什么。

-

-> 参考《计算机网络7》P51

-

-

-

-## 数据链路层

-

-

-

-### 概念

-

- 数据链路层研究的是分组怎样从一台主机传送到另一台主机,但并不经过路由器转发。从整个互联网来看,局域网仍属于数据链路层的范围。数据传送单位是帧。

-

-**简单的过程:**

-

-1、在两个相邻节点之间传送数据时,数据链路层将网络层交下来的**IP 数据报**添加首部和尾部组装成帧**,**在两个相邻节点间的链路上传送帧**。**每一帧包括数据和必要的控制信息【如同步信息,地址信息,差错控制等】。

-

-2、数据链路层在收到一个帧后,通过控制信息检测收到的帧中是否有差错,如果没有就可从中提出**IP数据报**部分,上交给网络层**。**如果发现差错,数据链路层就简单地丢弃这个出了差错的帧,以避免继续在网络中传送下去白白浪费网络资源 【在接收数据时,控制信息使接收端能够知道一个帧从哪个比特开始和到哪个比特结束。控制信息还使接收端能够检测到所收到的帧中有误差错。如果发现差错,数据链路层就简单地丢弃这个出了差错的帧,以避免继续在网络中传送下去白白浪费网络资源。如果需要改正数据在链路层传输时出现差错(这就是说,数据链路层不仅要检错,而且还要纠错),那么就要采用可靠性传输协议来纠正出现的差错。这种方法会使链路层的协议复杂些】

-

-

-

-### 一些小细节

-

-

-

-**数据链路层使用的信道主要有两种:**

-

-①点对点信道

-

-②广播信道

-

- **三个基本问题:**

-

-封装成帧、透明传输和差错检测。

-

-> 更细致的看《计算机网络7》 P82

-

-

-

-

-

-## 网络层

-

-1、在计算机网络中进行通信的两个计算机之间可能会经过很多个数据链路,也可能还要经过很多通信子网。网络层的任务就是选择合适的网间路由和交换结点,确保数据及时传送。网络层向上只提供简单灵活的、无连接的、尽最大努力交付的IP数据报服务。【其实数据报或IP数据报就是我们经常使用的“分组”】

-

-2、网络层在发送分组时不需要先建立连接,没有给分组进行上编号,所传送的分组可能出错、丢失、重复和失序。如果主机(即端系统)中的进程之间的通信需要是可靠的,那么就由网络的主机中的运输层负责(包括差错处理、流量控制等)

-

-

-

-> 更多细节-->《计算机网络7》 P124

-

-

-

-

-

-## 运输层

-

-

-

-1、运输层的主要任务就是负责向两台主机的进程之间提供通用的数据传输服务。

-

-2、运输层有一个很重要的功能 复用和分用。这里的“复用"是指在发送方不同的应用进程都可以使用同一个运输层协议传送数据(当然需要加上适当的首部),而“分用”是指接收方的运输层在剥去报文的首部后能够把这些数据正确交付目的应用进程

-

-3、运输层向高层用户屏蔽了下面网络核心的细节【如网络拓扑、所采用的路由选择协议等】,**它使应用进程看见的就是好像在两个运输层实体之间有一条端到端的逻辑通信信道**。但这条逻辑通信信道对上层的表现却因运输层使用的不同协议而有很大的差别。当运输层釆用面向连接的TCP协议时,尽管下面的网络层是不可靠的(只提供尽最大努力服务),但这种逻辑通信信道就相当于一条全双工的可靠信道。但当运输层采用无连接的udp协议时,这种逻辑通信信道仍然是一条不可靠信道。

-

-

-

-

-

-## 应用层

-

-(在上一章,我们巳学习了运输层为应用进程提供了端到端的通信服务)。

-

-**1.** **不同的网络应用的应用进程之间,还需要有不同的通信规则。因此在运输层协议之上,还需要有应用层协议****。**

-

-**2.** **每个应用层协议都是为了解决某一类应用问题,**(而问题的解决又必须通过位于不同主机中的多个应用进程之间的通信和协同工作来完成)**。应用进程之间的这种通信必须遵循严格的规则。应用层的具体内容就是精确定义这些通信规则。**

-

-3.**运输层是两台主机间进程的交互。应用层是为了更加细化不同网络应用的交互规则。**

-

-

-

-

-

-# 常见应用层协议和运输层、网络层协议

-

-## 各层协议

-

-**应用层:**HTTP(超文本传输协议) ,DNS(域名系统) ,FTP(文件传输协议) ,SMTP(简单邮件传送协议)

-

-**运输层:**TCP ,UDP

-

-**网络层:** IP, ARP(地址解析协议)--> 见《计网7》P134

-

-

-

-## 硬件如路由器之类在哪一层

-

-- 路由器在网络层,用来进行路由选择

-

-

-

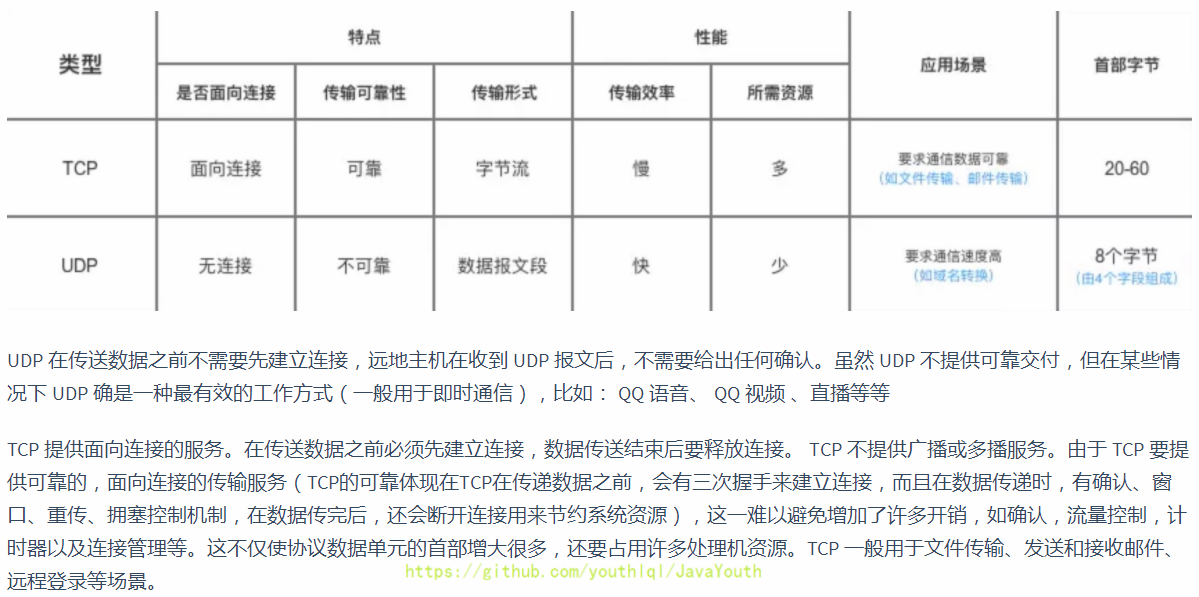

-# TCP与UDP区别和应用场景,基于TCP的协议有哪些,基于UDP的有哪些

-

-## 区别+应用场景

-

-

-

-

-

-#### 全量发布

-

-如果灰度的配置测试下来比较理想,符合预期,那么就可以操作`全量发布`。

-

-全量发布的效果是:

-

-1. 灰度版本的配置会合并回主版本,在这个例子中,就是主版本的timeout会被更新成3000

-2. 主版本的配置会自动进行一次发布

-3. 在全量发布页面,可以选择是否保留当前灰度版本,默认为不保留。

-

-

-

-#### 放弃灰度

-

-如果灰度版本不理想或者不需要了,可以点击`放弃灰度`

-

-

-

-#### 发布历史

-

-点击主版本的`发布历史`按钮,可以看到当前namespace的主版本以及灰度版本的发布历史

-

-

-

diff --git a/docs/Computer_NetWork/计算机网络-总结.md b/docs/Computer_NetWork/计算机网络-总结.md

deleted file mode 100644

index 8de79f6..0000000

--- a/docs/Computer_NetWork/计算机网络-总结.md

+++ /dev/null

@@ -1,829 +0,0 @@

----

-title: 计算机网络-总结篇

-tags:

- - 计算机网络

- - 面试

-categories:

- - 计算机网络

-keywords: 计算机网络,计网,面试

-description: 计算机网络-总结篇,可以用来期末复习,校招面试等。

-cover: 'https://npm.elemecdn.com/lql_static@latest/logo/network.jpg'

-abbrlink: 3905e6f8

-date: 2020-04-16 17:21:58

----

-

-

-

-# 备注

-

-1、打【】的是有印象,能大致说出来即可,但是没打【】的也不要背,理解性记忆。

-

-2、如果有知识点,有的博客讲的很清楚,我就直接贴链接了。

-

-3、《计算机网络7》是一本很好的书,讲的很详细,而且不难懂,读者有时间的话,建议看一下。

-

-4、如果有错误,欢迎在评论区指正

-

-> 1、本人正在准备秋招,秋招完之后会持续更新博客。这些总结的部分,也是准备面试期间看了很多很多博客写下来的。

-> 2、本人博客:https://youthlql.gitee.io/

-> 3、等忙完秋招,会陆续更新一些内容。喜欢的朋友可以收藏一下博客

->

-

-# 补充

-

-这里面的就是讲的比较详细的博客

-

-## 关于计网比较好的博客

-

-https://blog.csdn.net/ThinkWon/article/details/104903925

-

-https://www.cnblogs.com/xjtu-lyh/p/12439036.html

-

-

-

-## 三次挥手,四次握手

-

-https://blog.csdn.net/qzcsu/article/details/72861891

-

-

-

-## DNS解析

-

-https://blog.csdn.net/weixin_40470303/article/details/80642190

-

-

-

-## http1.0,http1.1,http2.0介绍

-

-https://segmentfault.com/a/1190000016656529

-

-

-

-

-

-## https建立链接过程

-

-https://blog.csdn.net/iispring/article/details/51615631

-

-

-

-

-

-

-

-

-

-

-

-# OSI七层模型与TCP/IP 五层模型

-

-## 物理层

-

- 物理层考虑的是怎样才能在连接各种计算机的传输介质上传输数据比特流。现有的计算机网络中的硬件设备和传输媒体(介质)的种类非常多,而通信手段也有许多不同方式。物理层的作用正是要尽可能地屏蔽掉这些传输媒体和硬件设备的差异,使物理层上面的数据链路层感觉不到这些差异,这样就可使数据链路层只考虑如何完成本层的协议和服务,而不必考虑网络具体的传输媒体和通信手段是什么。

-

-> 参考《计算机网络7》P51

-

-

-

-## 数据链路层

-

-

-

-### 概念

-

- 数据链路层研究的是分组怎样从一台主机传送到另一台主机,但并不经过路由器转发。从整个互联网来看,局域网仍属于数据链路层的范围。数据传送单位是帧。

-

-**简单的过程:**

-

-1、在两个相邻节点之间传送数据时,数据链路层将网络层交下来的**IP 数据报**添加首部和尾部组装成帧**,**在两个相邻节点间的链路上传送帧**。**每一帧包括数据和必要的控制信息【如同步信息,地址信息,差错控制等】。

-

-2、数据链路层在收到一个帧后,通过控制信息检测收到的帧中是否有差错,如果没有就可从中提出**IP数据报**部分,上交给网络层**。**如果发现差错,数据链路层就简单地丢弃这个出了差错的帧,以避免继续在网络中传送下去白白浪费网络资源 【在接收数据时,控制信息使接收端能够知道一个帧从哪个比特开始和到哪个比特结束。控制信息还使接收端能够检测到所收到的帧中有误差错。如果发现差错,数据链路层就简单地丢弃这个出了差错的帧,以避免继续在网络中传送下去白白浪费网络资源。如果需要改正数据在链路层传输时出现差错(这就是说,数据链路层不仅要检错,而且还要纠错),那么就要采用可靠性传输协议来纠正出现的差错。这种方法会使链路层的协议复杂些】

-

-

-

-### 一些小细节

-

-

-

-**数据链路层使用的信道主要有两种:**

-

-①点对点信道

-

-②广播信道

-

- **三个基本问题:**

-

-封装成帧、透明传输和差错检测。

-

-> 更细致的看《计算机网络7》 P82

-

-

-

-

-

-## 网络层

-

-1、在计算机网络中进行通信的两个计算机之间可能会经过很多个数据链路,也可能还要经过很多通信子网。网络层的任务就是选择合适的网间路由和交换结点,确保数据及时传送。网络层向上只提供简单灵活的、无连接的、尽最大努力交付的IP数据报服务。【其实数据报或IP数据报就是我们经常使用的“分组”】

-

-2、网络层在发送分组时不需要先建立连接,没有给分组进行上编号,所传送的分组可能出错、丢失、重复和失序。如果主机(即端系统)中的进程之间的通信需要是可靠的,那么就由网络的主机中的运输层负责(包括差错处理、流量控制等)

-

-

-

-> 更多细节-->《计算机网络7》 P124

-

-

-

-

-

-## 运输层

-

-

-

-1、运输层的主要任务就是负责向两台主机的进程之间提供通用的数据传输服务。

-

-2、运输层有一个很重要的功能 复用和分用。这里的“复用"是指在发送方不同的应用进程都可以使用同一个运输层协议传送数据(当然需要加上适当的首部),而“分用”是指接收方的运输层在剥去报文的首部后能够把这些数据正确交付目的应用进程

-

-3、运输层向高层用户屏蔽了下面网络核心的细节【如网络拓扑、所采用的路由选择协议等】,**它使应用进程看见的就是好像在两个运输层实体之间有一条端到端的逻辑通信信道**。但这条逻辑通信信道对上层的表现却因运输层使用的不同协议而有很大的差别。当运输层釆用面向连接的TCP协议时,尽管下面的网络层是不可靠的(只提供尽最大努力服务),但这种逻辑通信信道就相当于一条全双工的可靠信道。但当运输层采用无连接的udp协议时,这种逻辑通信信道仍然是一条不可靠信道。

-

-

-

-

-

-## 应用层

-

-(在上一章,我们巳学习了运输层为应用进程提供了端到端的通信服务)。

-

-**1.** **不同的网络应用的应用进程之间,还需要有不同的通信规则。因此在运输层协议之上,还需要有应用层协议****。**

-

-**2.** **每个应用层协议都是为了解决某一类应用问题,**(而问题的解决又必须通过位于不同主机中的多个应用进程之间的通信和协同工作来完成)**。应用进程之间的这种通信必须遵循严格的规则。应用层的具体内容就是精确定义这些通信规则。**

-

-3.**运输层是两台主机间进程的交互。应用层是为了更加细化不同网络应用的交互规则。**

-

-

-

-

-

-# 常见应用层协议和运输层、网络层协议

-

-## 各层协议

-

-**应用层:**HTTP(超文本传输协议) ,DNS(域名系统) ,FTP(文件传输协议) ,SMTP(简单邮件传送协议)

-

-**运输层:**TCP ,UDP

-

-**网络层:** IP, ARP(地址解析协议)--> 见《计网7》P134

-

-

-

-## 硬件如路由器之类在哪一层

-

-- 路由器在网络层,用来进行路由选择

-

-

-

-# TCP与UDP区别和应用场景,基于TCP的协议有哪些,基于UDP的有哪些

-

-## 区别+应用场景

-

- -

-**总结:**

-

-1、UDP的主要特点是

-

-①无连接②尽最大努力交付③面向报文④无拥塞控制⑤支持一对一,一对多,多对一和多对多的交互通信⑥首部开销小(只有四个字段:源端口,目的端口,长度和检验和)

-

-2、TCP的主要特点是

-

-①面向连接②每一条TCP连接只能是一对一的③提供可靠交付④提供全双工通信⑤面向字节流

-

-

-

-## 基于TCP的协议有哪些,基于UDP的有哪些

-

-**TCP:**

-

-HTTP, 超文本传输协议

-

-FTP, 文件传输协议

-

-SMTP,简单邮件传输协议,用来发送电子邮件

-

-SSH 安全外壳协议,用于加密安全登陆

-

-**UDP:**

-

-DHCP协议:动态主机配置协议,动态配置IP地址

-

-NTP协议:网络时间协议,用于网络时间同步

-

-RIP(路由选择协议)

-

-DNS

-

-

-

-# TCP可靠传输的保证,拥塞控制目的和过程

-

-## 如何保证可靠传输

-

-TCP通过三次握手建立可靠连接

-

-①数据被分割成 TCP 认为最适合发送的数据包。TCP 给发送的每一个包进行编号,接收方对数据包进行排序,将有序数据传送给应用层。**TCP通过序列号和确认应答提高可靠性**

-

-②校验和: TCP 将保持它首部和数据的检验和。这是一个端到端的检验和,目的是检测数据在传输过程中的任何变化。如果收到端的校验和有差错,TCP 将丢弃这个报文段和不确认收到此报文段。

-

-③流量控制: TCP 利用滑动窗口实现流量控制。流量控制是为了控制发送方发送速率,保证接收方来得及接收。 接收方发送的确认报文中的窗口字段可以用来控制发送方窗口大小,从而影响发送方的发送速率。

-

-④拥塞控制: 当网络拥塞时,减少数据的发送。

-

-⑤ARQ协议:分为停止等待ARQ协议和连续ARQ协议

-

-5.1 它的基本原理就是每发完一个分组就停止发送,等待对方确认。在收到确认后再发下一个分组。

-

-5.2 超时重传::当 TCP 发出一个报文段后,它启动一个定时器,等待目的端确认收到这个报文段。如果不能及时收到一个确认,将重发这个报文段。

-

-5.3 TCP 的接收端会丢弃重复的数据

-

-

-

-## ARQ

-

-- 停止等待ARQ:它的基本原理就是每发完一个分组就停止发送,等待对方确认(回复ACK)。如果过了一段时间(超时时间后),还是没有收到 ACK 确认,说明没有发送成功,需要重新发送,直到收到确认后再发下一个分组。停止等待协议中超时重传是指只要超过一段时间仍然没有收到确认,就重传前面发送过的分组(认为刚才发送过的分组丢失了)。因此每发送完一个分组需要设置一个超时计时器,其重转时间应比数据在分组传输的平均往返时间更长一些。这种自动重传方式常称为自动重传请求ARQ。另外在停止等待协议中若收到重复分组,就丢弃该分组,但同时还要发送确认。

-

-- 连续ARQ协议:(流水线的传输方式)可提高信道利用率。发送维持一个发送窗口,凡位于发送窗口内的分组可连续发送出去,而不需要等待对方确认。接收方一般采用累积确认,对按序到达的最后一个分组发送确认,表明到这个分组位置的所有分组都已经正确收到了。

-

-

-

-

-

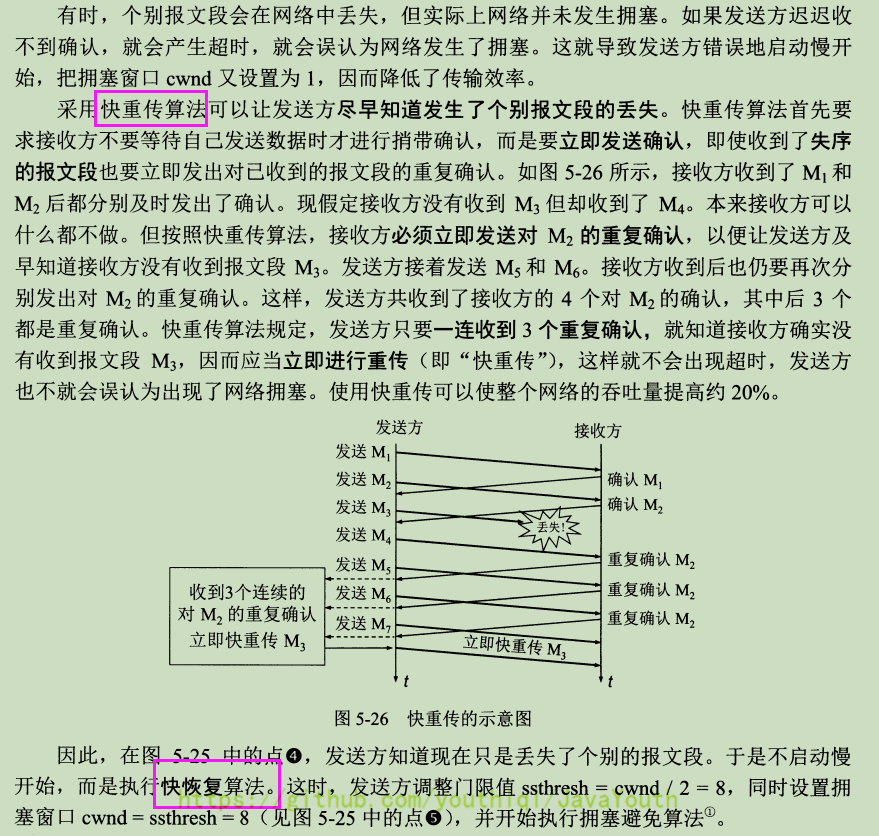

-## 拥塞控制

-

-**目的:**

-

-拥塞控制就是为了防止过多的数据注入到网络中,这样就可以使网络中的路由器或链路不致过载。拥塞控制是一个全局性的过程,涉及到所有的主机,所有的路由器,以及与降低网络传输性能有关的所有因素。相反,流量控制往往是点对点通信量的控制,是个端到端的问题。流量控制所要做到的就是抑制发送端发送数据的速率,以便使接收端来得及接收。

-

-

-

-**过程:**

-

-为了进行拥塞控制,TCP 发送方要维持一个 拥塞窗口(cwnd) 的状态变量。拥塞控制窗口的大小取决于网络的拥塞程度,并且动态变化。发送方让自己的发送窗口取为拥塞窗口和接收方的接受窗口中较小的一个。**慢开始和拥塞避免都是基于窗口的拥塞控制**。

-

-

-

-**区别:**

-

-> https://blog.csdn.net/ligupeng7929/article/details/79597423

-

-* **慢开始:** 慢开始算法的思路是当主机开始发送数据时,如果立即把大量数据字节注入到网络,那么可能会引起网络阻塞,因为现在还不知道网络的符合情况。经验表明,较好的方法是先探测一下,即由小到大逐渐增大发送窗口,也就是由小到大逐渐增大拥塞窗口数值。cwnd初始值为1,每经过一个传播轮次,cwnd加倍。

-* **拥塞避免:** 拥塞避免算法的思路是让拥塞窗口cwnd缓慢增大,即每经过一个往返时间RTT就把发送放的cwnd加1.

-

-- 为了防止拥塞窗口cwnd增长过大引起网络拥塞,还需要设置一个慢开始门限ssthresh状态变量(如何设置ssthresh)。慢开始门限ssthresh的用法如下:

-

- 当 cwnd < ssthresh 时,使用上述的慢开始算法。

-

- 当 cwnd > ssthresh 时,停止使用慢开始算法而改用拥塞避免算法。

-

- 当 cwnd = ssthresh 时,既可使用慢开始算法,也可使用拥塞控制避免算法。

-

-- 拥塞避免算法:让拥塞窗口cwnd缓慢地增大,即每经过一个往返时间RTT就把发送方的拥塞窗口cwnd加1,而不是加倍。这样拥塞窗口cwnd按线性规律缓慢增长,比慢开始算法的拥塞窗口增长速率缓慢得多。

-

-**快重传和快恢复:**

-

-1、**快重传**算法首先要求接收方每收到一个失序的报文段后就立即发出重复确认(为的是使发送方及早知道有报文段没有到达对方)而不要等到自己发送数据时才进行捎带确认。

-

-2、发送方知道现在只是丢失了个别的报文段。于是不启动慢开始,而是执行**快恢复算法**。这时,发送方调整门限值ssthresh= (cwnd/2=8,,同时设置拥塞窗口cwnd = ssthresh=8 ,并开始执行拥塞避免算法。

-

-3、请注意,也有的快恢复实现是把快恢复开始时的拥塞窗口cwnd值再增大一一些(增大3个报文段的长度),即等于新的ssthresh + 3 x MSS。这样做的理由是:既然发送方收到3个重复的确认,就表明有3个分组已经离开了网络。这3个分组不再消耗网络的资源而是停留在接收方的缓存中(接收方发送出3个重复的确认就证明了这个事实)。可见现在网络中并不是堆积了分组而是减少了3个分组。因此可以适当把拥塞窗口扩大些。

-

-

-

-在采用快恢复算法时,慢开始算法只是在TCP连接建立时和网络出现超时时才使用。

-

-

-

-**总结:**

-

-1、UDP的主要特点是

-

-①无连接②尽最大努力交付③面向报文④无拥塞控制⑤支持一对一,一对多,多对一和多对多的交互通信⑥首部开销小(只有四个字段:源端口,目的端口,长度和检验和)

-

-2、TCP的主要特点是

-

-①面向连接②每一条TCP连接只能是一对一的③提供可靠交付④提供全双工通信⑤面向字节流

-

-

-

-## 基于TCP的协议有哪些,基于UDP的有哪些

-

-**TCP:**

-

-HTTP, 超文本传输协议

-

-FTP, 文件传输协议

-

-SMTP,简单邮件传输协议,用来发送电子邮件

-

-SSH 安全外壳协议,用于加密安全登陆

-

-**UDP:**

-

-DHCP协议:动态主机配置协议,动态配置IP地址

-

-NTP协议:网络时间协议,用于网络时间同步

-

-RIP(路由选择协议)

-

-DNS

-

-

-

-# TCP可靠传输的保证,拥塞控制目的和过程

-

-## 如何保证可靠传输

-

-TCP通过三次握手建立可靠连接

-

-①数据被分割成 TCP 认为最适合发送的数据包。TCP 给发送的每一个包进行编号,接收方对数据包进行排序,将有序数据传送给应用层。**TCP通过序列号和确认应答提高可靠性**

-

-②校验和: TCP 将保持它首部和数据的检验和。这是一个端到端的检验和,目的是检测数据在传输过程中的任何变化。如果收到端的校验和有差错,TCP 将丢弃这个报文段和不确认收到此报文段。

-

-③流量控制: TCP 利用滑动窗口实现流量控制。流量控制是为了控制发送方发送速率,保证接收方来得及接收。 接收方发送的确认报文中的窗口字段可以用来控制发送方窗口大小,从而影响发送方的发送速率。

-

-④拥塞控制: 当网络拥塞时,减少数据的发送。

-

-⑤ARQ协议:分为停止等待ARQ协议和连续ARQ协议

-

-5.1 它的基本原理就是每发完一个分组就停止发送,等待对方确认。在收到确认后再发下一个分组。

-

-5.2 超时重传::当 TCP 发出一个报文段后,它启动一个定时器,等待目的端确认收到这个报文段。如果不能及时收到一个确认,将重发这个报文段。

-

-5.3 TCP 的接收端会丢弃重复的数据

-

-

-

-## ARQ

-

-- 停止等待ARQ:它的基本原理就是每发完一个分组就停止发送,等待对方确认(回复ACK)。如果过了一段时间(超时时间后),还是没有收到 ACK 确认,说明没有发送成功,需要重新发送,直到收到确认后再发下一个分组。停止等待协议中超时重传是指只要超过一段时间仍然没有收到确认,就重传前面发送过的分组(认为刚才发送过的分组丢失了)。因此每发送完一个分组需要设置一个超时计时器,其重转时间应比数据在分组传输的平均往返时间更长一些。这种自动重传方式常称为自动重传请求ARQ。另外在停止等待协议中若收到重复分组,就丢弃该分组,但同时还要发送确认。

-

-- 连续ARQ协议:(流水线的传输方式)可提高信道利用率。发送维持一个发送窗口,凡位于发送窗口内的分组可连续发送出去,而不需要等待对方确认。接收方一般采用累积确认,对按序到达的最后一个分组发送确认,表明到这个分组位置的所有分组都已经正确收到了。

-

-

-

-

-

-## 拥塞控制

-

-**目的:**

-

-拥塞控制就是为了防止过多的数据注入到网络中,这样就可以使网络中的路由器或链路不致过载。拥塞控制是一个全局性的过程,涉及到所有的主机,所有的路由器,以及与降低网络传输性能有关的所有因素。相反,流量控制往往是点对点通信量的控制,是个端到端的问题。流量控制所要做到的就是抑制发送端发送数据的速率,以便使接收端来得及接收。

-

-

-

-**过程:**

-

-为了进行拥塞控制,TCP 发送方要维持一个 拥塞窗口(cwnd) 的状态变量。拥塞控制窗口的大小取决于网络的拥塞程度,并且动态变化。发送方让自己的发送窗口取为拥塞窗口和接收方的接受窗口中较小的一个。**慢开始和拥塞避免都是基于窗口的拥塞控制**。

-

-

-

-**区别:**

-

-> https://blog.csdn.net/ligupeng7929/article/details/79597423

-

-* **慢开始:** 慢开始算法的思路是当主机开始发送数据时,如果立即把大量数据字节注入到网络,那么可能会引起网络阻塞,因为现在还不知道网络的符合情况。经验表明,较好的方法是先探测一下,即由小到大逐渐增大发送窗口,也就是由小到大逐渐增大拥塞窗口数值。cwnd初始值为1,每经过一个传播轮次,cwnd加倍。

-* **拥塞避免:** 拥塞避免算法的思路是让拥塞窗口cwnd缓慢增大,即每经过一个往返时间RTT就把发送放的cwnd加1.

-

-- 为了防止拥塞窗口cwnd增长过大引起网络拥塞,还需要设置一个慢开始门限ssthresh状态变量(如何设置ssthresh)。慢开始门限ssthresh的用法如下:

-

- 当 cwnd < ssthresh 时,使用上述的慢开始算法。

-

- 当 cwnd > ssthresh 时,停止使用慢开始算法而改用拥塞避免算法。

-

- 当 cwnd = ssthresh 时,既可使用慢开始算法,也可使用拥塞控制避免算法。

-

-- 拥塞避免算法:让拥塞窗口cwnd缓慢地增大,即每经过一个往返时间RTT就把发送方的拥塞窗口cwnd加1,而不是加倍。这样拥塞窗口cwnd按线性规律缓慢增长,比慢开始算法的拥塞窗口增长速率缓慢得多。

-

-**快重传和快恢复:**

-

-1、**快重传**算法首先要求接收方每收到一个失序的报文段后就立即发出重复确认(为的是使发送方及早知道有报文段没有到达对方)而不要等到自己发送数据时才进行捎带确认。

-

-2、发送方知道现在只是丢失了个别的报文段。于是不启动慢开始,而是执行**快恢复算法**。这时,发送方调整门限值ssthresh= (cwnd/2=8,,同时设置拥塞窗口cwnd = ssthresh=8 ,并开始执行拥塞避免算法。

-

-3、请注意,也有的快恢复实现是把快恢复开始时的拥塞窗口cwnd值再增大一一些(增大3个报文段的长度),即等于新的ssthresh + 3 x MSS。这样做的理由是:既然发送方收到3个重复的确认,就表明有3个分组已经离开了网络。这3个分组不再消耗网络的资源而是停留在接收方的缓存中(接收方发送出3个重复的确认就证明了这个事实)。可见现在网络中并不是堆积了分组而是减少了3个分组。因此可以适当把拥塞窗口扩大些。

-

-

-

-在采用快恢复算法时,慢开始算法只是在TCP连接建立时和网络出现超时时才使用。

-

- -

-

-

-

-

-

-

-## 为什么要进行流量控制

-

-一般来说,我们总是希望数据传输更快一些。但如果发送方把数据发送的过快,接收方就可能来不及接收,这就会造成数据的丢失(丢包)。

-

-

-

-

-

-# TCP粘包现象原因和解决方法

-

-

-

-## 原因

-

-1.UDP协议的保护消息边界使得每一个消息都是独立的

-

-2.而tcp是基于流的传输,流传输却把数据当作一串数据流,他不认为数据是一个一个的消息

-

-3.发送端需要等缓冲区满才发送出去,造成粘包

-

-4.接收方不及时接收缓冲区的包,造成多个包粘包

-

-具体点:

-

-(1)发送方引起的粘包是由TCP协议本身造成的,TCP为提高传输效率,发送方往往要收集到足够多的数据后才发送一包数据。若连续几次发送的数据都很少,通常TCP会根据优化算法把这些数据合成一包后一次发送出去,这样接收方就收到了粘包数据。

-

-(2)接收方引起的粘包是由于接收方用户进程不及时接收数据,从而导致粘包现象。这是因为接收方先把收到的数据放在系统接收缓冲区,用户进程从该缓冲区取数据,若下一包数据到达时前一包数据尚未被用户进程取走,则下一包数据放到系统接收缓冲区时就接到前一包数据之后,而用户进程根据预先设定的缓冲区大小从系统接收缓冲区取数据,这样就一次取到了多包数据。

-

-

-

-## 解决方法

-

-(1)对于发送方引起的粘包现象,用户可通过编程设置来避免,TCP提供了强制数据立即传送的操作指令push,TCP程序收到该操作指令后,就立即将本段数据发送出去,而不必等待发送缓冲区满;

-

-(2)对于接收方引起的粘包,则可通过优化程序设计、精简接收进程工作量、提高接收进程优先级等措施,使其及时接收数据,从而尽量避免出现粘包现象;

-

-(3)由接收方控制,将一包数据按结构字段,人为控制分多次接收,然后合并,通过这种手段来避免粘包。

-

-

-

-## 为什么粘包需要处理?

-

-不是所有的粘包现象都需要处理,若传输的数据为不带结构的连续流数据(如文件传输),则不必把粘连的包分开(简称分包)。但在实际工程应用中,传输的数据一般为带结构的数据,这时就需要做分包处理。分包一般难度较大,所以尽量避免粘包

-

-

-

-

-

-# 三次握手相关问题

-

-

-

-## 过程+状态改变

-

-把**补充**里面的**第二个博客**的过程背下来。(有的地方需要参考第一个博客)

-

-

-

-## 为什么三次,两次为什么不行?

-

-### 第一种答案

-

-两次握手只能保证单向连接是畅通的。只有经过第三次握手,才能确保双向都可以接收到对方的发送的 数据。两次握手接收方这里不能确定自己的的发送是正常的,发送方的接收是正常的。

-

-**具体点:**

-

-**三次握手的目的是建立可靠的通信信道,说到通讯,简单来说就是数据的发送与接收,而三次握手最主要的目的就是双方确认自己与对方的发送与接收是正常的。**

-

-第一次握手:Client 什么都不能确认;Server 确认了对方发送正常,自己接收正常

-

-第二次握手:Client 确认了:自己发送、接收正常,对方发送、接收正常;Server 确认了:对方发送正常,自己接收正常

-

-第三次握手:Client 确认了:自己发送、接收正常,对方发送、接收正常;Server 确认了:自己发送、接收正常,对方发送、接收正常

-

-所以三次握手就能确认双发收发功能都正常,缺一不可。

-

-

-

-### 第二种答案

-

- 一句话,主要防止已经失效的连接请求报文突然又传送到了服务器,从而产生错误。如果使用的是两次握手建立连接,假设有这样一种场景,客户端发送了第一个请求连接并且没有丢失,只是因为在网络结点中滞留的时间太长了,由于TCP的客户端迟迟没有收到确认报文,以为服务器没有收到,此时重新向服务器发送这条报文,此后客户端和服务器经过两次握手完成连接,传输数据,然后关闭连接。此时此前滞留的那一次请求连接,网络通畅了到达了服务器,这个报文本该是失效的,但是,两次握手的机制将会让客户端和服务器再次建立连接,这将导致不必要的错误和资源的浪费。如果采用的是三次握手,就算是那一次失效的报文传送过来了,服务端接受到了那条失效报文并且回复了确认报文,但是客户端不会再次发出确认。由于服务器收不到确认,就知道客户端并没有请求连接。

-

-

-

-

-

-

-

-## 如果已经建立了连接,但是客户端突然出现故障了怎么办?

-

-

-

-

-

-

-

-

-

-## 为什么要进行流量控制

-

-一般来说,我们总是希望数据传输更快一些。但如果发送方把数据发送的过快,接收方就可能来不及接收,这就会造成数据的丢失(丢包)。

-

-

-

-

-

-# TCP粘包现象原因和解决方法

-

-

-

-## 原因

-

-1.UDP协议的保护消息边界使得每一个消息都是独立的

-

-2.而tcp是基于流的传输,流传输却把数据当作一串数据流,他不认为数据是一个一个的消息

-

-3.发送端需要等缓冲区满才发送出去,造成粘包

-

-4.接收方不及时接收缓冲区的包,造成多个包粘包

-

-具体点:

-

-(1)发送方引起的粘包是由TCP协议本身造成的,TCP为提高传输效率,发送方往往要收集到足够多的数据后才发送一包数据。若连续几次发送的数据都很少,通常TCP会根据优化算法把这些数据合成一包后一次发送出去,这样接收方就收到了粘包数据。

-

-(2)接收方引起的粘包是由于接收方用户进程不及时接收数据,从而导致粘包现象。这是因为接收方先把收到的数据放在系统接收缓冲区,用户进程从该缓冲区取数据,若下一包数据到达时前一包数据尚未被用户进程取走,则下一包数据放到系统接收缓冲区时就接到前一包数据之后,而用户进程根据预先设定的缓冲区大小从系统接收缓冲区取数据,这样就一次取到了多包数据。

-

-

-

-## 解决方法

-

-(1)对于发送方引起的粘包现象,用户可通过编程设置来避免,TCP提供了强制数据立即传送的操作指令push,TCP程序收到该操作指令后,就立即将本段数据发送出去,而不必等待发送缓冲区满;

-

-(2)对于接收方引起的粘包,则可通过优化程序设计、精简接收进程工作量、提高接收进程优先级等措施,使其及时接收数据,从而尽量避免出现粘包现象;

-

-(3)由接收方控制,将一包数据按结构字段,人为控制分多次接收,然后合并,通过这种手段来避免粘包。

-

-

-

-## 为什么粘包需要处理?

-

-不是所有的粘包现象都需要处理,若传输的数据为不带结构的连续流数据(如文件传输),则不必把粘连的包分开(简称分包)。但在实际工程应用中,传输的数据一般为带结构的数据,这时就需要做分包处理。分包一般难度较大,所以尽量避免粘包

-

-

-

-

-

-# 三次握手相关问题

-

-

-

-## 过程+状态改变

-

-把**补充**里面的**第二个博客**的过程背下来。(有的地方需要参考第一个博客)

-

-

-

-## 为什么三次,两次为什么不行?

-

-### 第一种答案

-

-两次握手只能保证单向连接是畅通的。只有经过第三次握手,才能确保双向都可以接收到对方的发送的 数据。两次握手接收方这里不能确定自己的的发送是正常的,发送方的接收是正常的。

-

-**具体点:**

-

-**三次握手的目的是建立可靠的通信信道,说到通讯,简单来说就是数据的发送与接收,而三次握手最主要的目的就是双方确认自己与对方的发送与接收是正常的。**

-

-第一次握手:Client 什么都不能确认;Server 确认了对方发送正常,自己接收正常

-

-第二次握手:Client 确认了:自己发送、接收正常,对方发送、接收正常;Server 确认了:对方发送正常,自己接收正常

-

-第三次握手:Client 确认了:自己发送、接收正常,对方发送、接收正常;Server 确认了:自己发送、接收正常,对方发送、接收正常

-

-所以三次握手就能确认双发收发功能都正常,缺一不可。

-

-

-

-### 第二种答案

-

- 一句话,主要防止已经失效的连接请求报文突然又传送到了服务器,从而产生错误。如果使用的是两次握手建立连接,假设有这样一种场景,客户端发送了第一个请求连接并且没有丢失,只是因为在网络结点中滞留的时间太长了,由于TCP的客户端迟迟没有收到确认报文,以为服务器没有收到,此时重新向服务器发送这条报文,此后客户端和服务器经过两次握手完成连接,传输数据,然后关闭连接。此时此前滞留的那一次请求连接,网络通畅了到达了服务器,这个报文本该是失效的,但是,两次握手的机制将会让客户端和服务器再次建立连接,这将导致不必要的错误和资源的浪费。如果采用的是三次握手,就算是那一次失效的报文传送过来了,服务端接受到了那条失效报文并且回复了确认报文,但是客户端不会再次发出确认。由于服务器收不到确认,就知道客户端并没有请求连接。

-

-

-

-

-

-

-

-## 如果已经建立了连接,但是客户端突然出现故障了怎么办?

-

- -

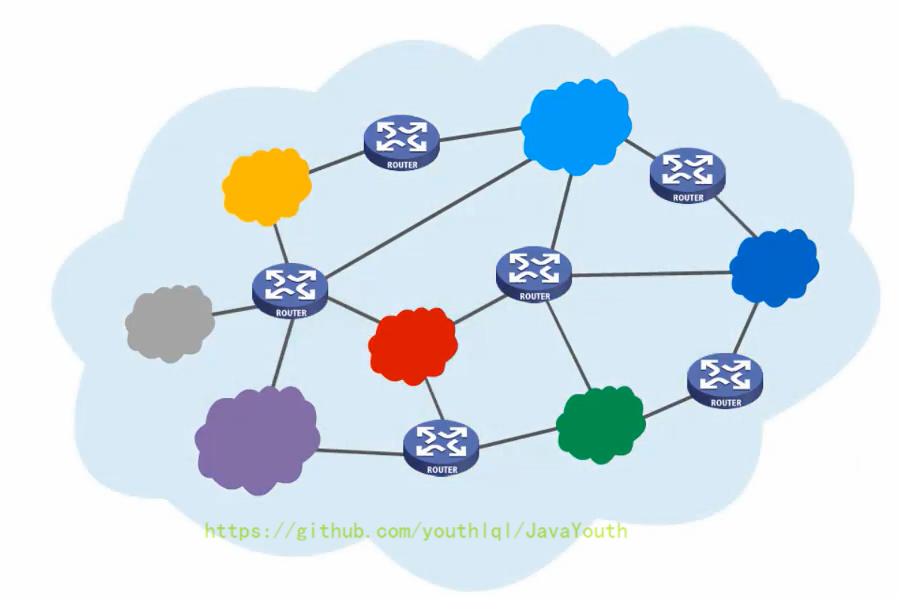

-互联网(或互连网):多个网络通过路由器互连起来,这样就构成了一个覆盖范围更大的网络,即互连网(互联网)。因此,互联网又称为“网络的网络(Network of Networks)”。

-

-

-

-互联网(或互连网):多个网络通过路由器互连起来,这样就构成了一个覆盖范围更大的网络,即互连网(互联网)。因此,互联网又称为“网络的网络(Network of Networks)”。

-

- -

-因特网:因特网(Internet)是世界上最大的互连网络(用户数以亿计,互连的网络数以百万计)。

-

-

-

-因特网:因特网(Internet)是世界上最大的互连网络(用户数以亿计,互连的网络数以百万计)。

-

- -

-

-

-> **internet与Internet的区别**

->

-> * internet(互联网或互连网)是一个通用名词,它泛指多个计算机网络互连而成的网络。在这些网络之间的通信协议可以是任意的。

-> * Internet(因特网)则是一个专用名词,它指当前全球最大的、开放的、由众多网络互连而成的特定计算机网络,它采用TCP/IP协议族作为通信的规则,其前身是美国的ARPANET。

->

-

-

-

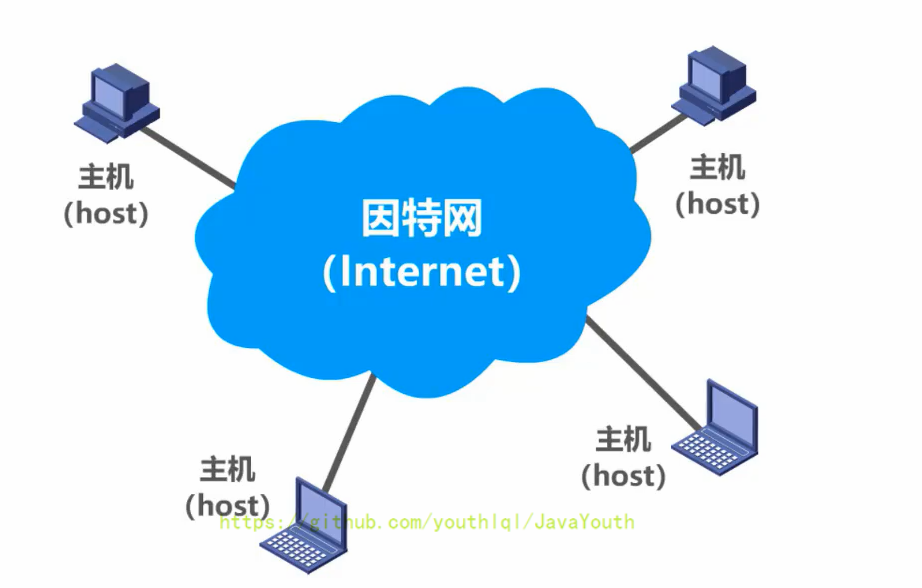

-### 因特网发展的三个阶段

-

-

-

-

-

-> **internet与Internet的区别**

->

-> * internet(互联网或互连网)是一个通用名词,它泛指多个计算机网络互连而成的网络。在这些网络之间的通信协议可以是任意的。

-> * Internet(因特网)则是一个专用名词,它指当前全球最大的、开放的、由众多网络互连而成的特定计算机网络,它采用TCP/IP协议族作为通信的规则,其前身是美国的ARPANET。

->

-

-

-

-### 因特网发展的三个阶段

-

- -

-

-

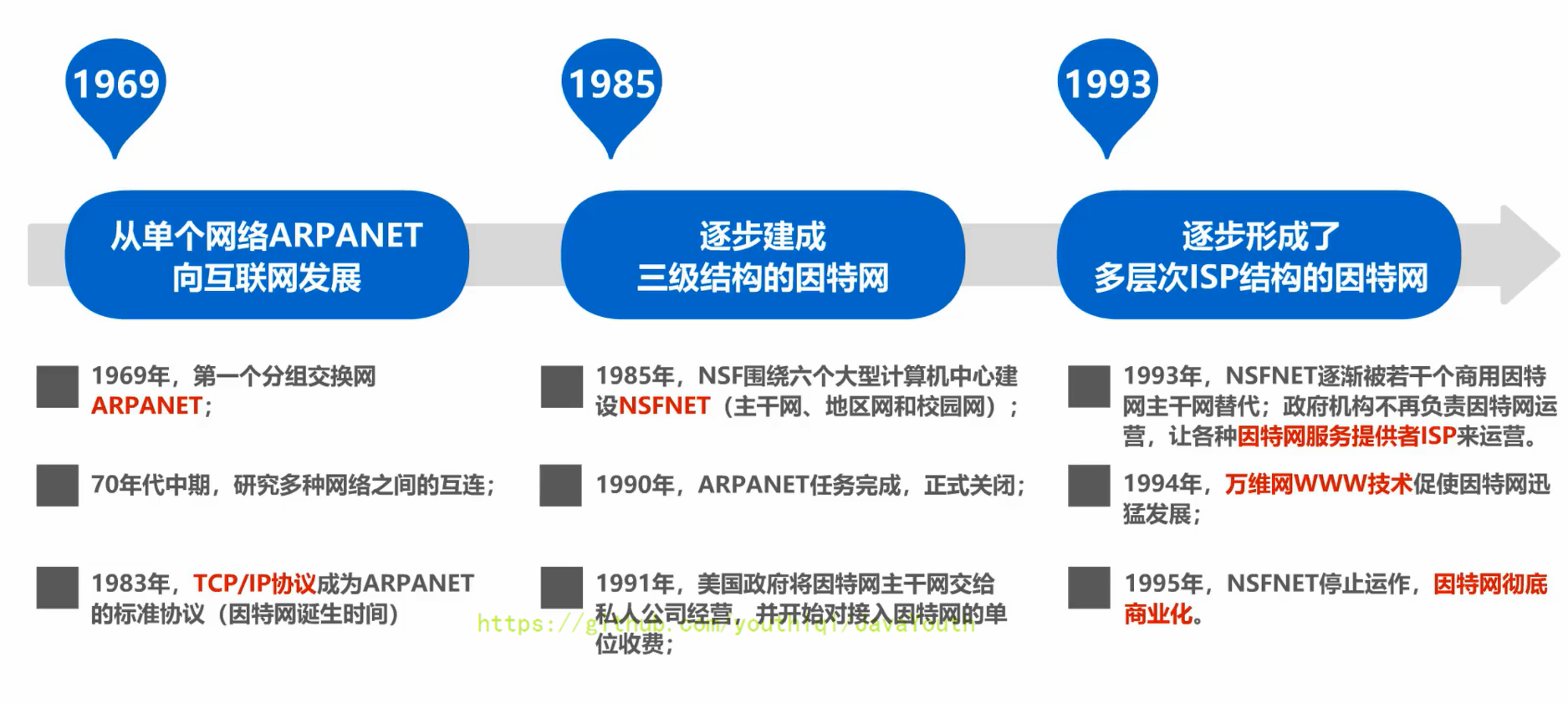

-**因特网服务提供者`ISP`(`I`nternet `S`ervice `P`rovider)**

-

-

-

-

-

-**因特网服务提供者`ISP`(`I`nternet `S`ervice `P`rovider)**

-

- -

-> Q:普通用户是如何接入到因特网的呢?

->

-> A:通过ISP接入因特网

->

-> ISP可以从因特网管理机构申请到成块的IP地址,同时拥有通信线路以及路由器等联网设备。任何机构和个人只需缴纳费用,就可从ISP的得到所需要的IP地址。这一点很重要。因为因特网上的主机都必须有IP地址才能进行通信,这样就可以通过该ISP接入到因特网

->

-

-

-

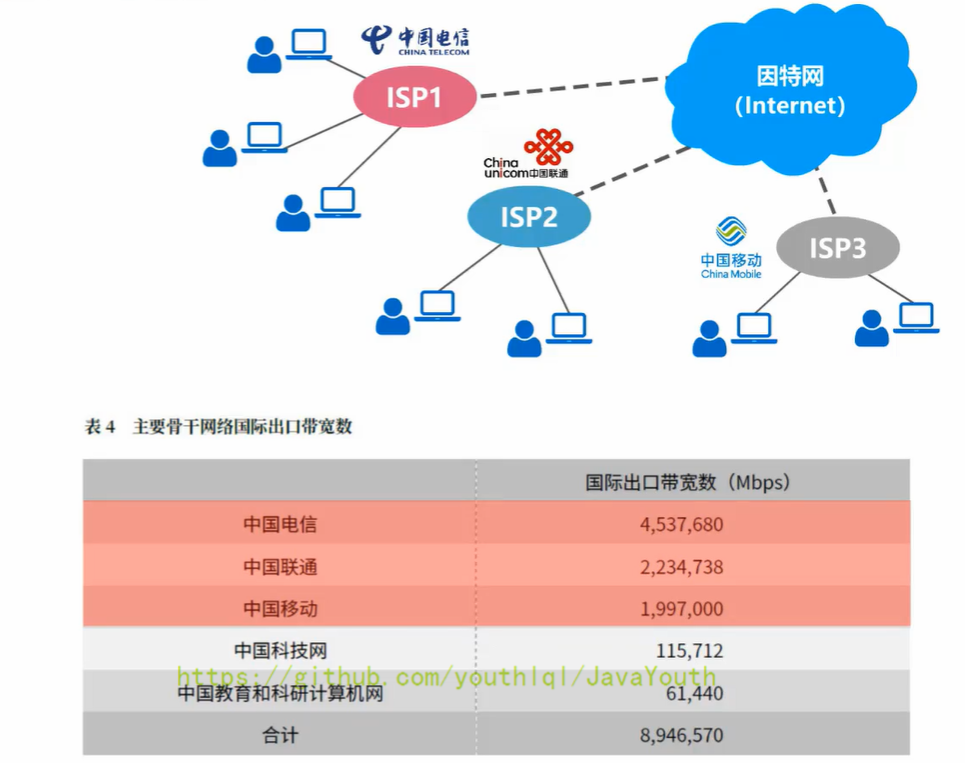

-**中国的三大`ISP`:中国电信,中国联通,中国移动**

-

-

-

-> Q:普通用户是如何接入到因特网的呢?

->

-> A:通过ISP接入因特网

->

-> ISP可以从因特网管理机构申请到成块的IP地址,同时拥有通信线路以及路由器等联网设备。任何机构和个人只需缴纳费用,就可从ISP的得到所需要的IP地址。这一点很重要。因为因特网上的主机都必须有IP地址才能进行通信,这样就可以通过该ISP接入到因特网

->

-

-

-

-**中国的三大`ISP`:中国电信,中国联通,中国移动**

-

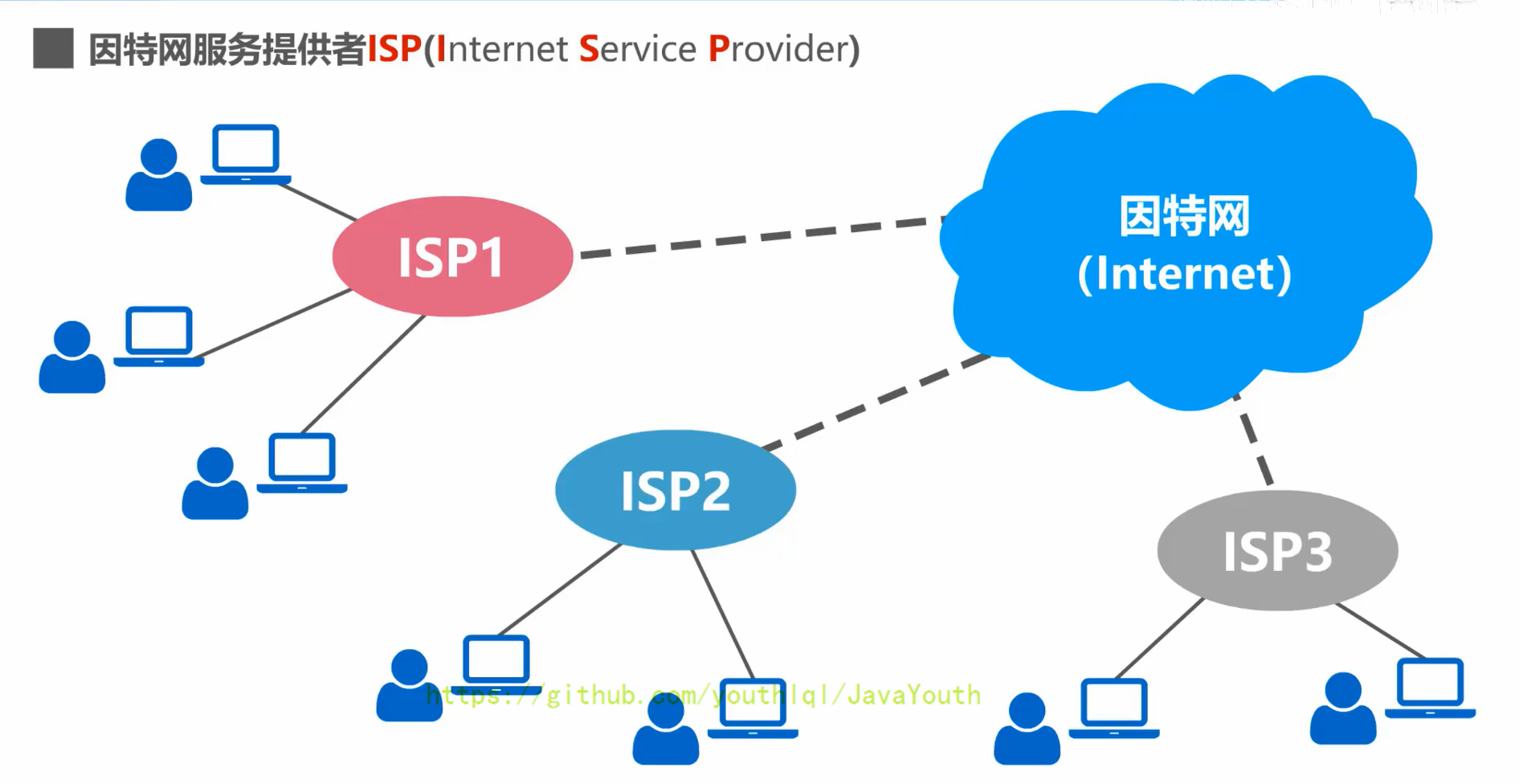

- -

-

-

-**基于ISP的三层结构的因特网**

-

-

-

-

-

-**基于ISP的三层结构的因特网**

-

- -

-1、图中红线部分是两个私人用户进行通信的大致链路,可以看到需要经过多个ISP层级

-

-2、一旦某个用户能够接入到因特网,那么他也可以成为一个ISP,所需要做的就是购买一些如调制解调器或路由器这样的设备,让其他用户可以和他相连。

-

-3、第一层ISP可以直接互联,第二层ISP和一些大公司都是第一层ISP的用户。

-

-

-

-

-

-### 因特网的标准化工作

-

-* 因特网的标准化工作对因特网的发展起到了非常重要的作用。

-* 因特网在指定其标准上的一个很大的特点是**面向公众。**

- * 因特网所有的**RFC**(Request For Comments)技术文档都可从因特网上免费下载;

- * 任何人都可以随时用电子邮件发表对某个文档的意见或建议。

-* **因特网协会ISOC**是一个国际性组织,它负责对因特网进行全面管理,以及在世界范围内促进其发展和使用。

- * 因特网体系结构委员会IAB,负责管理因特网有关协议的开发;

- * 因特网工程部IETF,负责研究中短期工程问题,主要针对协议的开发和标准化;

- * 因特网研究部IRTF,从事理论方面的研究和开发一些需要长期考虑的问题。

-

-

-

-1、图中红线部分是两个私人用户进行通信的大致链路,可以看到需要经过多个ISP层级

-

-2、一旦某个用户能够接入到因特网,那么他也可以成为一个ISP,所需要做的就是购买一些如调制解调器或路由器这样的设备,让其他用户可以和他相连。

-

-3、第一层ISP可以直接互联,第二层ISP和一些大公司都是第一层ISP的用户。

-

-

-

-

-

-### 因特网的标准化工作

-

-* 因特网的标准化工作对因特网的发展起到了非常重要的作用。

-* 因特网在指定其标准上的一个很大的特点是**面向公众。**

- * 因特网所有的**RFC**(Request For Comments)技术文档都可从因特网上免费下载;

- * 任何人都可以随时用电子邮件发表对某个文档的意见或建议。

-* **因特网协会ISOC**是一个国际性组织,它负责对因特网进行全面管理,以及在世界范围内促进其发展和使用。

- * 因特网体系结构委员会IAB,负责管理因特网有关协议的开发;

- * 因特网工程部IETF,负责研究中短期工程问题,主要针对协议的开发和标准化;

- * 因特网研究部IRTF,从事理论方面的研究和开发一些需要长期考虑的问题。

-

- -

-* 制订因特网的正式标准要经过一下**4个阶段**:

-

- 1、因特网草案(在这个阶段还不是RFC文档)

-

- 2、建议标准(从这个阶段开始就成为RFC文档)

-

- 3、草案标准

-

- 4、因特网标准

-

-

-

-### 因特网的组成

-

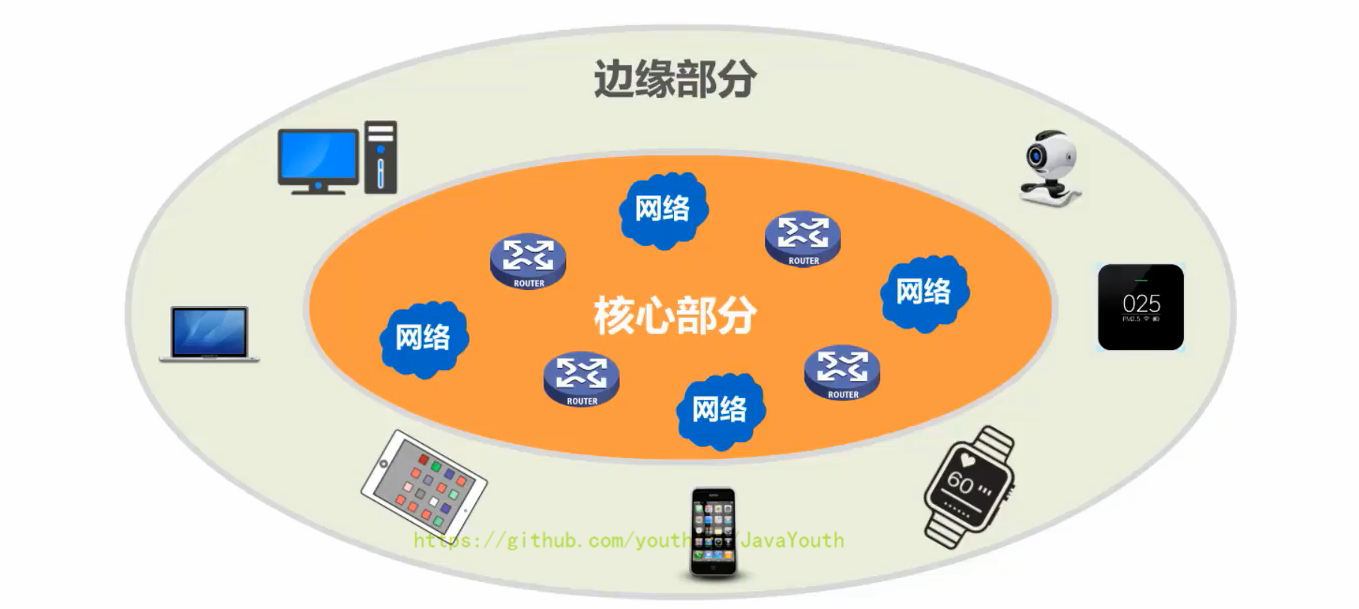

-* 边缘部分

-

- 由所有连接在因特网上的**主机**组成(台式电脑,大型服务器,笔记本电脑,平板,智能手机,智能手表,以及物联网智能硬件等)。这部分是**用户直接使用**的,用来进行**通信**(传送数据、音频或视频)和**资源共享**。

-

-* 核心部分

-

- 由**大量网络**和连接这些网络的**路由器**组成。这部分是**为边缘部分提供服务**的(提供连通性和交换)。

-

-

-

-* 制订因特网的正式标准要经过一下**4个阶段**:

-

- 1、因特网草案(在这个阶段还不是RFC文档)

-

- 2、建议标准(从这个阶段开始就成为RFC文档)

-

- 3、草案标准

-

- 4、因特网标准

-

-

-

-### 因特网的组成

-

-* 边缘部分

-

- 由所有连接在因特网上的**主机**组成(台式电脑,大型服务器,笔记本电脑,平板,智能手机,智能手表,以及物联网智能硬件等)。这部分是**用户直接使用**的,用来进行**通信**(传送数据、音频或视频)和**资源共享**。

-

-* 核心部分

-

- 由**大量网络**和连接这些网络的**路由器**组成。这部分是**为边缘部分提供服务**的(提供连通性和交换)。

-

- -

-1. 路由器是一种专用计算机,但我们不称它为主机,路由器是实现分组交换的关键构建,其任务是转发收到的分组,这是网络核心最重要的部分。

-

-

-

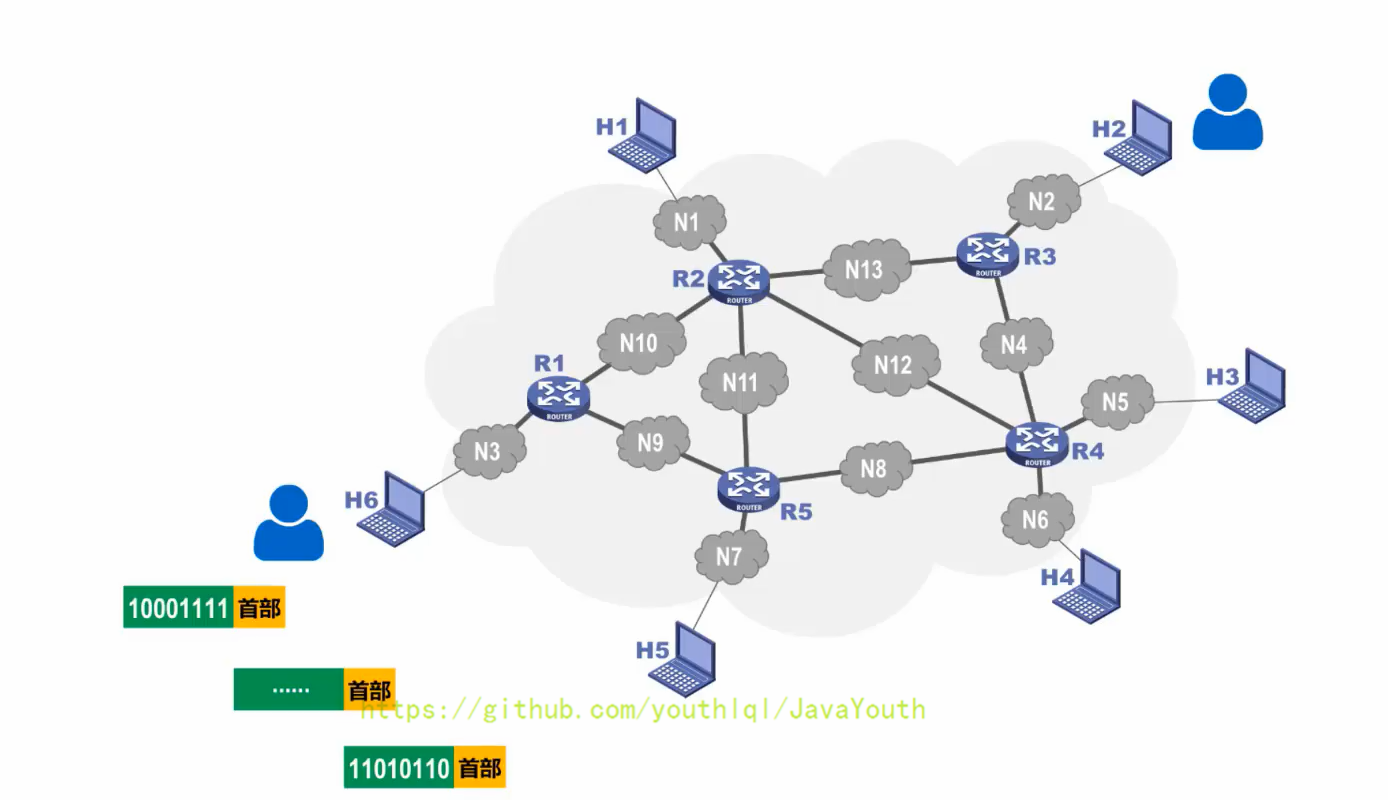

-## 三种交换方式

-

-网络核心部分是互联网中最复杂的部分。

-

-网络中的核心部分要向网络边缘中的大量主机提供连通性,使边缘部分中的任何一个主机都能够向其他主机通信(即传送或接收各种形式的数据)。

-

-在网络核心部分起特殊作用的是**路由器**(router)。

-

-**路由器**是实现**分组交换** (packet switching) 的关键构件,其任务是转发收到的分组,这是网络核心部分最重要的功能。

-

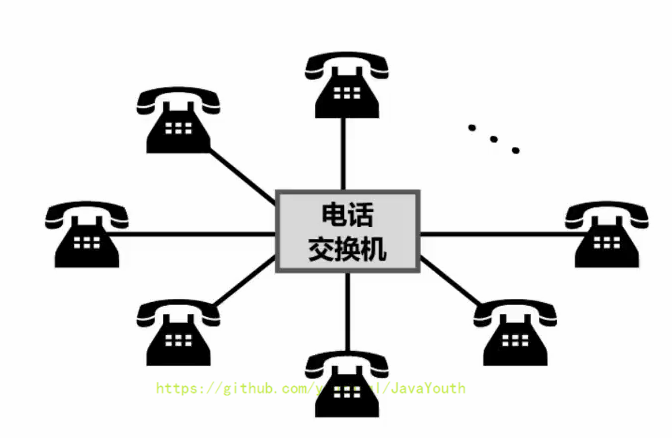

-### 电路交换

-

-

-

-1. 路由器是一种专用计算机,但我们不称它为主机,路由器是实现分组交换的关键构建,其任务是转发收到的分组,这是网络核心最重要的部分。

-

-

-

-## 三种交换方式

-

-网络核心部分是互联网中最复杂的部分。

-

-网络中的核心部分要向网络边缘中的大量主机提供连通性,使边缘部分中的任何一个主机都能够向其他主机通信(即传送或接收各种形式的数据)。

-

-在网络核心部分起特殊作用的是**路由器**(router)。

-

-**路由器**是实现**分组交换** (packet switching) 的关键构件,其任务是转发收到的分组,这是网络核心部分最重要的功能。

-

-### 电路交换

-

- -

-1. 传统两两相连的方式,当电话数量很多时,电话线也很多,就很不方便

-2. 所以要使得每一部电话能够很方便地和另一部电话进行通信,就应该使用一个**中间设备**将这些电话连接起来,这个中间设备就是**电话交换机**

-

-

-

-1. 传统两两相连的方式,当电话数量很多时,电话线也很多,就很不方便

-2. 所以要使得每一部电话能够很方便地和另一部电话进行通信,就应该使用一个**中间设备**将这些电话连接起来,这个中间设备就是**电话交换机**

-

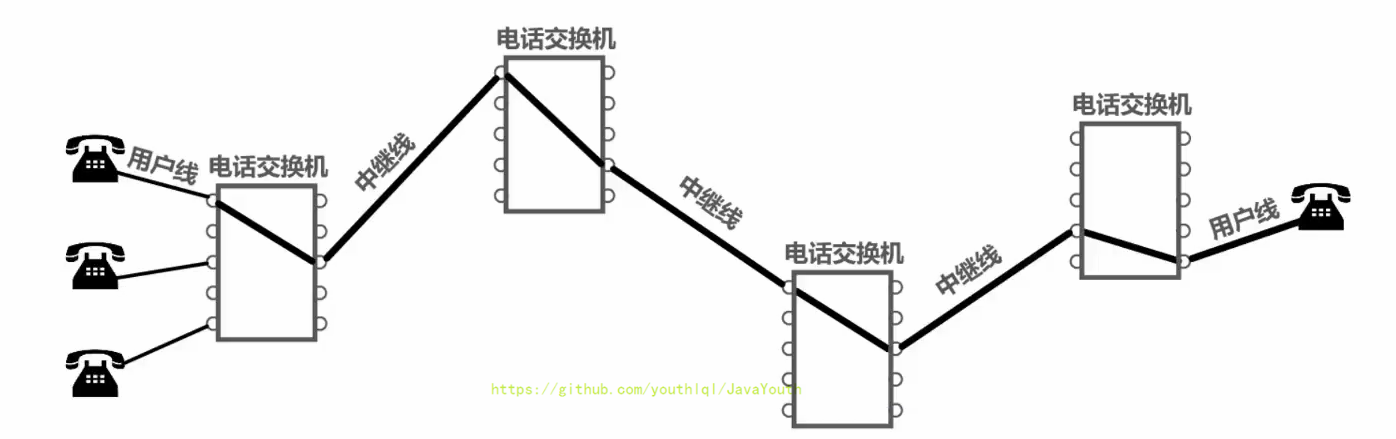

- -

-* 电话交换机接通电话线的方式称为电路交换;

-

-* 从通信资源的分配角度来看,交换(Switching)就是按照某种方式动态地分配传输线路的资源;

-

-* 电路交换的三个步骤:

-

- 1、建立连接(分配通信资源)

-

- 2、通话(一直占用通信资源)

-

- 3、释放连接(归还通信资源)

-

-

-

-* 电话交换机接通电话线的方式称为电路交换;

-

-* 从通信资源的分配角度来看,交换(Switching)就是按照某种方式动态地分配传输线路的资源;

-

-* 电路交换的三个步骤:

-

- 1、建立连接(分配通信资源)

-

- 2、通话(一直占用通信资源)

-

- 3、释放连接(归还通信资源)

-

- -

-1. 当使用电路交换来传送计算机数据时,其线路的传输效率往往很低。这是因为计算机数据是突发式地出现在传输线路上的,而不是像打电话一样一直占用着通信资源。

-2. 试想一下这种情况,当用户正在输入和编辑一份待传输的文件时,用户所占用的通信资源暂时未被利用,该通信资源也不能被其它用户利用,宝贵的通信线路资源白白被浪费了

-3. 因此计算机通常采用的是**分组交换**,而不是线路交换

-

-### 分组交换

-

-

-

-1. 当使用电路交换来传送计算机数据时,其线路的传输效率往往很低。这是因为计算机数据是突发式地出现在传输线路上的,而不是像打电话一样一直占用着通信资源。

-2. 试想一下这种情况,当用户正在输入和编辑一份待传输的文件时,用户所占用的通信资源暂时未被利用,该通信资源也不能被其它用户利用,宝贵的通信线路资源白白被浪费了

-3. 因此计算机通常采用的是**分组交换**,而不是线路交换

-

-### 分组交换

-

- -

-1. 通常我们把表示该消息的整块数据成为一个**报文**。

-2. 在发送报文之前,先把较长的报文划分成一个个更小的等长数据段,在每一个数据段前面。加上一些由必要的控制信息组成的首部后,就构成一个分组,也可简称为“包”,相应地,首部也可称为“包头”。首部起到了很大的作用,首先首部中肯定包含了分组的目的地址,否则分组传输路径中的各分组交换机(也就是个路由器)就不知道如何转发分组了

-3. 分组从源主机到目的主机,可走不同的路径(也就是不同的路由)。

-4. 分组乱序:也就是分组到达目的站的顺序不一定与分组在源站的发送顺序相同。

-5. 分组也可能出现丢失,误码,重复等问题(后面介绍)

-

-

-

-**分组交换过程中各角色的功能**

-

-1、发送方

-

-* 构造分组

-* 发送分组

-

-2、路由器

-

-* 缓存分组

-* 转发分组

-

-

-

-路由器处理分组的过程是:分组交换机收到一个分组后,先将分组暂存下来,按照首部中的目的地址进行查表转发,找到合适的转发接口,通过该接口将分组转发给下一个分组交换机

-

-3、接收方

-

-* 接收分组

-* 还原报文

-

-

-

-### 报文交换

-

-报文交换中的交换结点也采用存储转发方式,但报文交换对报文的大小没有限制,这就要求交换结点需要较大的缓存空间。报文交换主要用于早期的电报通信网,现在较少使用,通常被较先进的分组交换方式所取代。因此,不再详细介绍报文交换。

-

-

-

-### 三种交换方式的对比

-

-假设A,B,C,D是分组传输路径所要经过的4个结点交换机,纵坐标为时间

-

-

-

-1. 通常我们把表示该消息的整块数据成为一个**报文**。

-2. 在发送报文之前,先把较长的报文划分成一个个更小的等长数据段,在每一个数据段前面。加上一些由必要的控制信息组成的首部后,就构成一个分组,也可简称为“包”,相应地,首部也可称为“包头”。首部起到了很大的作用,首先首部中肯定包含了分组的目的地址,否则分组传输路径中的各分组交换机(也就是个路由器)就不知道如何转发分组了

-3. 分组从源主机到目的主机,可走不同的路径(也就是不同的路由)。

-4. 分组乱序:也就是分组到达目的站的顺序不一定与分组在源站的发送顺序相同。

-5. 分组也可能出现丢失,误码,重复等问题(后面介绍)

-

-

-

-**分组交换过程中各角色的功能**

-

-1、发送方

-

-* 构造分组

-* 发送分组

-

-2、路由器

-

-* 缓存分组

-* 转发分组

-

-

-

-路由器处理分组的过程是:分组交换机收到一个分组后,先将分组暂存下来,按照首部中的目的地址进行查表转发,找到合适的转发接口,通过该接口将分组转发给下一个分组交换机

-

-3、接收方

-

-* 接收分组

-* 还原报文

-

-

-

-### 报文交换

-

-报文交换中的交换结点也采用存储转发方式,但报文交换对报文的大小没有限制,这就要求交换结点需要较大的缓存空间。报文交换主要用于早期的电报通信网,现在较少使用,通常被较先进的分组交换方式所取代。因此,不再详细介绍报文交换。

-

-

-

-### 三种交换方式的对比

-

-假设A,B,C,D是分组传输路径所要经过的4个结点交换机,纵坐标为时间

-

- -

-

-

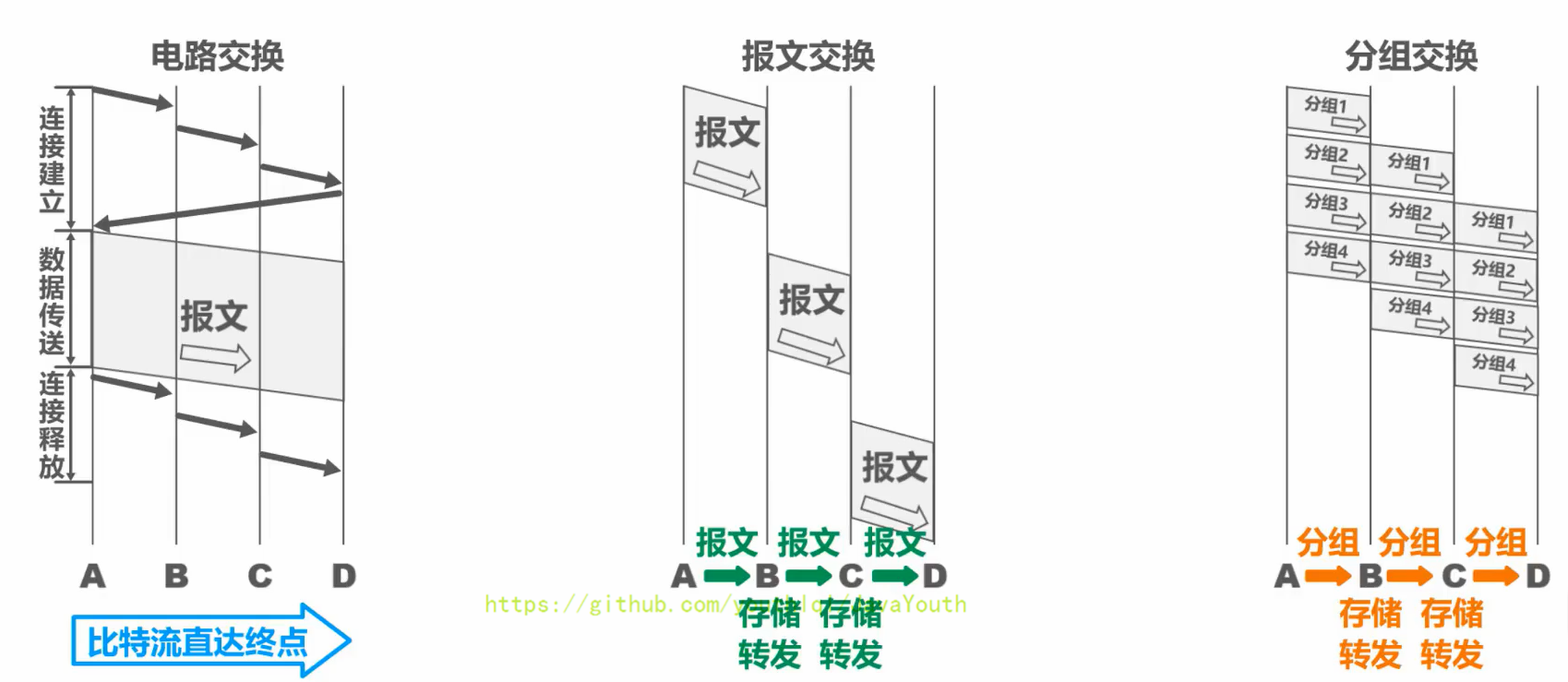

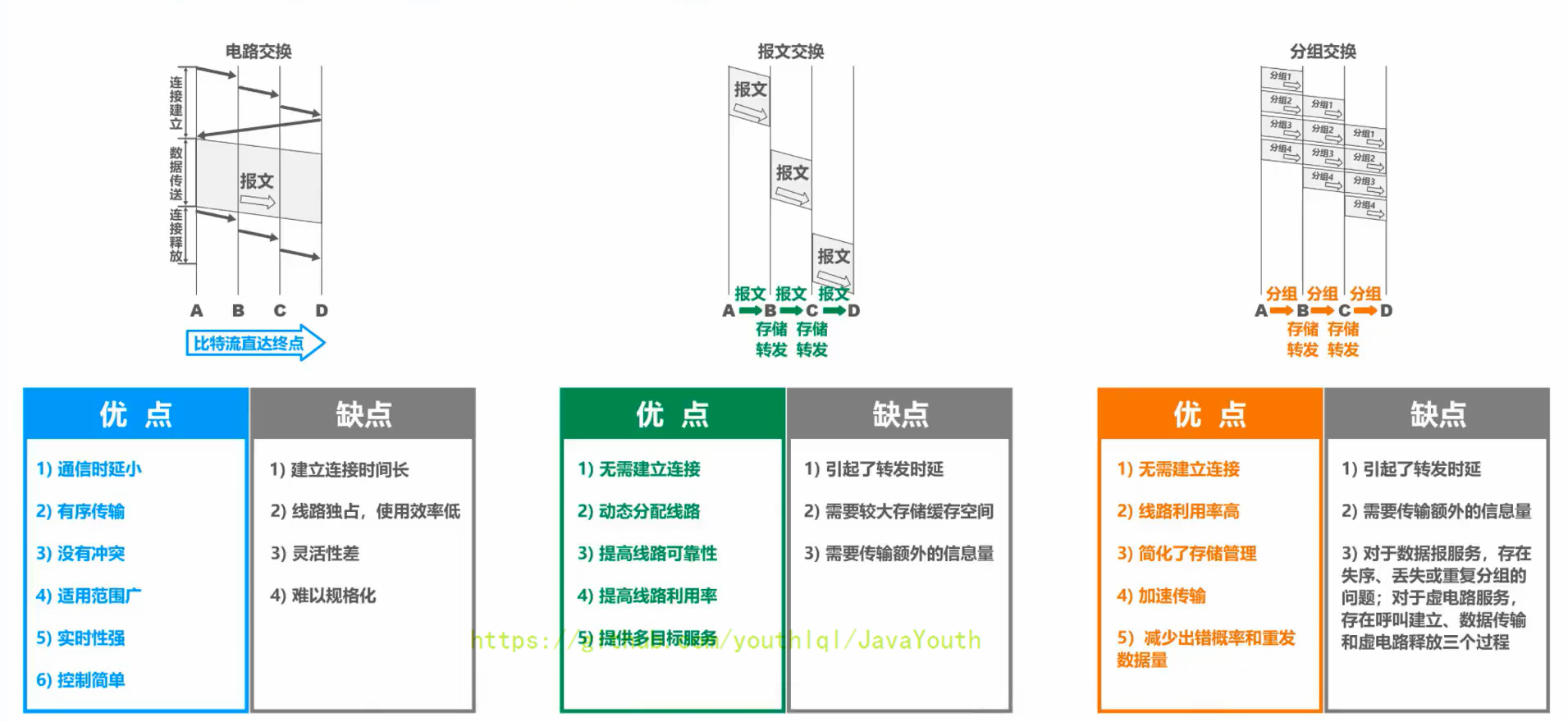

-电路交换:

-

-* 通信之前首先要建立连接;连接建立好之后,就可以使用已建立好的连接进行数据传送;数据传送后,需释放连接,以归还之前建立连接所占用的通信线路资源。

-

-* 一旦建立连接,中间的各结点交换机就是直通形式的,比特流可以直达终点;

-

-报文交换:

-

-* 可以随时发送报文,而不需要事先建立连接;整个报文先传送到相邻结点交换机,**全部存储**下来后进行查表转发,转发到下一个结点交换机。

-* **整个报文**需要在各结点交换机上进行存储转发,由于不限制报文大小,因此需要各结点交换机都具有较大的缓存空间。

-

-分组交换:

-

-* 可以随时发送分组,而不需要事先建立连接。构成原始报文的**一个个分组**,**依次**在各结点交换机上存储转发。各结点交换机在发送分组的同时,还缓存接收到的分组。

-* **构成原始报文的一个个分组**,在各结点交换机上进行存储转发,相比报文交换,减少了转发时延,还可以避免过长的报文长时间占用链路,同时也有利于进行差错控制。

-

-

-

-

-

-电路交换:

-

-* 通信之前首先要建立连接;连接建立好之后,就可以使用已建立好的连接进行数据传送;数据传送后,需释放连接,以归还之前建立连接所占用的通信线路资源。

-

-* 一旦建立连接,中间的各结点交换机就是直通形式的,比特流可以直达终点;

-

-报文交换:

-

-* 可以随时发送报文,而不需要事先建立连接;整个报文先传送到相邻结点交换机,**全部存储**下来后进行查表转发,转发到下一个结点交换机。

-* **整个报文**需要在各结点交换机上进行存储转发,由于不限制报文大小,因此需要各结点交换机都具有较大的缓存空间。

-

-分组交换:

-

-* 可以随时发送分组,而不需要事先建立连接。构成原始报文的**一个个分组**,**依次**在各结点交换机上存储转发。各结点交换机在发送分组的同时,还缓存接收到的分组。

-* **构成原始报文的一个个分组**,在各结点交换机上进行存储转发,相比报文交换,减少了转发时延,还可以避免过长的报文长时间占用链路,同时也有利于进行差错控制。

-

- -

-

-

-## 计算机网络的定义和分类

-

-### 定义

-

-* 计算机网络的精确定义并未统一,随着网络的发展,给出了不同的定义,这些定义反映了当时网络技术发展的水平

-* 计算机网络的最简单的定义是:一些互相连接的、自治的计算机的集合。

- * 互连:是指计算机之间可以通过有线或无线的方式进行数据通信;

- * 自治:是指独立的计算机,他有自己的硬件和软件,可以单独运行使用;

- * 集合:是指至少需要两台计算机;

-* 计算机网络的较好的定义是:计算机网络主要是由一些通用的,可编程的硬件(一定包含有中央处理机CPU)互连而成的,而这些硬件并非专门用来实现某一特定目的(例如,传送数据或视频信号)。这些可编程的硬件能够用来传送多种不同类型的数据,并能支持广泛的和日益增长的应用。

- * 计算机网络所连接的硬件,并不限于一般的计算机,而是包括了智能手机等智能硬件。

- * 计算机网络并非专门用来传送数据,而是能够支持很多种的应用(包括今后可能出现的各种应用)。

-

-

-

-

-

-## 计算机网络的定义和分类

-

-### 定义

-

-* 计算机网络的精确定义并未统一,随着网络的发展,给出了不同的定义,这些定义反映了当时网络技术发展的水平

-* 计算机网络的最简单的定义是:一些互相连接的、自治的计算机的集合。

- * 互连:是指计算机之间可以通过有线或无线的方式进行数据通信;

- * 自治:是指独立的计算机,他有自己的硬件和软件,可以单独运行使用;

- * 集合:是指至少需要两台计算机;

-* 计算机网络的较好的定义是:计算机网络主要是由一些通用的,可编程的硬件(一定包含有中央处理机CPU)互连而成的,而这些硬件并非专门用来实现某一特定目的(例如,传送数据或视频信号)。这些可编程的硬件能够用来传送多种不同类型的数据,并能支持广泛的和日益增长的应用。

- * 计算机网络所连接的硬件,并不限于一般的计算机,而是包括了智能手机等智能硬件。

- * 计算机网络并非专门用来传送数据,而是能够支持很多种的应用(包括今后可能出现的各种应用)。

-

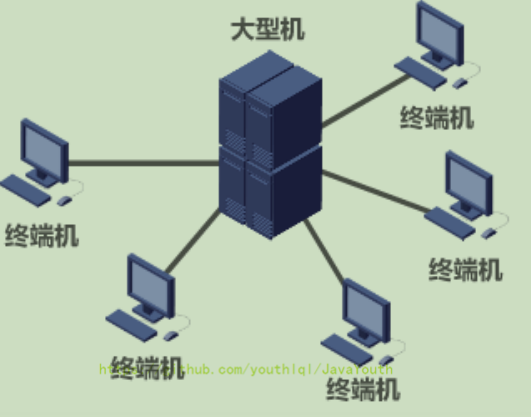

- -

-上图所示的各终端机只是具有显示和输入设备的终端,而并不是自治的计算机,所以上图并不是计算机网络,只是一个运行分时系统的大型机系统。

-

-### 分类

-

-**按交换技术分类:**

-

-* 电路交换网络

-* 报文交换网络

-* 分组交换网络

-

-**按使用者分类:**

-

-* 公用网,公用是指电信公司出资建造的大型网络,公用的意思是所有愿意按电信公司规定交纳费用的人都可以使用这种网络

-* 专用网,是指某个单位为单位内部建立的网络,不对本单位意外提供服务,例如军队,铁路,电力等系统均有本系统的专用网

-

-**按传输介质分类:**

-

-* 有线网络,包括双绞线网络,光纤网络等

-* 无线网络,比如wifi

-

-**按覆盖范围分类:**

-

-* 广域网WAN(Wide Area Network)

-

-作用范围通常为几十到几千公里,因而有时也称为远程网。广域网是互联网的核心部分,其任务是通过长距离(例如,跨越不同的国家)运送主机所发送的数据。

-

-* 城域网MAN

-

-作用范围一般是一个城市,可跨越几个街区甚至整个城市,作用距离通常为5-50公里

-

-* 局域网LAN

-

-一般用微型计算机或工作站通过高速通信线路相连(速率通常在 10 Mbit/s 以上),但地理上范围较小(1 km 左右),比如一栋实验楼,一个校园等

-

-* 个域网PAN

-

-就是在个人工作的地方把个人使用的电子设备用无线技术连接起来的网络。(比如笔记本,耳机,键盘等),覆盖范围大约为10米

-

-**按拓扑结构分类:**

-

-* 总线型网络

-

-

-

-上图所示的各终端机只是具有显示和输入设备的终端,而并不是自治的计算机,所以上图并不是计算机网络,只是一个运行分时系统的大型机系统。

-

-### 分类

-

-**按交换技术分类:**

-

-* 电路交换网络

-* 报文交换网络

-* 分组交换网络

-

-**按使用者分类:**

-

-* 公用网,公用是指电信公司出资建造的大型网络,公用的意思是所有愿意按电信公司规定交纳费用的人都可以使用这种网络

-* 专用网,是指某个单位为单位内部建立的网络,不对本单位意外提供服务,例如军队,铁路,电力等系统均有本系统的专用网

-

-**按传输介质分类:**

-

-* 有线网络,包括双绞线网络,光纤网络等

-* 无线网络,比如wifi

-

-**按覆盖范围分类:**

-

-* 广域网WAN(Wide Area Network)

-

-作用范围通常为几十到几千公里,因而有时也称为远程网。广域网是互联网的核心部分,其任务是通过长距离(例如,跨越不同的国家)运送主机所发送的数据。

-

-* 城域网MAN

-

-作用范围一般是一个城市,可跨越几个街区甚至整个城市,作用距离通常为5-50公里

-

-* 局域网LAN

-

-一般用微型计算机或工作站通过高速通信线路相连(速率通常在 10 Mbit/s 以上),但地理上范围较小(1 km 左右),比如一栋实验楼,一个校园等

-

-* 个域网PAN

-

-就是在个人工作的地方把个人使用的电子设备用无线技术连接起来的网络。(比如笔记本,耳机,键盘等),覆盖范围大约为10米

-

-**按拓扑结构分类:**

-

-* 总线型网络

-

- -

-优点:建网容易,增减节点方便,节省线路

-

-缺点:重负载是通信效率不高,总线任意一处出现故障,则全网瘫痪。

-

-* 星型网络

-

-

-

-优点:建网容易,增减节点方便,节省线路

-

-缺点:重负载是通信效率不高,总线任意一处出现故障,则全网瘫痪。

-

-* 星型网络

-

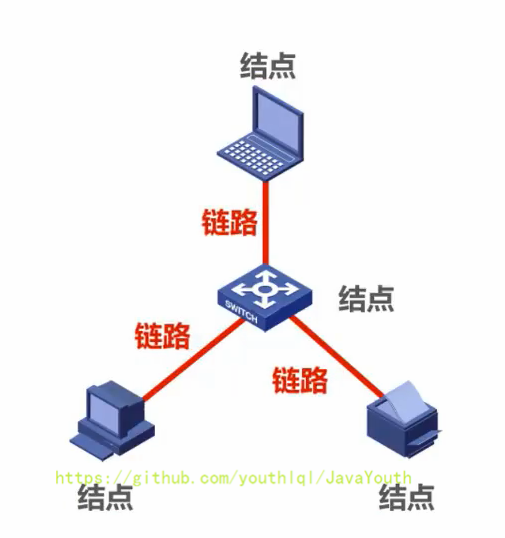

- -

-星型网络图中的中央设备现在一般是交换机或路由器,

-

-优点:这种网络拓扑便于网络的集中控制和管理,因为端用户都要通过中央设备

-

-缺点:成本高,中央设备对故障敏感

-

-

-

-* 环形网络

-

-

-

-星型网络图中的中央设备现在一般是交换机或路由器,

-

-优点:这种网络拓扑便于网络的集中控制和管理,因为端用户都要通过中央设备

-

-缺点:成本高,中央设备对故障敏感

-

-

-

-* 环形网络

-

- -

-环中信号是单向传输的

-

-* 网状型网络

-

-

-

-环中信号是单向传输的

-

-* 网状型网络

-

- -

-一般情况下,每个节点至少由两条路径与其他节点相连,多用在广域网中

-

-优点:可靠性高

-

-缺点:控制复杂,线路成本高

-

-

-

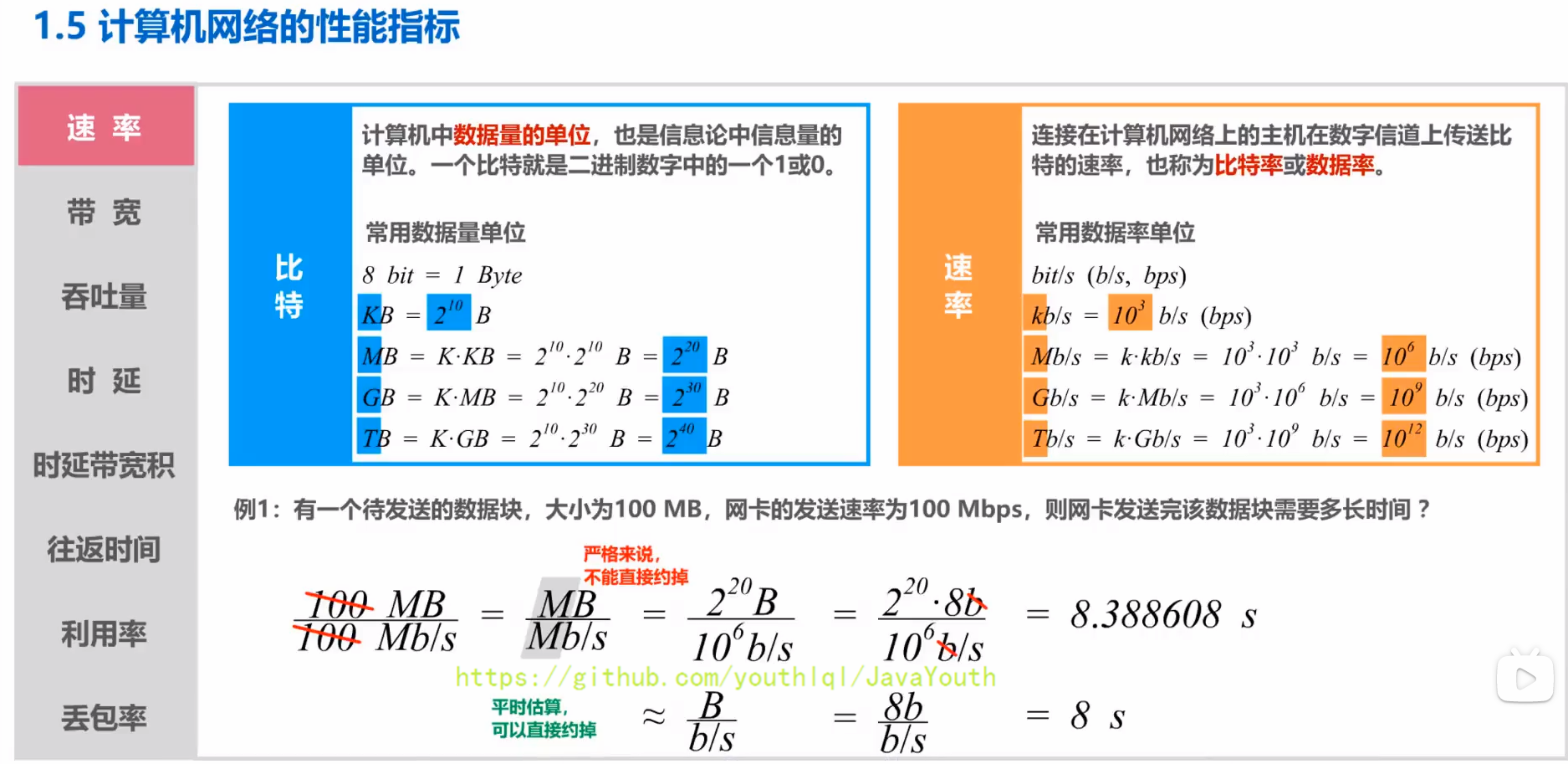

-## 计算机网络的性能指标

-

-### 速率

-

-

-

-一般情况下,每个节点至少由两条路径与其他节点相连,多用在广域网中

-

-优点:可靠性高

-

-缺点:控制复杂,线路成本高

-

-

-

-## 计算机网络的性能指标

-

-### 速率

-

- -

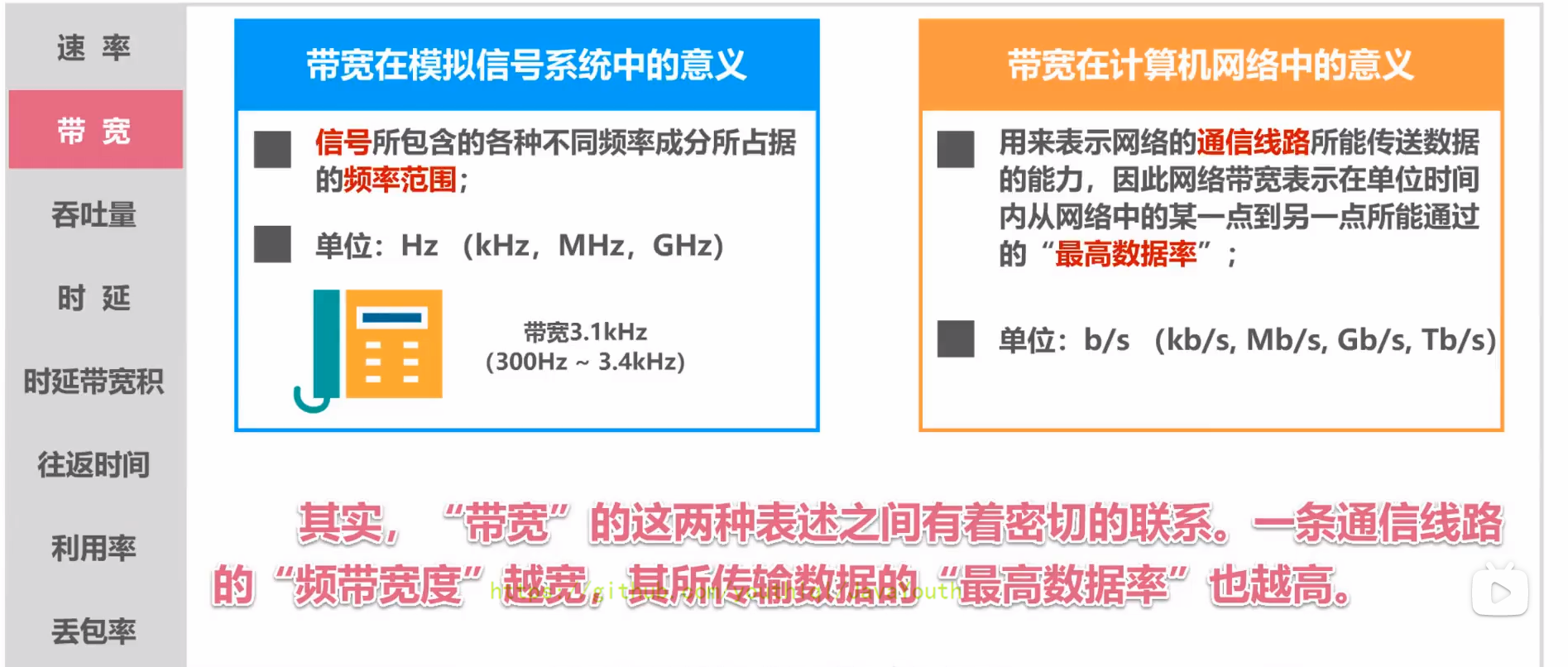

-### 带宽

-

-

-

-### 带宽

-

- -

-### 吞吐量

-

-

-

-### 吞吐量

-

- -

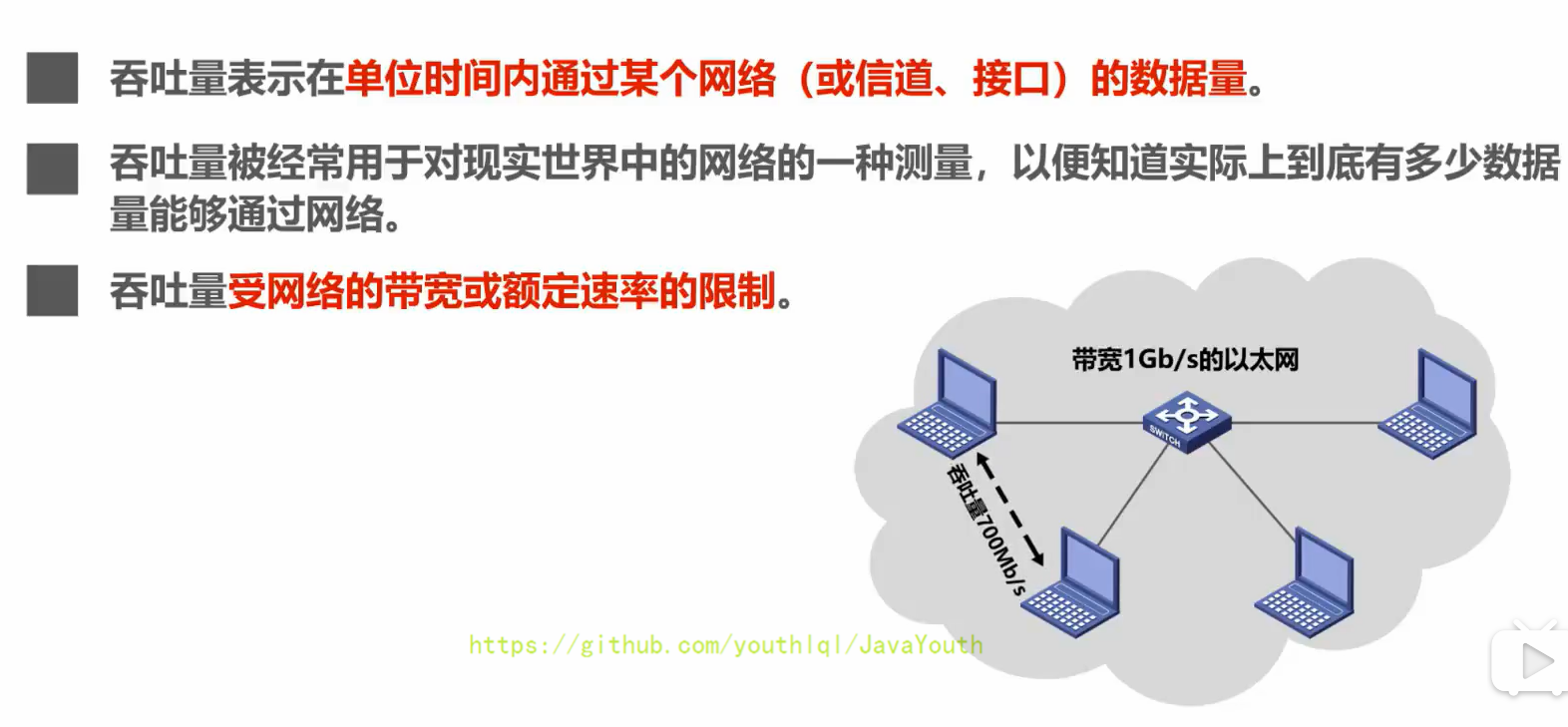

-带宽1 Gb/s的以太网,代表其额定速率是1 Gb/s,这个数值也是该以太网的吞吐量的上限值。实际上,对于带宽1 Gb/s的以太网,可能实际吞吐量只有 700 Mb/s,甚至更低。

-

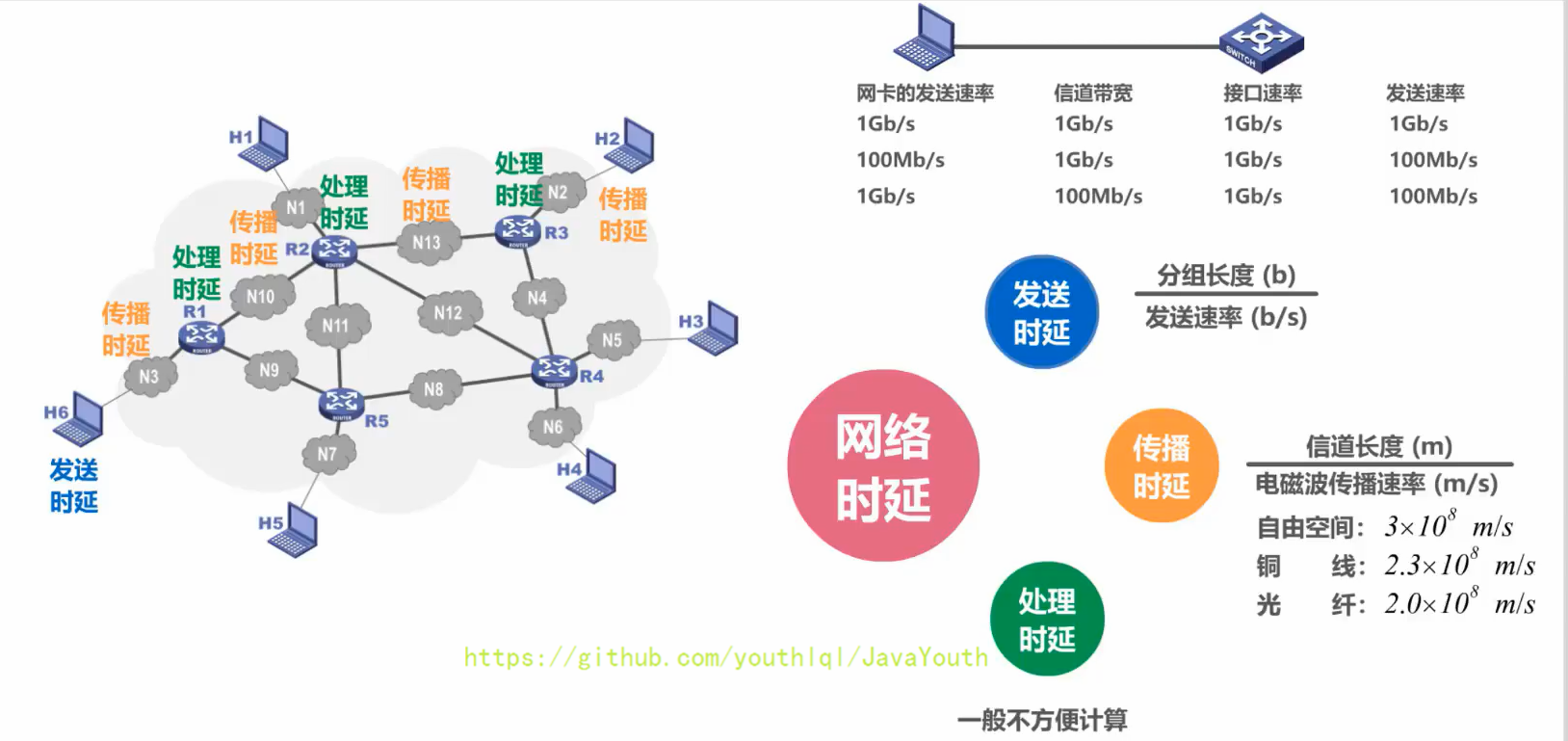

-### 时延

-

-时延时指数据(一个报文或分组,甚至比特)从网络(或链路)的一端传送到另一端所需的时间。

-

-我们来看看分组从源主机传送给目的主机的过程中,都会在哪些地方产生时延

-

-* 发送时延:源主机将分组发往传输线路所需的时间。

-

-* 传播时延:代表分组的电信号在链路上传输所需的时间。

-

-* 处理时延:路由器在收到分组后,对其进行存储转发所花费的时间

-

-> 有的教材中还有一个排队时延,本课程将排队时延与处理时延合并称为处理时延

-

-网卡的发送速率,信道带宽,交换机的接口速率,它们共同决定着主机的发送速率。

-

-

-

-带宽1 Gb/s的以太网,代表其额定速率是1 Gb/s,这个数值也是该以太网的吞吐量的上限值。实际上,对于带宽1 Gb/s的以太网,可能实际吞吐量只有 700 Mb/s,甚至更低。

-

-### 时延

-

-时延时指数据(一个报文或分组,甚至比特)从网络(或链路)的一端传送到另一端所需的时间。

-

-我们来看看分组从源主机传送给目的主机的过程中,都会在哪些地方产生时延

-

-* 发送时延:源主机将分组发往传输线路所需的时间。

-

-* 传播时延:代表分组的电信号在链路上传输所需的时间。

-

-* 处理时延:路由器在收到分组后,对其进行存储转发所花费的时间

-

-> 有的教材中还有一个排队时延,本课程将排队时延与处理时延合并称为处理时延

-

-网卡的发送速率,信道带宽,交换机的接口速率,它们共同决定着主机的发送速率。

-

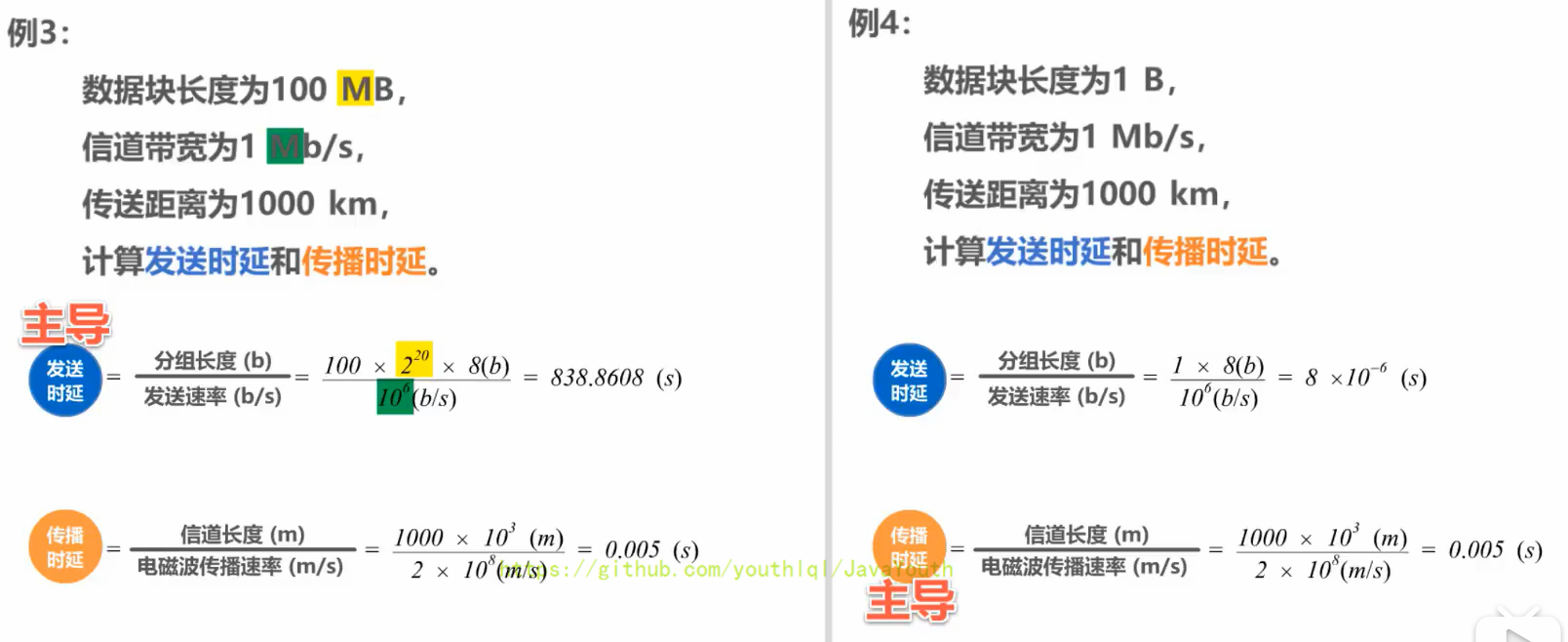

- -

-当处理时延忽略不计时,发送时延和传播时延谁占主导,要具体情况具体分析

-

-

-

-当处理时延忽略不计时,发送时延和传播时延谁占主导,要具体情况具体分析

-

- -

-### 时延带宽积

-

-

-

-

-

-### 时延带宽积

-

-

-

- -

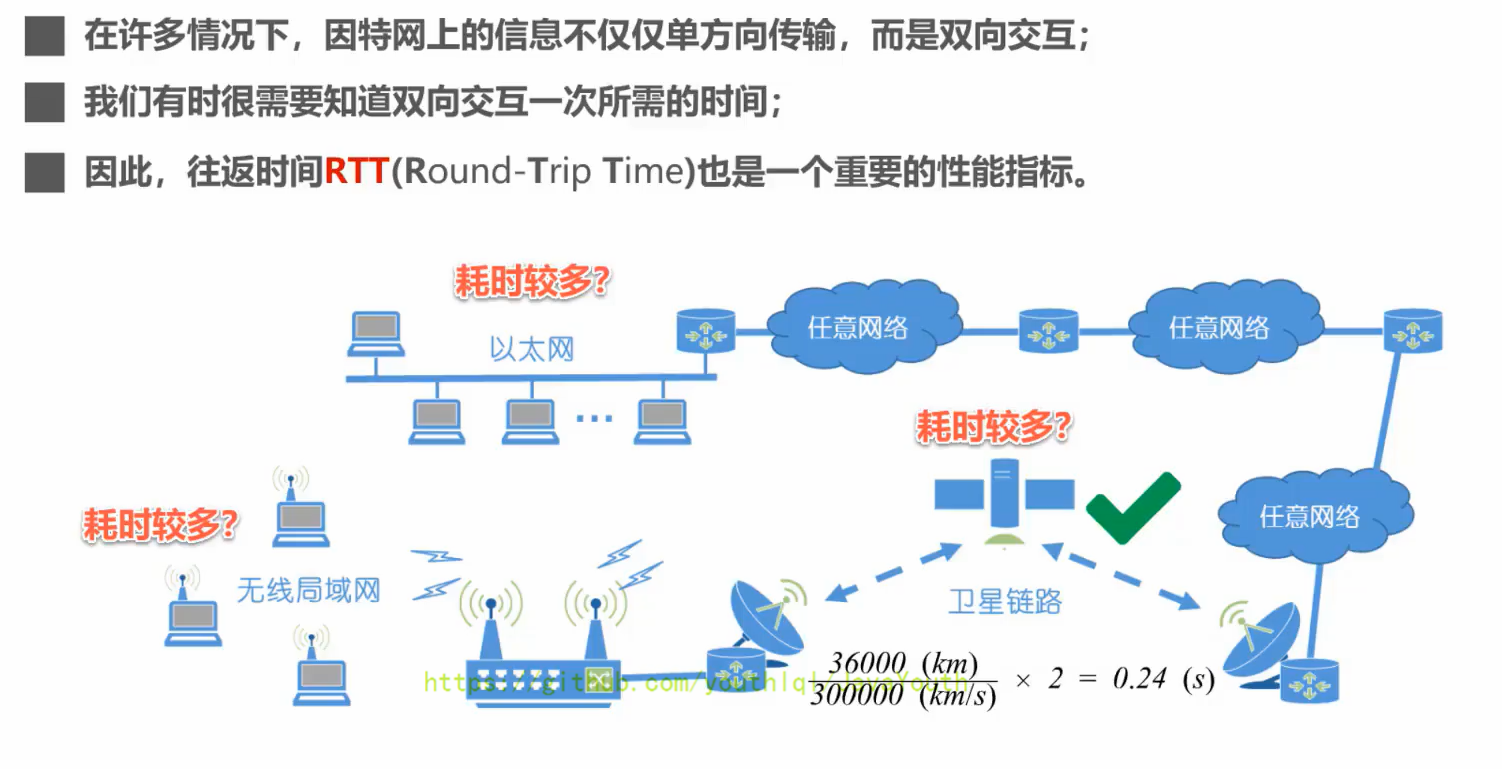

-### 往返时间

-

-

-

-

-

-### 往返时间

-

-

-

- -

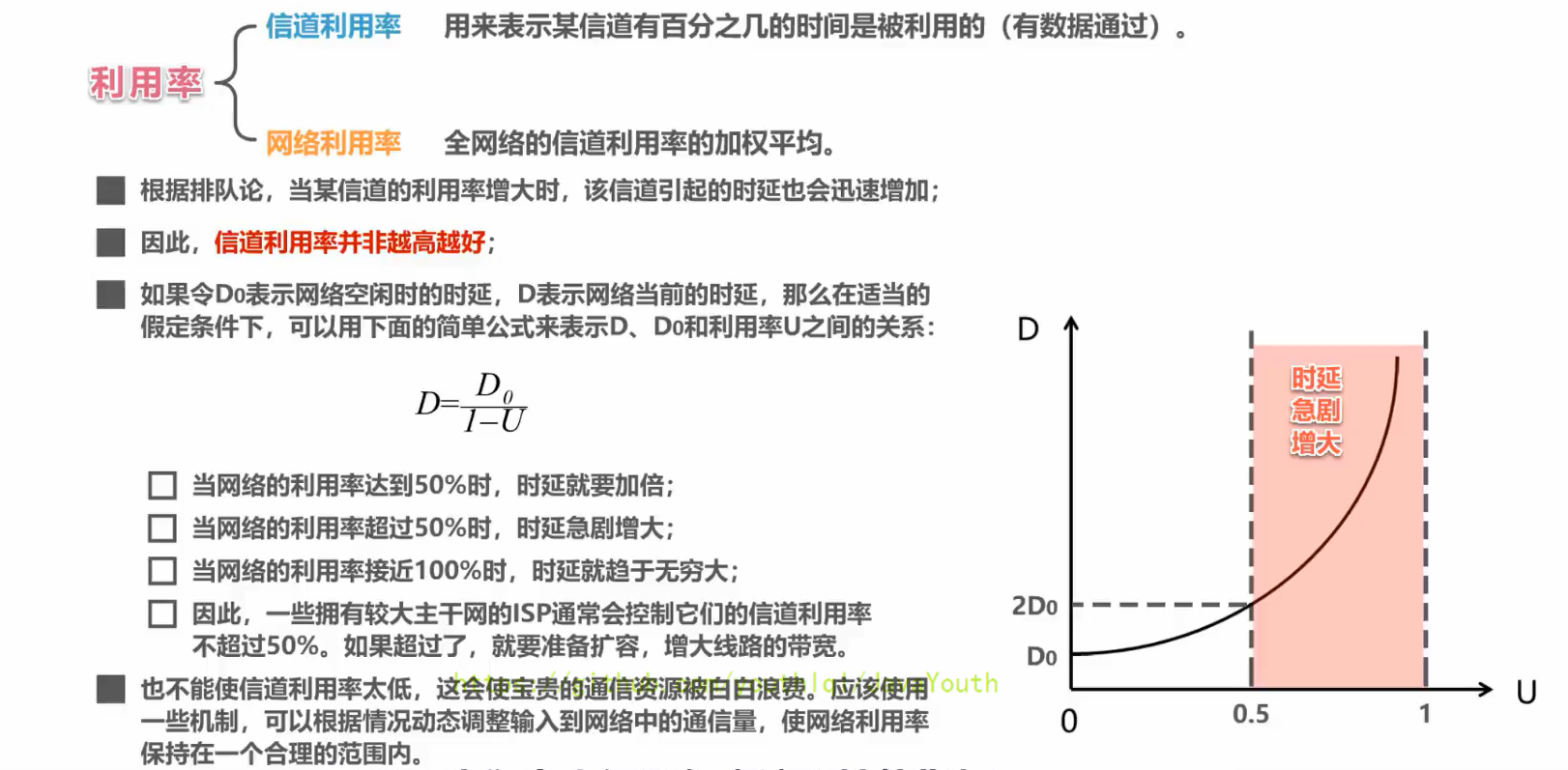

-### 利用率

-

-

-

-

-

-### 利用率

-

-

-

-  -

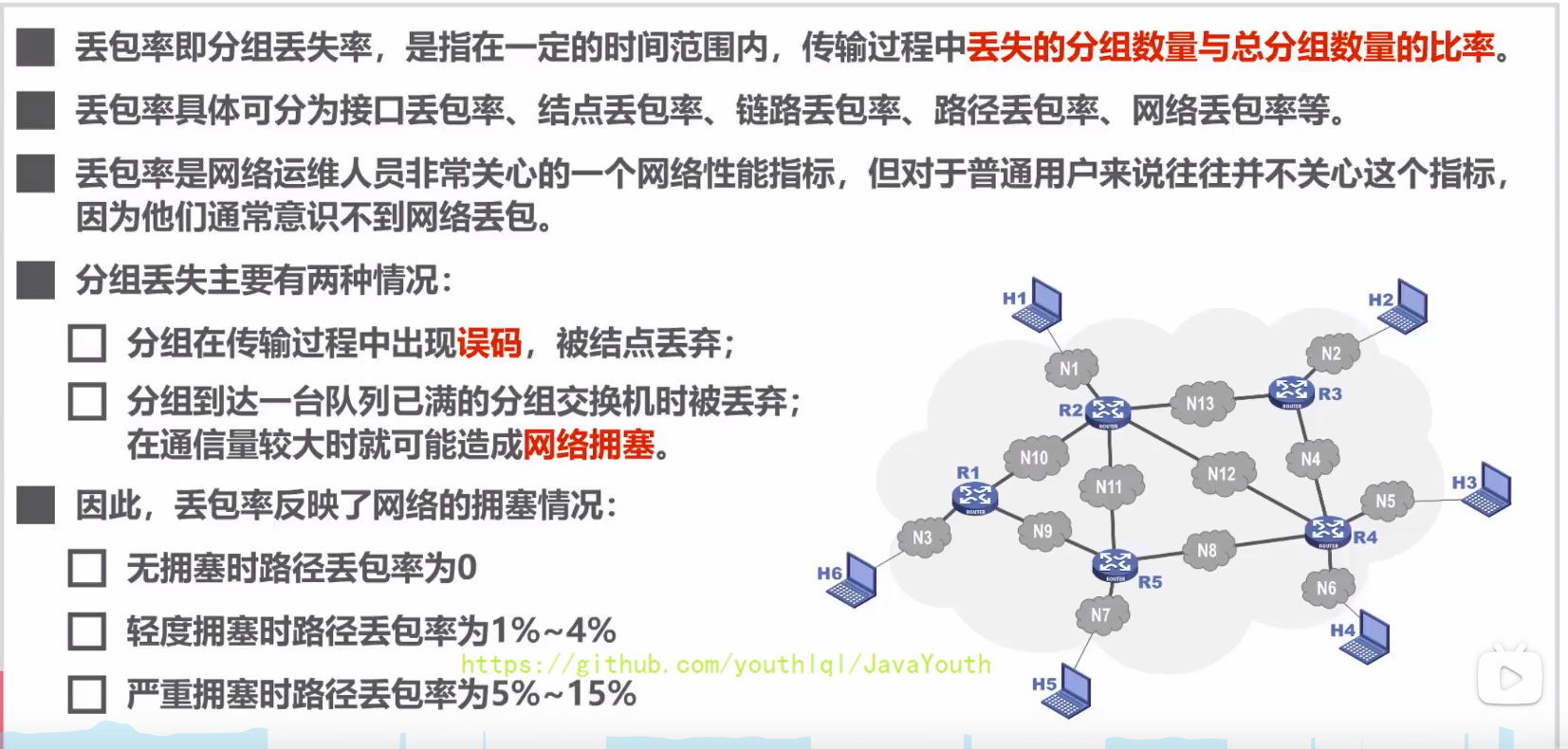

-### 丢包率

-

-

-

-### 丢包率

-

- -

-

-

-

-

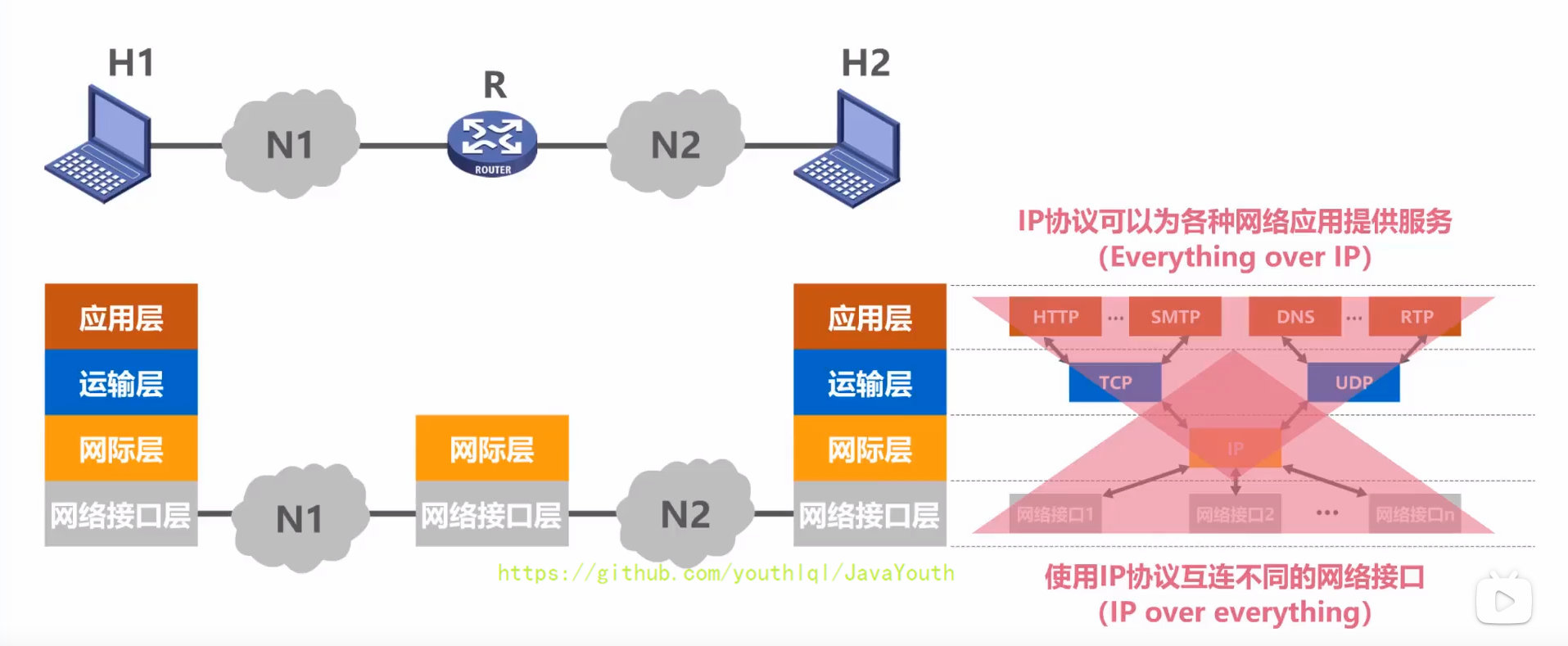

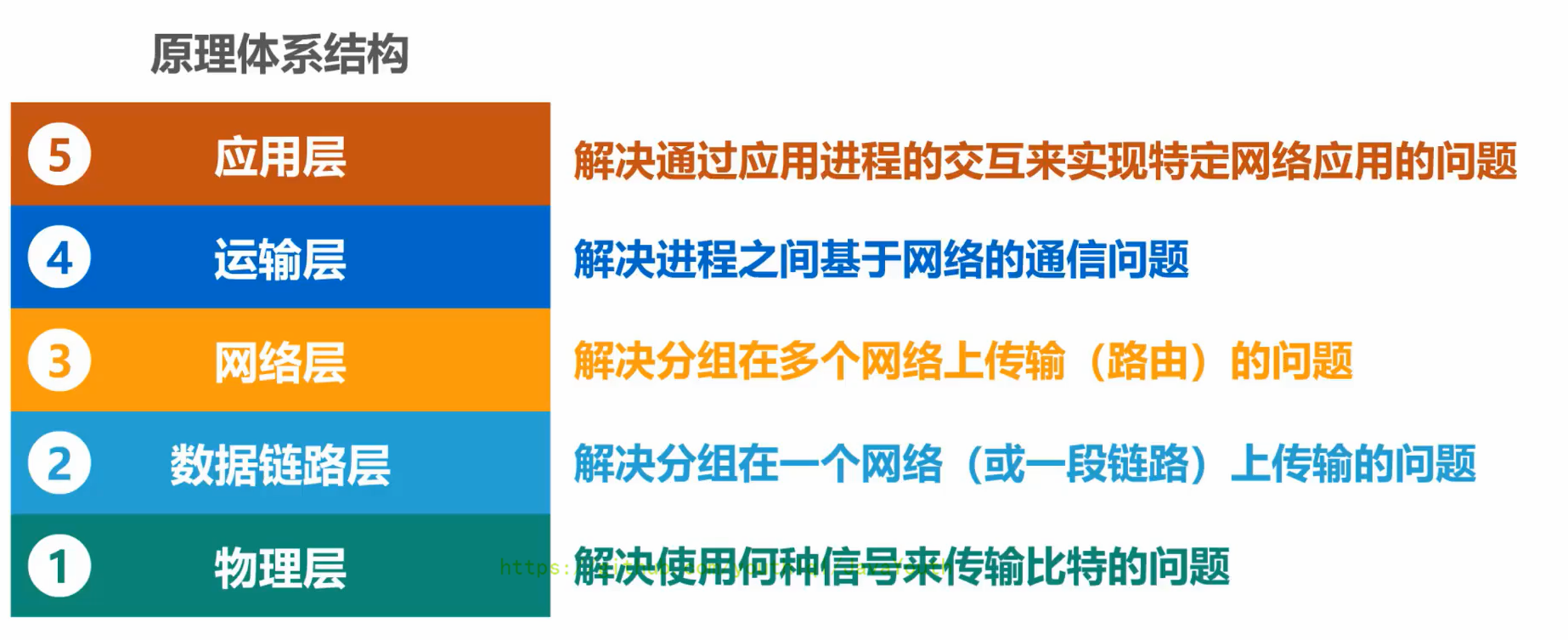

-## 计算机网络体系结构

-

-### 常见的计算机网络体系结构

-

-

-

-

-

-

-

-## 计算机网络体系结构

-

-### 常见的计算机网络体系结构

-

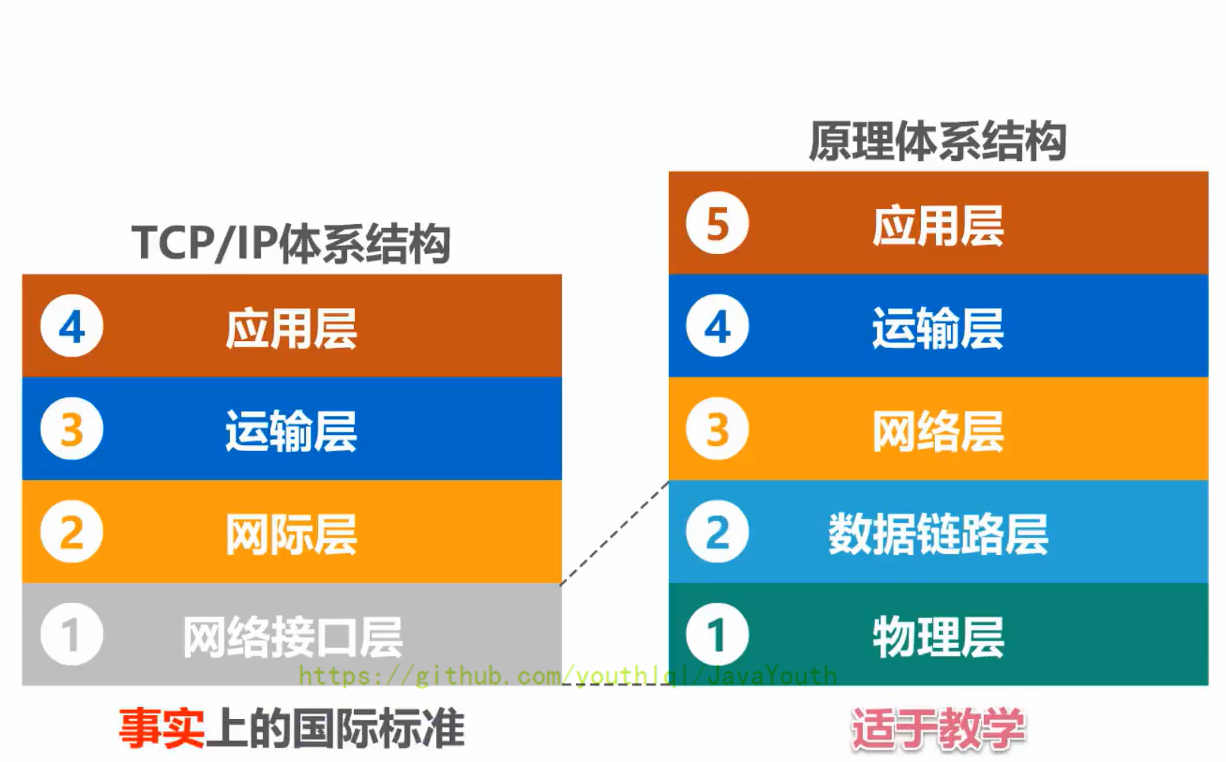

- -

-1、如今用的最多的是TCP/IP体系结构,现今规模最大的、覆盖全球的、基于TCP/IP的互联网并未使用OSI标准。TCP/IP体系结构相当于将OSI体系结构的物理层和数据链路层合并为了网络接口层,并去掉了会话层和表示层。

-

-2、TCP/IP在网络层使用的协议是IP协议,IP协议的意思是网际协议,因此TCP/IP体系结构的网络层称为网际层

-

-

-

-

-

-1、如今用的最多的是TCP/IP体系结构,现今规模最大的、覆盖全球的、基于TCP/IP的互联网并未使用OSI标准。TCP/IP体系结构相当于将OSI体系结构的物理层和数据链路层合并为了网络接口层,并去掉了会话层和表示层。

-

-2、TCP/IP在网络层使用的协议是IP协议,IP协议的意思是网际协议,因此TCP/IP体系结构的网络层称为网际层

-

-

-

- -

-1、在用户主机的操作系统中,通常都带有符合TCP/IP体系结构标准的TCP/IP协议族。而用于网络互连的路由器中,也带有符合TCP/IP体系结构标准的TCP/IP协议族。只不过路由器一般只包含网络接口层和网际层。

-

-2、

-

-**网络接口层**:并没有规定具体内容,这样做的目的是可以互连全世界各种不同的网络接口,例如:有线的以太网接口,无线局域网的WIFI接口等。因此本质上TCP/IP协议体系结构只有上面的三层。

-

-**网际层**:核心协议是IP协议。

-

-**运输层**:TCP和UDP是这层的两个重要协议。

-

-**应用层**: 包含了大量的应用层协议,如 HTTP , DNS 等。

-

-

-

-3、IP协议可以将不同的网络接口(网络接口层)进行互连,并向其上的TCP协议和UDP协议提供网络互连服务。

-

-- 而TCP协议在享受IP协议提供的网络互连服务的基础上,可向应用层的相应协议提供可靠的传输服务。

-

-- UDP协议在享受IP协议提供的网络互连服务的基础上,可向应用层的相应协议提供不可靠的传输服务。

-

-

-

-4、TCP/IP体系结构中最重要的是**IP协议**和**TCP协议**,因此用TCP和IP来表示整个协议大家族。

-

-

-

-

-

-

-

-1、在用户主机的操作系统中,通常都带有符合TCP/IP体系结构标准的TCP/IP协议族。而用于网络互连的路由器中,也带有符合TCP/IP体系结构标准的TCP/IP协议族。只不过路由器一般只包含网络接口层和网际层。

-

-2、

-

-**网络接口层**:并没有规定具体内容,这样做的目的是可以互连全世界各种不同的网络接口,例如:有线的以太网接口,无线局域网的WIFI接口等。因此本质上TCP/IP协议体系结构只有上面的三层。

-

-**网际层**:核心协议是IP协议。

-

-**运输层**:TCP和UDP是这层的两个重要协议。

-

-**应用层**: 包含了大量的应用层协议,如 HTTP , DNS 等。

-

-

-

-3、IP协议可以将不同的网络接口(网络接口层)进行互连,并向其上的TCP协议和UDP协议提供网络互连服务。

-

-- 而TCP协议在享受IP协议提供的网络互连服务的基础上,可向应用层的相应协议提供可靠的传输服务。

-

-- UDP协议在享受IP协议提供的网络互连服务的基础上,可向应用层的相应协议提供不可靠的传输服务。

-

-

-

-4、TCP/IP体系结构中最重要的是**IP协议**和**TCP协议**,因此用TCP和IP来表示整个协议大家族。

-

-

-

-

-

- -

-

-

-由于TCP/IP体系结构为了将不同的网络接口进行互连,因此它的网络接口层并没有规定什么具体的内容。然而,这对于我们学习计算机网络的完整体系而言就会缺少一部分内容,因此学习计算机体系结构时往往采取折中的办法。也就是综合OSI和TCP/IP的优点,采用一种5层体系的原理结构。

-

-### 分层的必要性

-

-

-

-

-

-由于TCP/IP体系结构为了将不同的网络接口进行互连,因此它的网络接口层并没有规定什么具体的内容。然而,这对于我们学习计算机网络的完整体系而言就会缺少一部分内容,因此学习计算机体系结构时往往采取折中的办法。也就是综合OSI和TCP/IP的优点,采用一种5层体系的原理结构。

-

-### 分层的必要性

-

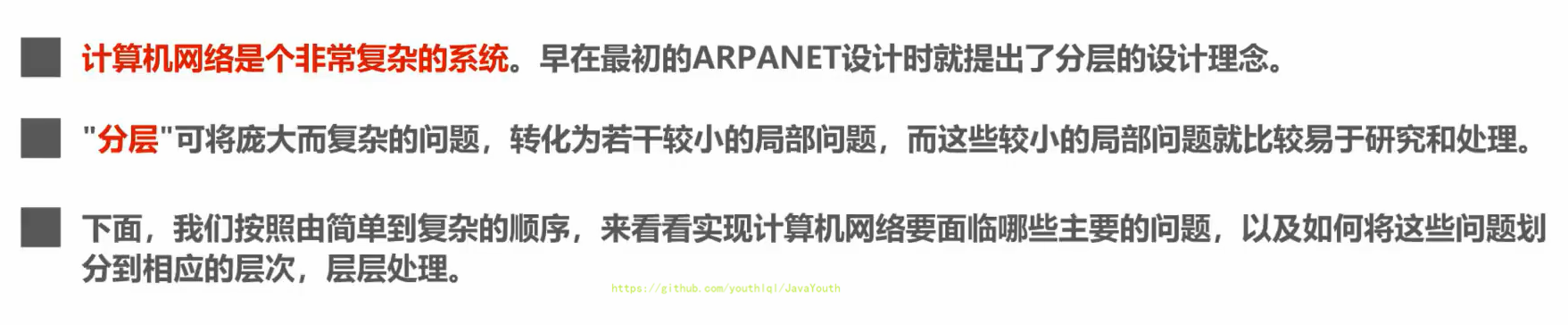

- -

-**物理层问题**

-

-

-

-**物理层问题**

-

- -

-

-

-严格来说,传输媒体并不属于物理层。计算机传输的信号,并不是图示的方波信号,这样举例只是让初学者容易理解

-

-**数据链路层问题**

-

-

-

-

-

-严格来说,传输媒体并不属于物理层。计算机传输的信号,并不是图示的方波信号,这样举例只是让初学者容易理解

-

-**数据链路层问题**

-

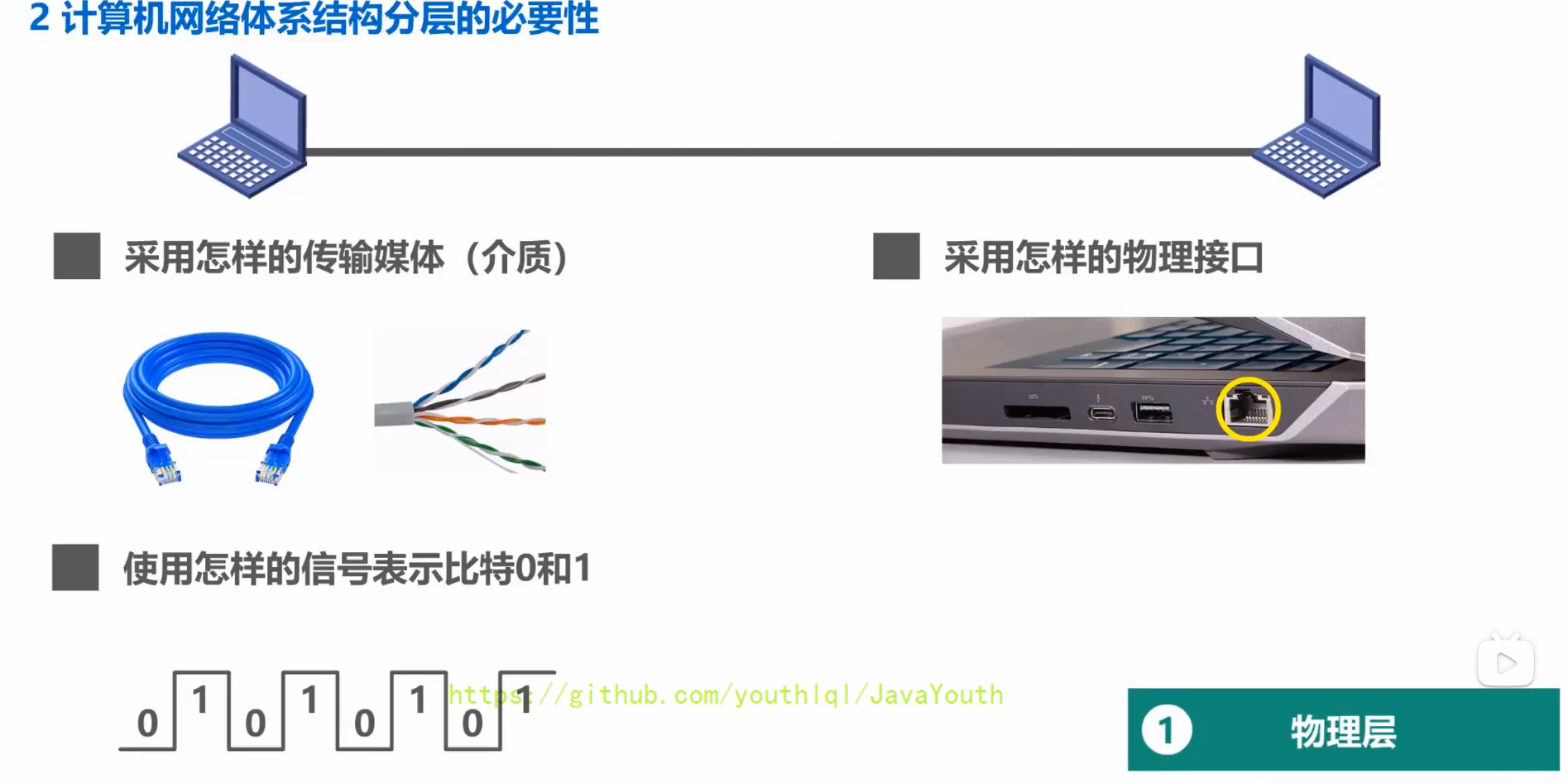

- -

-1、如图所示,主机A要给主机C发送数据。

-

-2、但是表示数据的信号会通过总线传播到总线上的每一个主机

-

-3、那么问题来了,主机C是如何知道该数据是发送给自己的,自己要接受?而主机B,D,E又如何知道该数据不删发送给自己的,自己应该拒绝呢?

-

-4、这就很自然的引出了下面几个问题

-

-Q:如何标识网络中的各主机(也就是主机编址问题,例如MAC地址)?

-

-A:主机在发送数据时,应该给数据附加上目的地址,当其他主机收到后,根据目的地址和自身地址来决定是否接受数据。

-

-

-

-Q:目的主机如何从信号所表示的一连串比特流中区分出地址和数据?

-

-A:也就是需要解决分组的封装格式问题

-

-

-

-Q:另外对于总线型的网络,还会出现下面这种典型的问题

-

-

-

-1、如图所示,主机A要给主机C发送数据。

-

-2、但是表示数据的信号会通过总线传播到总线上的每一个主机

-

-3、那么问题来了,主机C是如何知道该数据是发送给自己的,自己要接受?而主机B,D,E又如何知道该数据不删发送给自己的,自己应该拒绝呢?

-

-4、这就很自然的引出了下面几个问题

-

-Q:如何标识网络中的各主机(也就是主机编址问题,例如MAC地址)?

-

-A:主机在发送数据时,应该给数据附加上目的地址,当其他主机收到后,根据目的地址和自身地址来决定是否接受数据。

-

-

-

-Q:目的主机如何从信号所表示的一连串比特流中区分出地址和数据?

-

-A:也就是需要解决分组的封装格式问题

-

-

-

-Q:另外对于总线型的网络,还会出现下面这种典型的问题

-

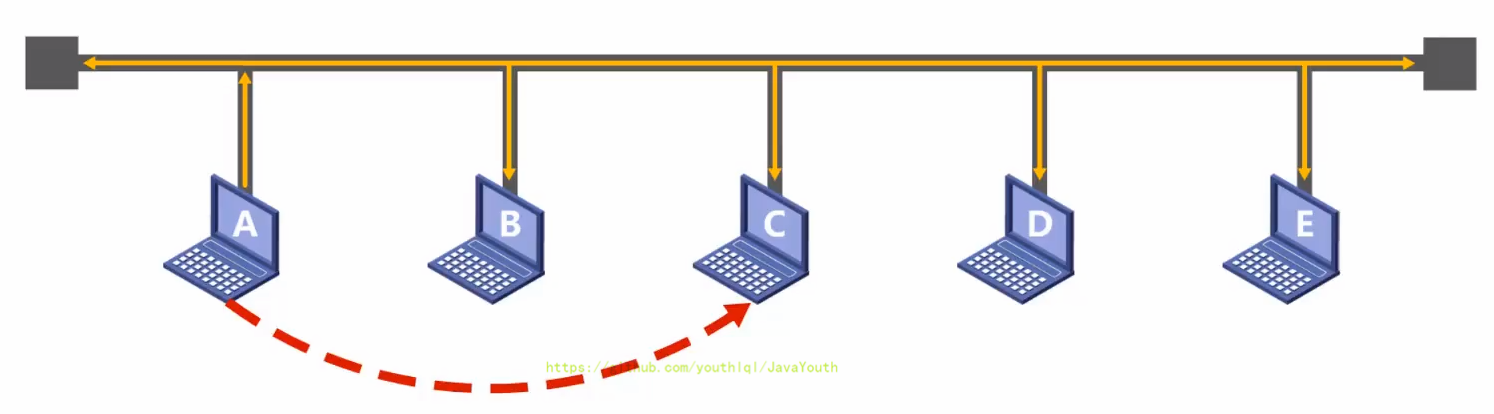

- -

-

-

-某个时刻,总线是空闲的。 片刻之后,主机B和D同时向总线发送数据,这必然造成信号碰撞。不过这种总线型的网络早已淘汰,现在常用的是使用以太网交换机将多台主机互连形成的交换式以太网。那么,以太网交换机又是如何实现的呢?

-

-

-

-**网络层问题**

-

-> 到这里可能会发现,只要解决了物理层和数据链路层各自所面临的问题,我们就可以实现分组在**一个网络**上传输了。但是,我们每天都会使用的因特网是由**非常多的网络**和路由器互连起来的,仅解决物理层和数据链路层的问题还是不能正常工作。

-

-

-

-

-

-

-

-某个时刻,总线是空闲的。 片刻之后,主机B和D同时向总线发送数据,这必然造成信号碰撞。不过这种总线型的网络早已淘汰,现在常用的是使用以太网交换机将多台主机互连形成的交换式以太网。那么,以太网交换机又是如何实现的呢?

-

-

-

-**网络层问题**

-

-> 到这里可能会发现,只要解决了物理层和数据链路层各自所面临的问题,我们就可以实现分组在**一个网络**上传输了。但是,我们每天都会使用的因特网是由**非常多的网络**和路由器互连起来的,仅解决物理层和数据链路层的问题还是不能正常工作。

-

-

-

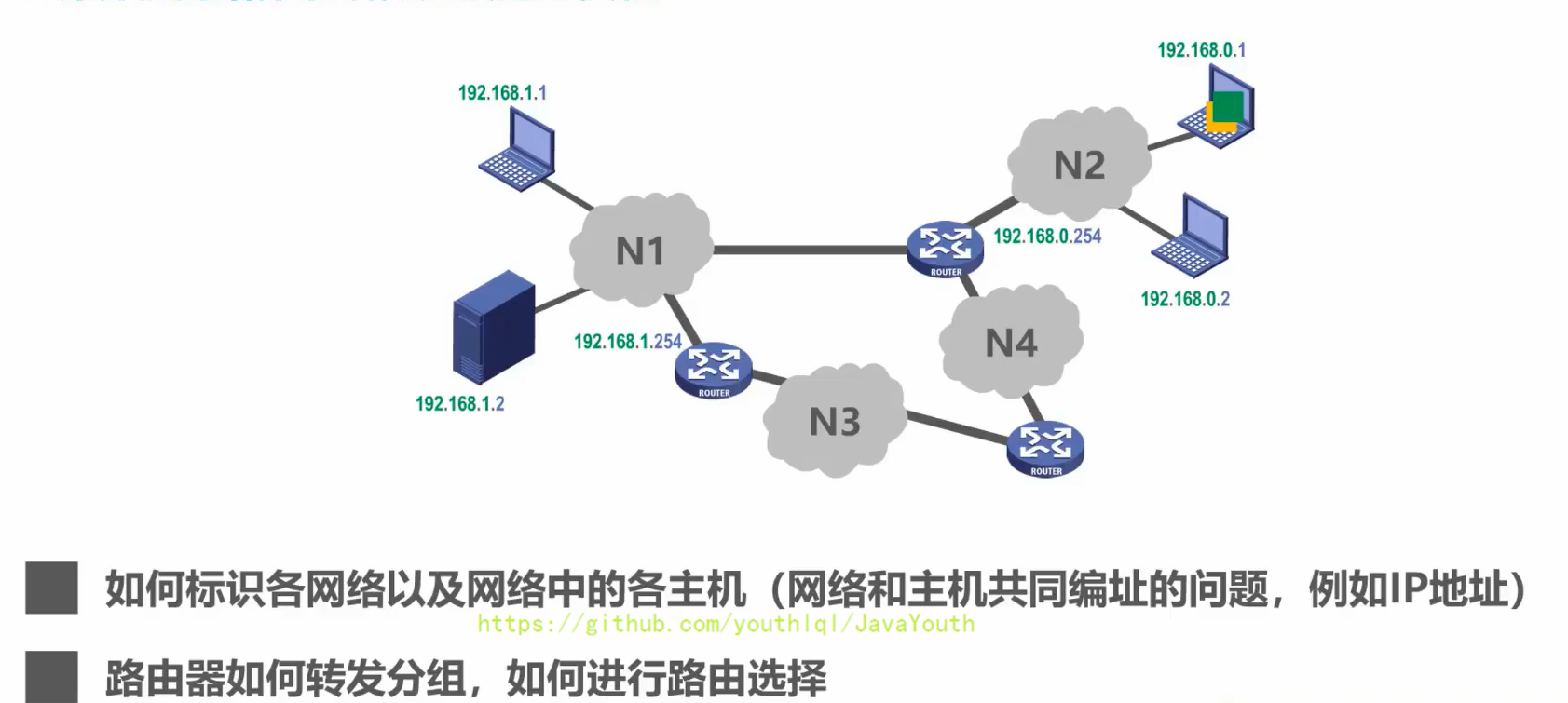

- -

-

-

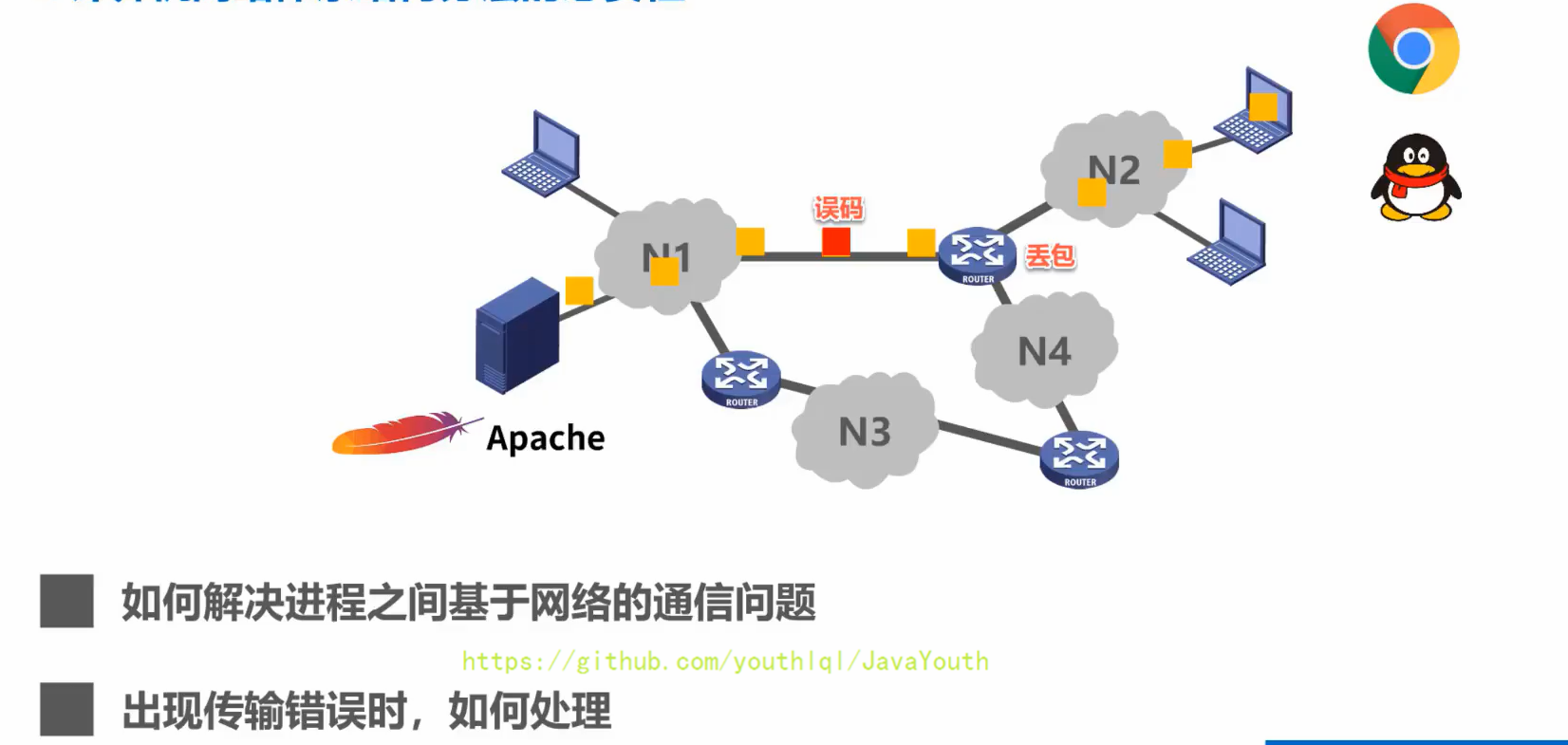

-**运输层问题**

-

-1、假设这台主机中运行着两个与网络通信有关的应用进程(QQ和谷歌浏览器),这台服务器中运行着与网络通信相关的服务器进程。某个时刻,主机收到了来自服务器的分组,那么这些分组应该交给浏览器进程处理呢,还是应该交给QQ进程处理?

-

-- 引出了我们如何标识与网络通信相关的引用进程,进而解决进程之间基于网络通信的问题。

-

-

-

-

-

-**运输层问题**

-

-1、假设这台主机中运行着两个与网络通信有关的应用进程(QQ和谷歌浏览器),这台服务器中运行着与网络通信相关的服务器进程。某个时刻,主机收到了来自服务器的分组,那么这些分组应该交给浏览器进程处理呢,还是应该交给QQ进程处理?

-

-- 引出了我们如何标识与网络通信相关的引用进程,进而解决进程之间基于网络通信的问题。

-

- -

-

-

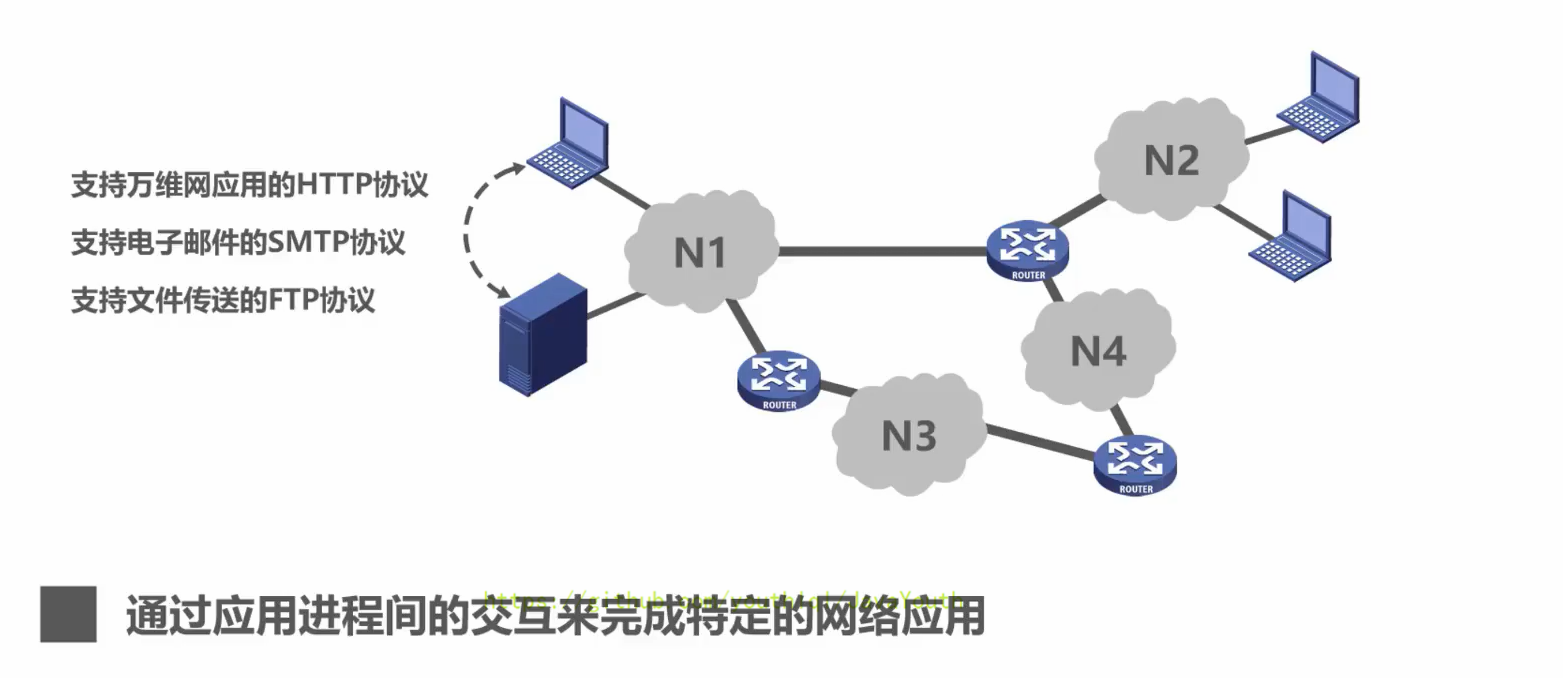

-**应用层问题**

-

-

-

-

-

-**应用层问题**

-

- -

-

-

-**总结**

-

-

-

-

-

-

-

-**总结**

-

-

-

- -

-### 分层思想举例

-

-> 此例子只是简单的例子,后续可能会写一篇详细的。

-

-假设网络拓扑如下所示

-

-

-

-### 分层思想举例

-

-> 此例子只是简单的例子,后续可能会写一篇详细的。

-

-假设网络拓扑如下所示

-

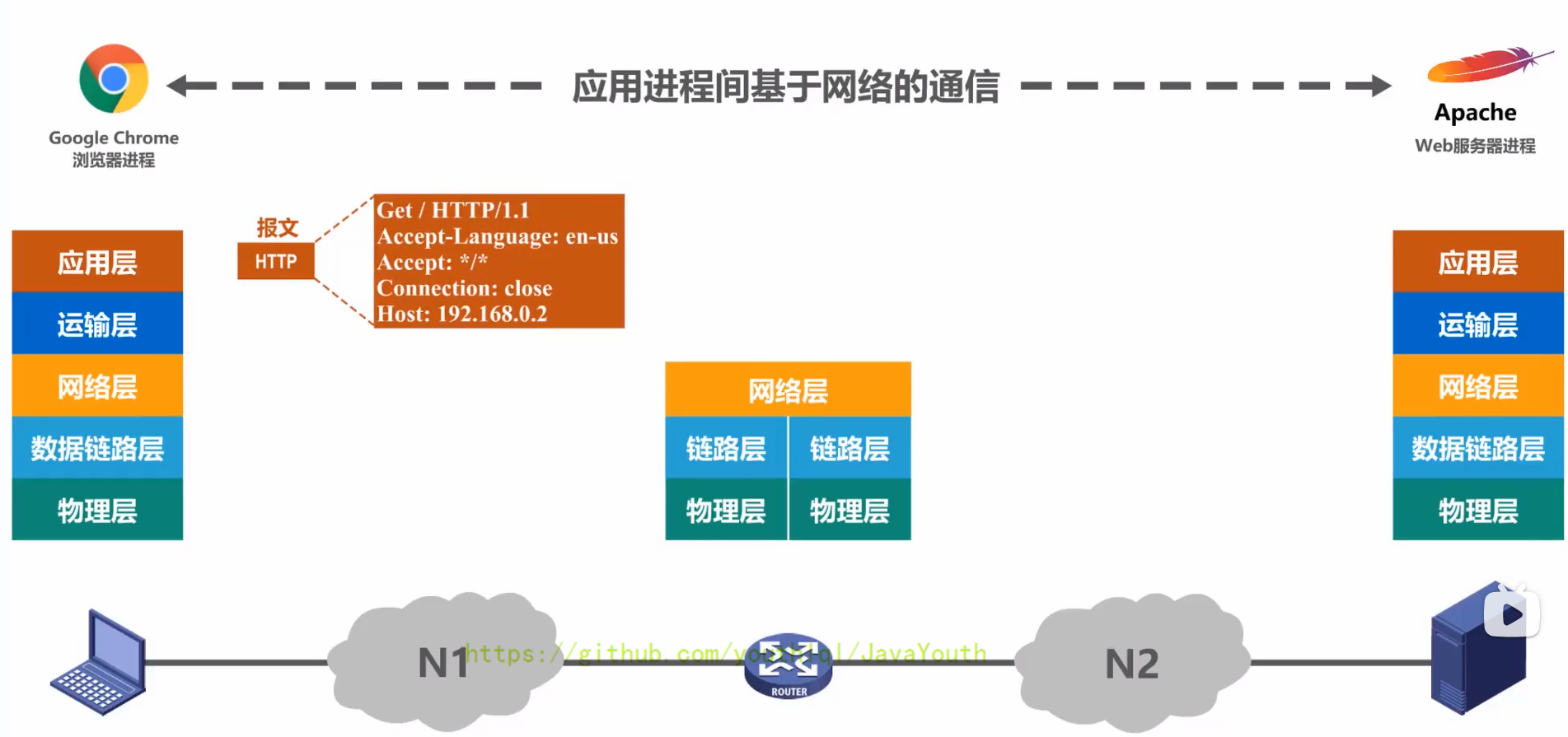

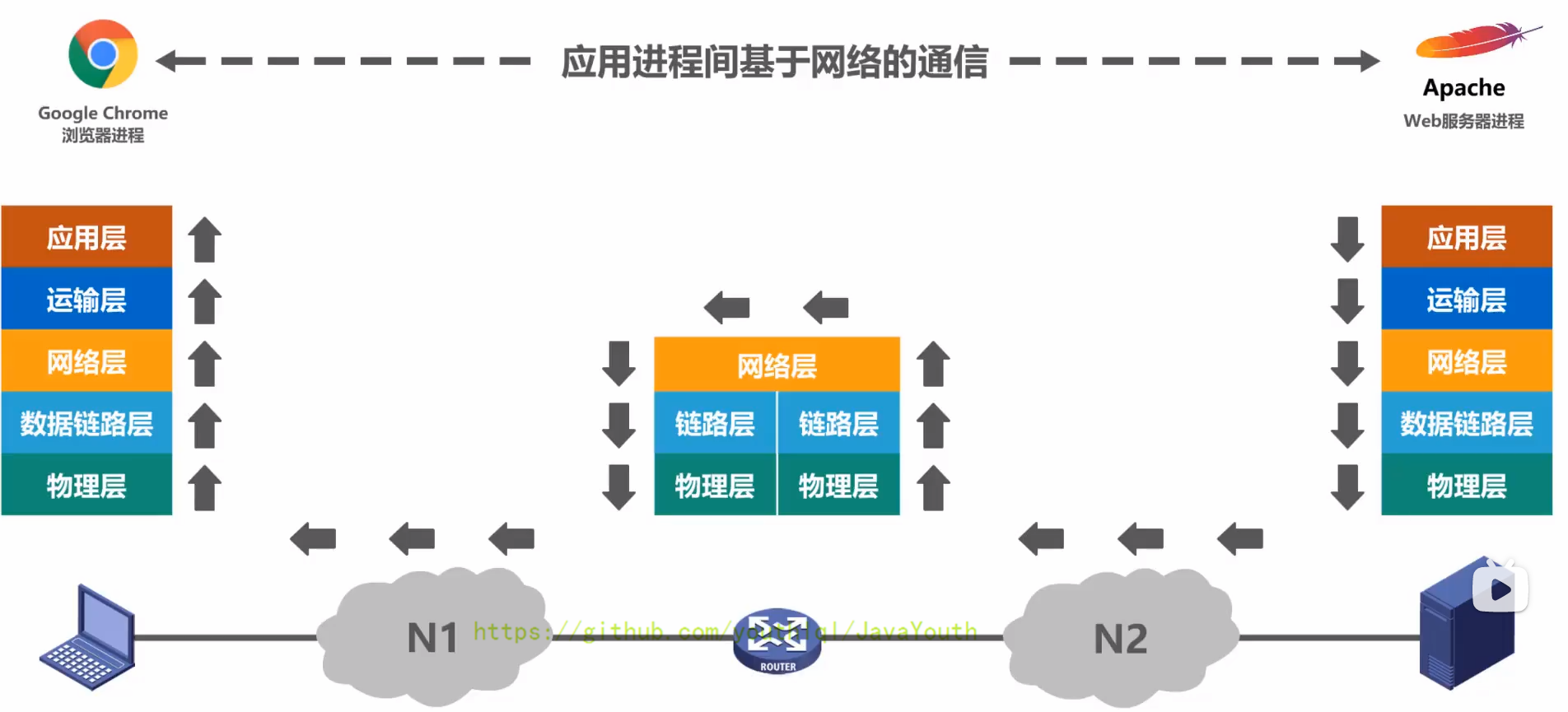

- -

-

-

-**解析:**

-

-主机和Web服务器之间基于网络的通信,实际上是主机中的浏览器应用进程与Web服务器中的Web服务器应用进程之间基于网络的通信

-

-

-

-

-

-**解析:**

-

-主机和Web服务器之间基于网络的通信,实际上是主机中的浏览器应用进程与Web服务器中的Web服务器应用进程之间基于网络的通信

-

- -

-

-

-**各层在整个过程中起到怎样的作用?**

-

-**1、应用层**

-

-- 应用层按照HTTP协议的规定构建一个HTTP请求报文

-

-- 应用层将HTTP请求报文交付给运输层处理

-

-

-

-

-

-**各层在整个过程中起到怎样的作用?**

-

-**1、应用层**

-

-- 应用层按照HTTP协议的规定构建一个HTTP请求报文

-

-- 应用层将HTTP请求报文交付给运输层处理

-

- -

-

-

-

-

-**2、运输层**

-

-- 运输层给HTTP请求报文添加一个TCP首部,使之成为TCP报文段

-

-- TCP报文段的首部格式作用是区分应用进程以及实现可靠传输

-

-- 运输层将TCP报文段交付给网络层处理

-

-

-

-

-

-

-

-**2、运输层**

-

-- 运输层给HTTP请求报文添加一个TCP首部,使之成为TCP报文段

-

-- TCP报文段的首部格式作用是区分应用进程以及实现可靠传输

-

-- 运输层将TCP报文段交付给网络层处理

-

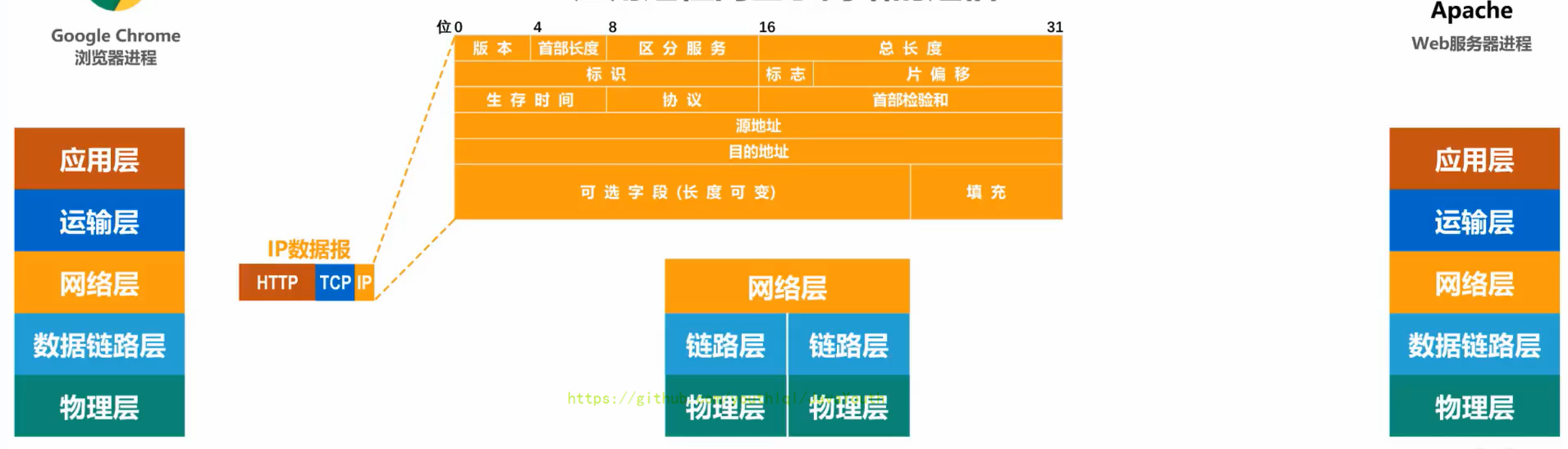

- -

-

-

-**3、网络层**

-

-- 网络层给TCP报文段添加一个IP首部,使之成为IP数据报

-

-- IP数据报的首部格式作用是使IP数据报可以在互联网传输,也就是被路由器转发

-

-- 网络层将IP数据报交付给数据链路层处理

-

-

-

-

-

-**3、网络层**

-

-- 网络层给TCP报文段添加一个IP首部,使之成为IP数据报

-

-- IP数据报的首部格式作用是使IP数据报可以在互联网传输,也就是被路由器转发

-

-- 网络层将IP数据报交付给数据链路层处理

-

- -

-

-

-**4、数据链路层**

-

-

-

-- 数据链路层给IP数据报添加一个首部和一个尾部,使之成为帧 (图示右边为首部,左边为尾部)

-

-- 该首部的作用主要是为了让帧能够在一段链路上或一个网络上传输,能够被相应的目的主机接收

-

-- 该尾部的作用是让目的主机检查所接收到的帧是否有误码

-

-- 数据链路层将帧交付给物理层

-

-

-

-

-

-

-

-**4、数据链路层**

-

-

-

-- 数据链路层给IP数据报添加一个首部和一个尾部,使之成为帧 (图示右边为首部,左边为尾部)

-

-- 该首部的作用主要是为了让帧能够在一段链路上或一个网络上传输,能够被相应的目的主机接收

-

-- 该尾部的作用是让目的主机检查所接收到的帧是否有误码

-

-- 数据链路层将帧交付给物理层

-

-

-

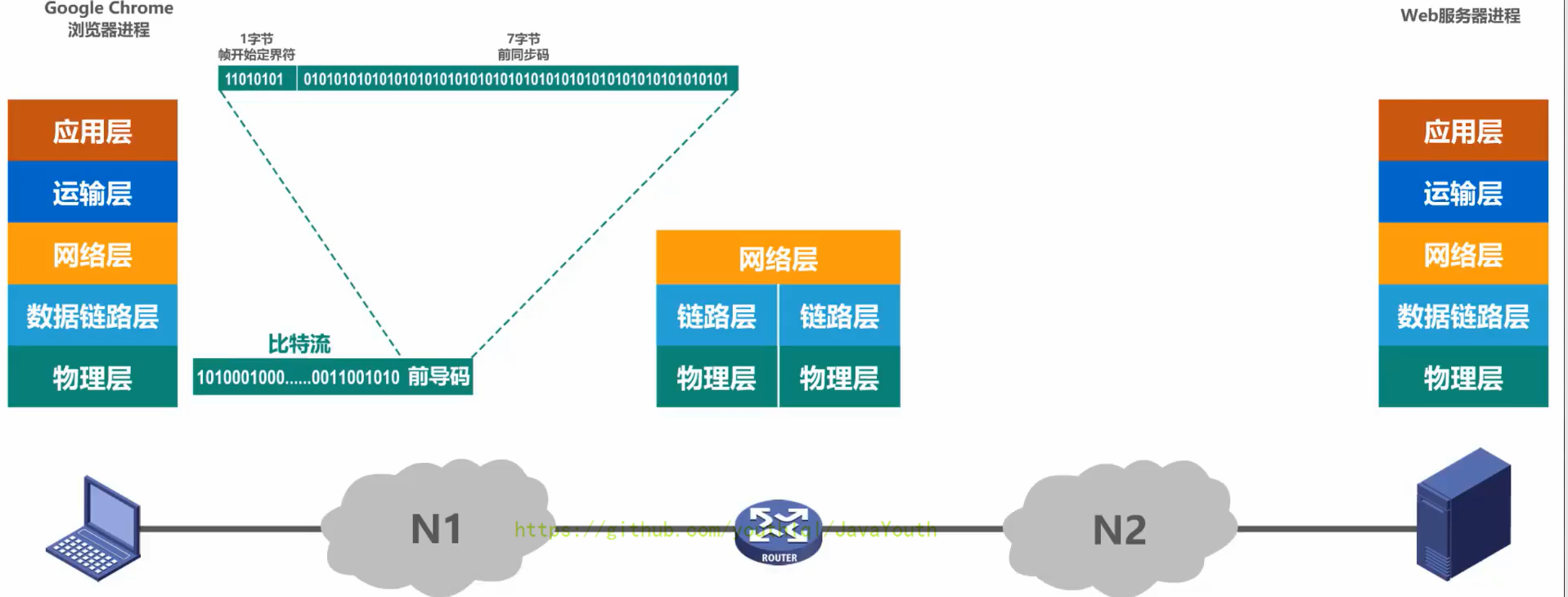

- -

-

-

-**5、物理层**

-

-* 物理层先将帧看做是比特流,这里的网络N1假设是以太网,所以物理层还会给该比特流前面添加前导码

-* 前导码的作用是为了让目的主机做好接收帧的准备

-* 物理层将装有前导码的比特流变换成相应的信号发送给传输媒体

-

-

-

-

-

-**5、物理层**

-

-* 物理层先将帧看做是比特流,这里的网络N1假设是以太网,所以物理层还会给该比特流前面添加前导码

-* 前导码的作用是为了让目的主机做好接收帧的准备

-* 物理层将装有前导码的比特流变换成相应的信号发送给传输媒体

-

- -

-

-

-**6、路由器**

-

-- 信号通过传输媒体到达路由器

-

-

-

-

-

-**6、路由器**

-

-- 信号通过传输媒体到达路由器

-

- -

-

-

-7、**路由器转发**

-

-

-

-在路由器中

-

-* 物理层将信号变为比特流,然后去掉前导码后,将其交付给数据链路层

-* 数据链路层将帧的首部和尾部去掉后,将其交付给网络层,这实际交付的是IP数据报

-* 网络层解析IP数据报的首部,从中提取目的网络地址

-

-* 提取目的网络地址后查找自身路由表。确定转发端口, 以便进行转发

-* 网络层将IP数据报交付给数据链路层

-* 数据链路层给IP数据报添加一个首部和一个尾部,使之成为帧

-* 数据链路层将帧交付给物理层

-* 物理层先将帧看成比特流,这里的网络N2假设是以太网,所以物理层还会给该比特流前面添加前导码

-* 物理层将装有前导码的比特流变换成相应的信号发送给传输媒体,信号通过传输媒体到达Web服务器

-

-

-

-

-

-

-

-**8、接收方接收**

-

-在Web 服务器上

-

-* 物理层将信号变换为比特流,然后去掉前导码后成为帧,交付给数据链路层

-* 数据链路层将帧的首部和尾部去掉后成为IP数据报,将其交付给网络层

-* 网络层将IP数据报的首部去掉后成为TCP报文段,将其交付给运输层

-* 运输层将TCP报文段的首部去掉后成为HTTP请求报文,将其交付给应用层

-* 应用层对HTTP请求报文进行解析,然后给主机发回响应报文

-

-**发回响应报文的步骤和之前过程类似**

-

-

-

-

-

-7、**路由器转发**

-

-

-

-在路由器中

-

-* 物理层将信号变为比特流,然后去掉前导码后,将其交付给数据链路层

-* 数据链路层将帧的首部和尾部去掉后,将其交付给网络层,这实际交付的是IP数据报

-* 网络层解析IP数据报的首部,从中提取目的网络地址

-

-* 提取目的网络地址后查找自身路由表。确定转发端口, 以便进行转发

-* 网络层将IP数据报交付给数据链路层

-* 数据链路层给IP数据报添加一个首部和一个尾部,使之成为帧

-* 数据链路层将帧交付给物理层

-* 物理层先将帧看成比特流,这里的网络N2假设是以太网,所以物理层还会给该比特流前面添加前导码

-* 物理层将装有前导码的比特流变换成相应的信号发送给传输媒体,信号通过传输媒体到达Web服务器

-

-

-

-

-

-

-

-**8、接收方接收**

-

-在Web 服务器上

-

-* 物理层将信号变换为比特流,然后去掉前导码后成为帧,交付给数据链路层

-* 数据链路层将帧的首部和尾部去掉后成为IP数据报,将其交付给网络层

-* 网络层将IP数据报的首部去掉后成为TCP报文段,将其交付给运输层

-* 运输层将TCP报文段的首部去掉后成为HTTP请求报文,将其交付给应用层

-* 应用层对HTTP请求报文进行解析,然后给主机发回响应报文

-

-**发回响应报文的步骤和之前过程类似**

-

- -

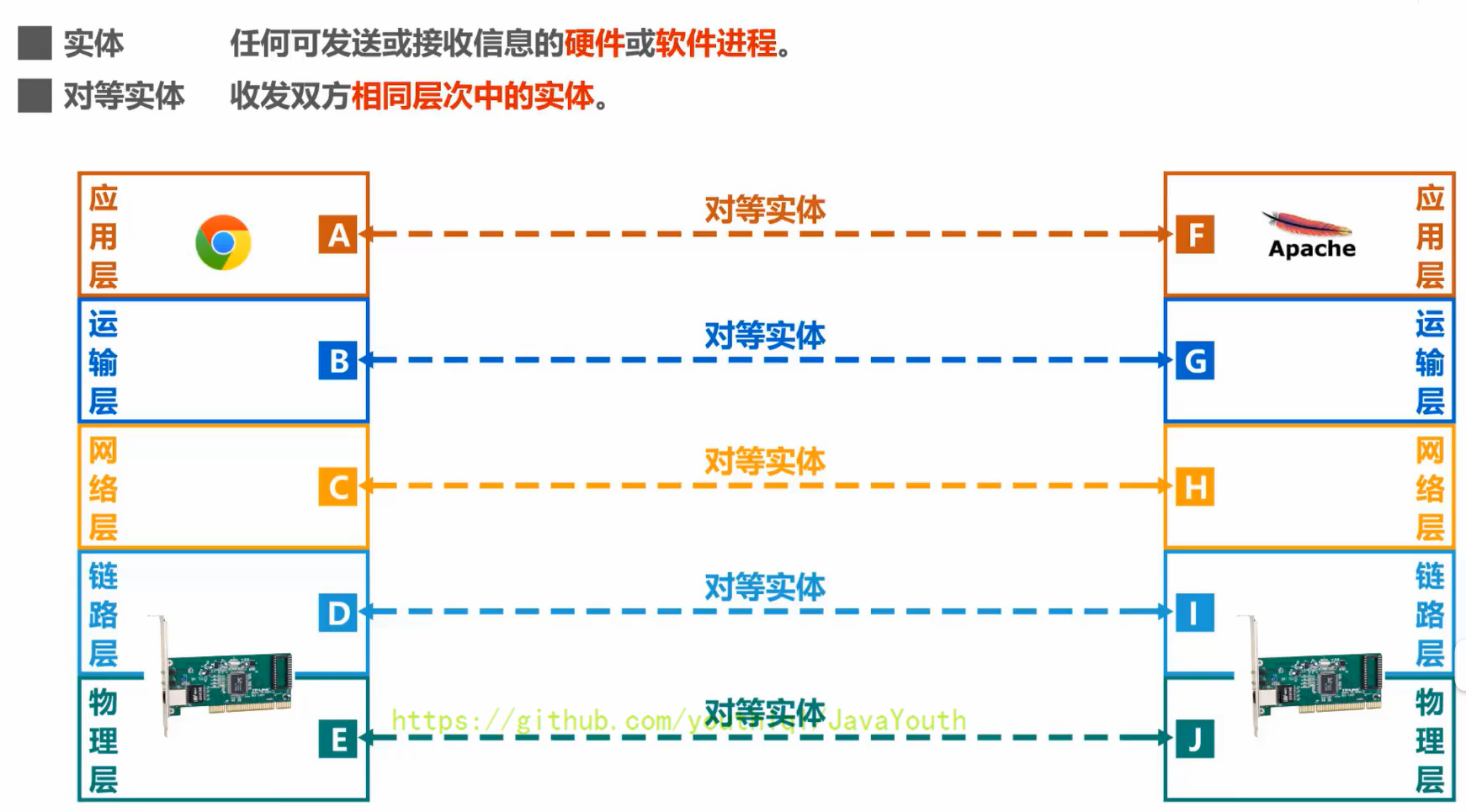

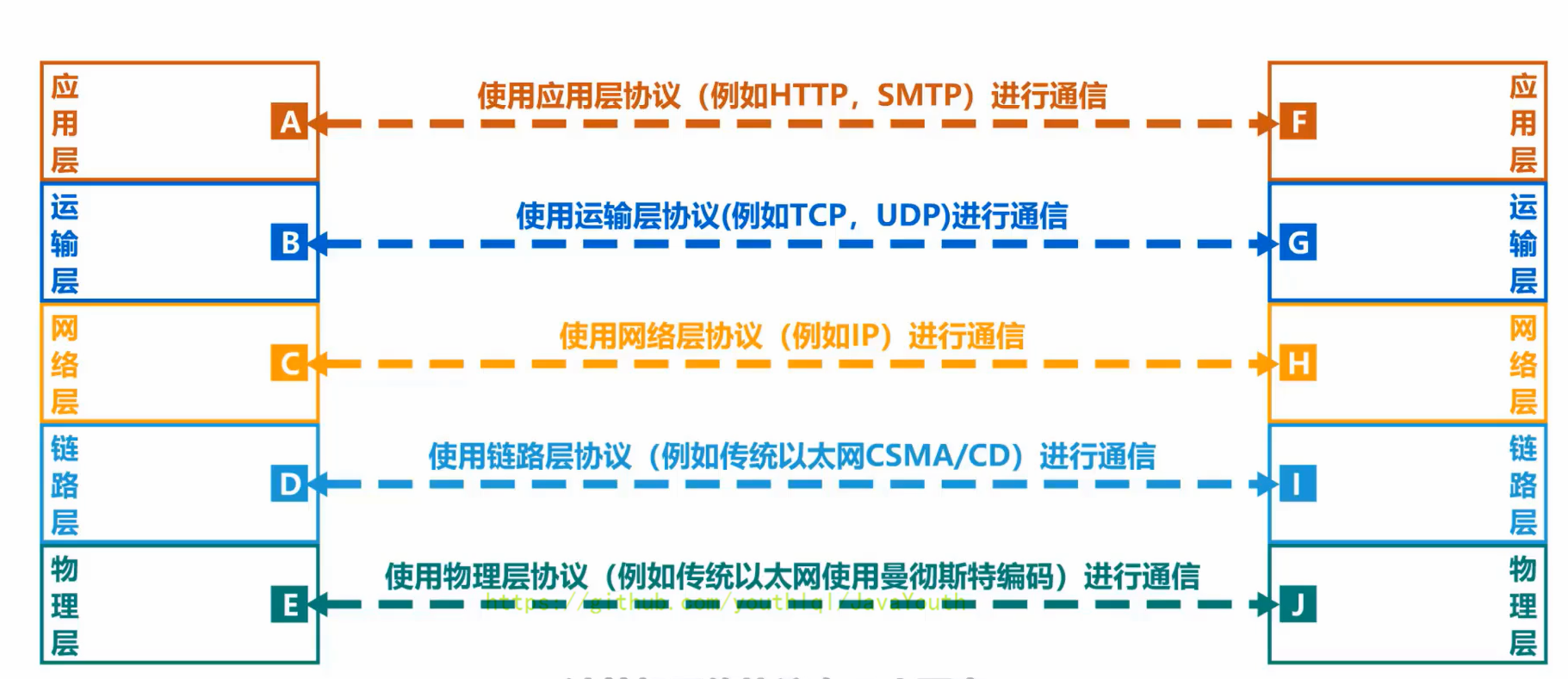

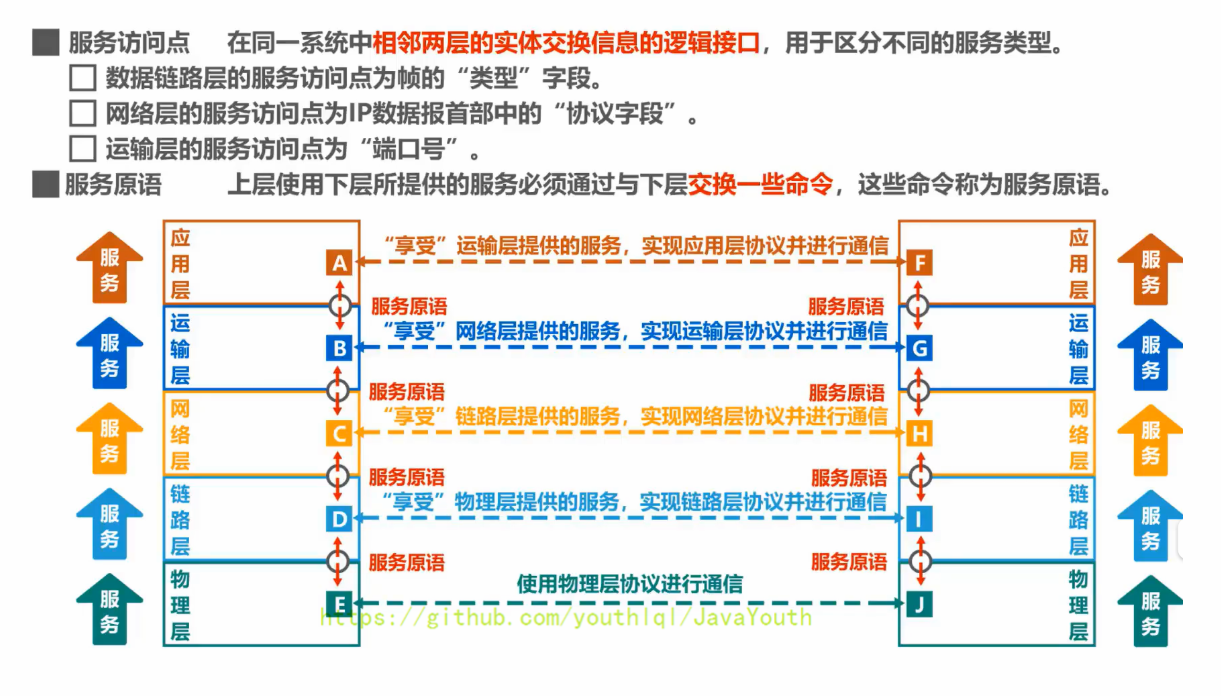

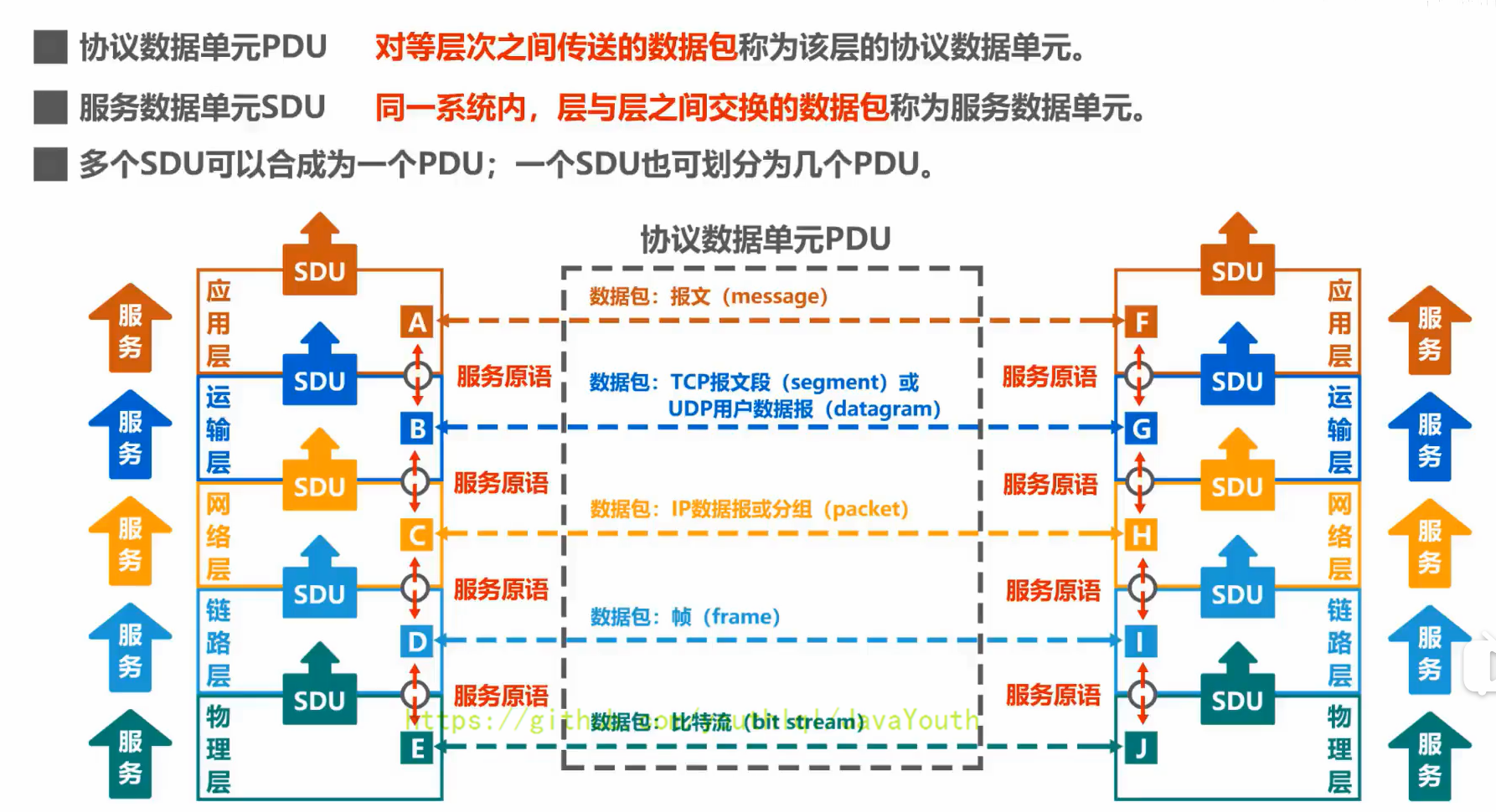

-### 专用术语

-

-以下介绍的专用术语来源于OSI的七层协议体系结构,但也适用于TCP/IP的四层体系结构和五层协议体系结构

-

-**实体**

-

-

-

-### 专用术语

-

-以下介绍的专用术语来源于OSI的七层协议体系结构,但也适用于TCP/IP的四层体系结构和五层协议体系结构

-

-**实体**

-

- -

-

-

-**协议**

-

-

-

-

-

-**协议**

-

- -

-1、协议:控制两个对等实体进行逻辑通信的规则的集合

-

-2、之所以称为逻辑通信,是因为这种通信其实并不存在,它只是我们假设出来的一种通信,目的在于方便我们单独研究体系结构某一层时而不用考虑其它层

-

-3、协议三要素:

-

-* 语法:定义所交换信息的格式

-* 语义:定义收发双方所要完成的操作

-* 同步:定义收发双发的时序关系

-

-

-

-**服务**

-

-

-

-1、协议:控制两个对等实体进行逻辑通信的规则的集合

-

-2、之所以称为逻辑通信,是因为这种通信其实并不存在,它只是我们假设出来的一种通信,目的在于方便我们单独研究体系结构某一层时而不用考虑其它层

-

-3、协议三要素:

-

-* 语法:定义所交换信息的格式

-* 语义:定义收发双方所要完成的操作

-* 同步:定义收发双发的时序关系

-

-

-

-**服务**

-

- -

-

-

-

-

-

-

- -

-

-

-

-

-

-

- -

diff --git a/docs/ElasticSearch/ElasticSearch-入门.md b/docs/ElasticSearch/ElasticSearch-入门.md

deleted file mode 100644

index f7e2553..0000000

--- a/docs/ElasticSearch/ElasticSearch-入门.md

+++ /dev/null

@@ -1,651 +0,0 @@

----

-title: ElasticSearch-入门篇

-tags:

- - ElasticSearch

- - ELK

- - 全文检索

-categories:

- - ElasticSearch

- - 用法

-keywords: ElasticSearch,全文检索

-description: ElasticSearch-入门篇,适合做入门,或者知识回顾。

-cover: 'https://npm.elemecdn.com/lql_static@latest/logo/es.jpg'

-abbrlink: 7f60dde9

-date: 2020-02-03 13:11:45

----

-

-

-

-> 文章很长,喜欢的话,可以关注下博客。这段时间秋招忙完之后,会持续更新新内容

-

-# ElasticSearch介绍

-

-## 介绍

-

-1、elasticsearch是一个基于Lucene的高扩展的分布式搜索服务器,支持开箱即用。

-

-2、elasticsearch隐藏了Lucene的复杂性,对外提供Restful 接口来操作索引、搜索。

-

-

-

-**突出优点:**

-

-1. 扩展性好,可部署上百台服务器集群,处理PB级数据。

-

-2. 近实时的去索引数据、搜索数据。

-

-**es和solr选择哪个?**

-

-1. 如果你公司现在用的solr可以满足需求就不要换了。

-

-2. 如果你公司准备进行全文检索项目的开发,建议优先考虑elasticsearch,因为像Github这样大规模的搜索都在用它。

-

-

-

-## 倒排索引

-

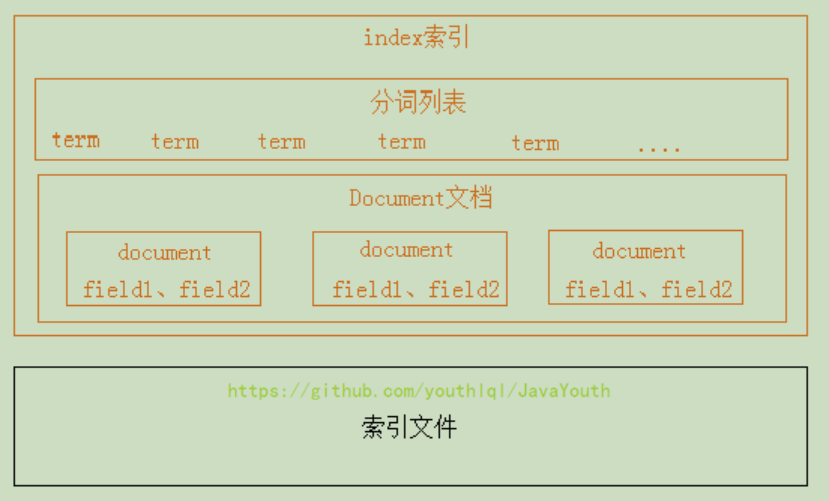

-下图是ElasticSearch的索引结构,下边黑色部分是物理结构,上边黄色部分是逻辑结构,逻辑结构也是为了更好的 去描述ElasticSearch的工作原理及去使用物理结构中的索引文件。

-

-

-

diff --git a/docs/ElasticSearch/ElasticSearch-入门.md b/docs/ElasticSearch/ElasticSearch-入门.md

deleted file mode 100644

index f7e2553..0000000

--- a/docs/ElasticSearch/ElasticSearch-入门.md

+++ /dev/null

@@ -1,651 +0,0 @@

----

-title: ElasticSearch-入门篇

-tags:

- - ElasticSearch

- - ELK

- - 全文检索

-categories:

- - ElasticSearch

- - 用法

-keywords: ElasticSearch,全文检索

-description: ElasticSearch-入门篇,适合做入门,或者知识回顾。

-cover: 'https://npm.elemecdn.com/lql_static@latest/logo/es.jpg'

-abbrlink: 7f60dde9

-date: 2020-02-03 13:11:45

----

-

-

-

-> 文章很长,喜欢的话,可以关注下博客。这段时间秋招忙完之后,会持续更新新内容

-

-# ElasticSearch介绍

-

-## 介绍

-

-1、elasticsearch是一个基于Lucene的高扩展的分布式搜索服务器,支持开箱即用。

-

-2、elasticsearch隐藏了Lucene的复杂性,对外提供Restful 接口来操作索引、搜索。

-

-

-

-**突出优点:**

-

-1. 扩展性好,可部署上百台服务器集群,处理PB级数据。

-

-2. 近实时的去索引数据、搜索数据。

-

-**es和solr选择哪个?**

-

-1. 如果你公司现在用的solr可以满足需求就不要换了。

-

-2. 如果你公司准备进行全文检索项目的开发,建议优先考虑elasticsearch,因为像Github这样大规模的搜索都在用它。

-

-

-

-## 倒排索引

-

-下图是ElasticSearch的索引结构,下边黑色部分是物理结构,上边黄色部分是逻辑结构,逻辑结构也是为了更好的 去描述ElasticSearch的工作原理及去使用物理结构中的索引文件。

-

- -

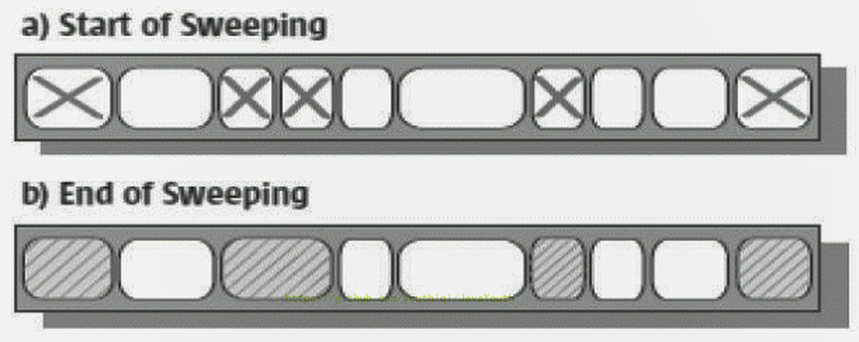

-逻辑结构部分是一个倒排索引表:

-

-1、将要搜索的文档内容分词,所有不重复的词组成分词列表。

-

-2、将搜索的文档最终以Document方式存储起来。

-

-3、每个词和docment都有关联。

-

-如下:

-

-

-

-逻辑结构部分是一个倒排索引表:

-

-1、将要搜索的文档内容分词,所有不重复的词组成分词列表。

-

-2、将搜索的文档最终以Document方式存储起来。

-

-3、每个词和docment都有关联。

-

-如下:

-

- -

-现在,如果我们想搜到`quick brown`我们只需要查找包含每个词条的文档:

-

-

-

-现在,如果我们想搜到`quick brown`我们只需要查找包含每个词条的文档:

-

- -

-两个文档都匹配,但是第一个文档比第二个匹配度更高。如果我们使用仅计算匹配词条数量的简单 相似性算法 , 那么,我们可以说,对于我们查询的相关性来讲,第一个文档比第二个文档更佳

-

-# 基本概念

-

-

-

-1.创建索引库 --------------------->类似于:数据库的建表

-

-2.创建映射 --------------------->类似于:数据库的添加表中字段

-

-3.创建(添加)文档 --------------------->类似于:数据库的往表中添加数据。术语称这个过程为:创建索引

-

-5.搜索文档 --------------------->类似于:从数据库里查数据

-